Sony Sensor mit drei Schichten: mehr Leistung und weniger Rauschen

In einem Artikel auf der Fotografie-Website PetaPixel beschreibt der Fotograf und Fachautor Jeremy Gray Sonys Entwicklungspläne für einen dreischichtigen Bildsensor. Er bezieht sich dabei auf einen Beitrag auf sonyalpharumors.com und eine Investorenpräsentation, bei der die Geschäftszahlen des Fiskaljahres 2024 vorgestellt wurden – ein Jahr mit Rekordwerten bei Umsatz und Betriebsergebnis für den Bereich Imaging and Sensing Solutions. Demnach investiert Sony verstärkt in die Entwicklung neuer Bildsensor-Technologien und plant, das bisherige Zwei-Lagen-Design durch ein dreischichtiges abzulösen.

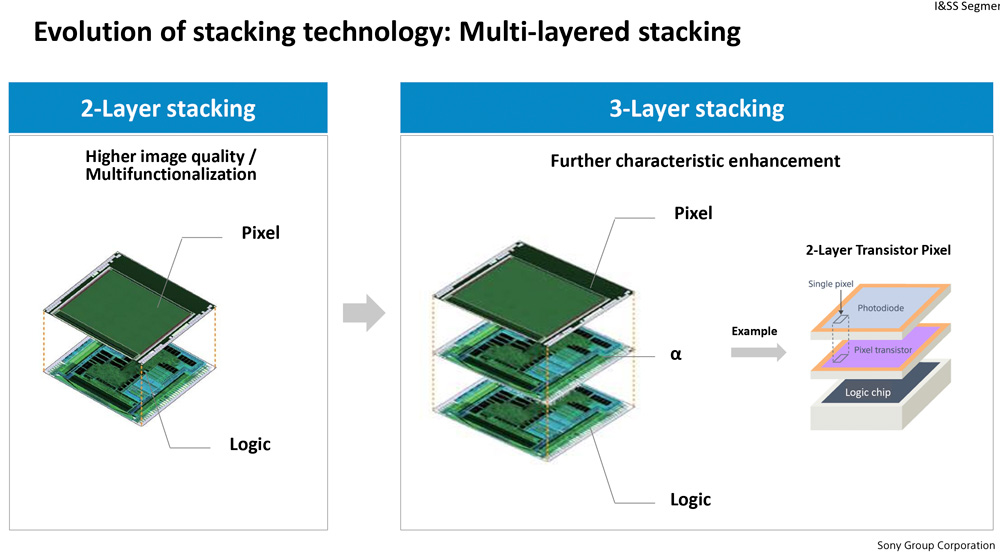

Sony setzt bereits seit einiger Zeit gestapelte Sensoren in seinen Spitzenmodellen wie der α1 II ein. Bislang besteht ein solcher Sensor aus zwei Schichten: einer Photodiodenschicht für die lichtempfindlichen Pixel sowie einer darunterliegenden Transistorschicht für die Signalverarbeitung. Die Tri-Layer-Technik sieht nun eine dritte Schicht vor, was die Verarbeitungskapazität direkt auf Sensorebene deutlich erhöht.

Dabei geht es weniger um eine reine Steigerung der Auflösung als vielmehr um eine generelle Verbesserung verschiedener Schlüsselparameter. Dazu zählen laut Sony die Dynamik (also der Kontrastumfang zwischen den hellsten und dunkelsten Bildbereichen), die Lichtempfindlichkeit, das Rauschverhalten, die Energieeffizienz sowie die Verarbeitungsgeschwindigkeit – speziell mit Blick auf Videomodi. Wenn der Sensor mehr Daten intern verarbeitet, können Bildserien schneller aufgenommen und auch Systeme wie der Autofokus zügiger reagieren.

Nicht trivial sind die Auswirkungen auf den Dynamikumfang. Die Sensorverarbeitung kann diesen steigern, doch das tatsächliche Leistungsvermögen hängt physikalisch an Faktoren wie der sogenannten Full-Well-Kapazität, also wie viele Ladungsträger pro Pixel gespeichert werden können. Baut man jetzt mehrere Funktionslagen übereinander, werden die Pixel unter Umständen kleiner – was wiederum die Kapazität begrenzen könnte. Sony begegnet diesem Problem, indem die Pixeltransistoren unterhalb statt neben den Photodioden angesiedelt werden, was eine Optimierung beider Bauelemente ohne gegenseitige Einbußen erlaubt.

Auch wenn Sony keine unmittelbare Markteinführung angekündigt hat, lässt die Investorensitzung keinen Zweifel am technologischen Ehrgeiz hinter der Weiterentwicklung der Bildsensoren. Insbesondere Video- und Hybridkameras dürften von einem dreilagigen Sensordesign profitieren.

An dieser Technologie dreilagiger Sensoren arbeitet Sony übrigens schon seit Jahren. Sonys Konzept der Aufteilung von Fotodioden und Transistoren auf zwei verschiedene Schichten (mit der Option einer dritten Schicht) hatte ich hier erstmals vor dreieinhalb Jahren beschrieben (https://www.docma.info/blog/sensorgefluester-zweistoeckige-pixel-und-neue-aufloesungsrekorde), und vor zwei Jahren wurde ein Smartphone-Sensor auf dieser Basis vorgestellt (https://www.docma.info/blog/sensorgefluester-die-zweistoeckigen-pixel-sind-da). Irgendwann werden wir sicher auch „richtige“ Kameras mit solchen Sensoren sehen.