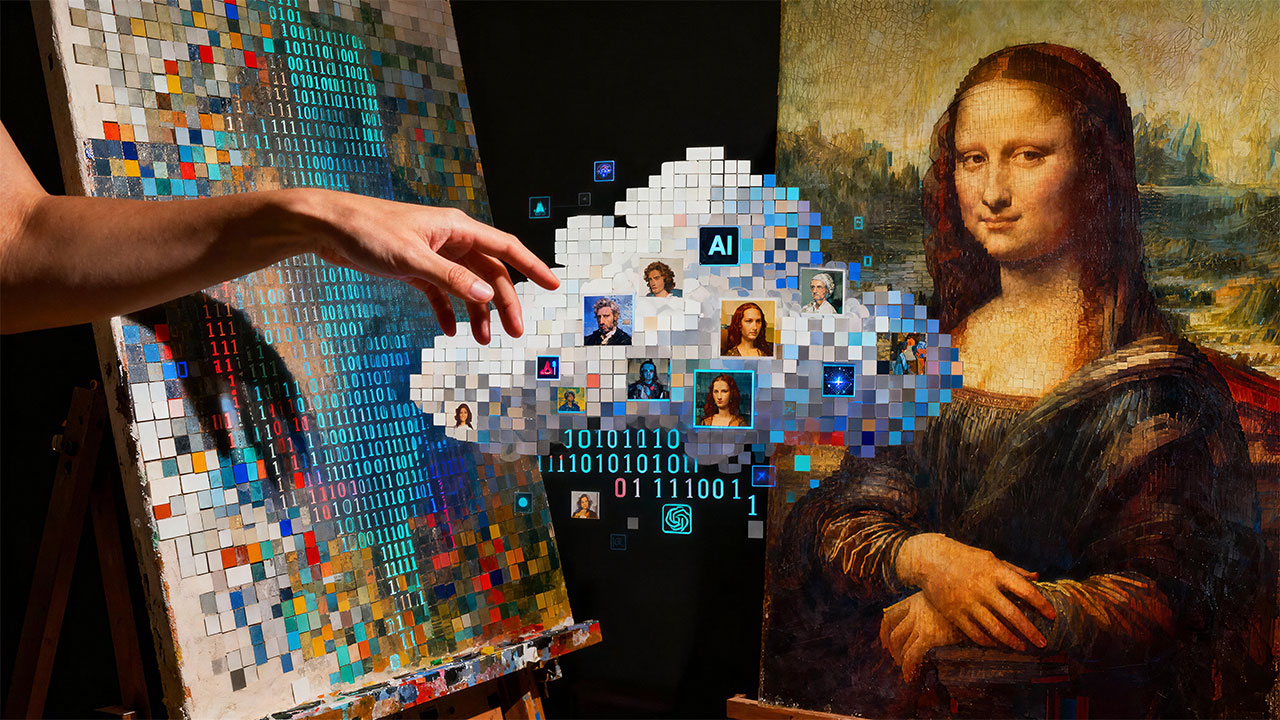

Der Gordische Knoten der KI-Vergütung: Ein gerechter Lohn für Kreative?

Die Debatte um eine faire KI-Vergütung für Kreative, deren Werke zum Training von Bild-KIs herangezogen werden, hat längst die akademischen Zirkel verlassen und ist im harten Alltag der Rechtssprechung angekommen. Urteile wie die Abweisung der Klage des Fotografen Robert Kneschke gegen den LAION e.V. scheinen auf den ersten Blick die Position der KI-Entwickler zu zementieren. Aber es gibt inzwischen auch wieder etwas Hoffnung, wie die Niederlage für ChatGPT vor dem Münchner Gericht zeigt. Generell folgen die Gerichte bislang der Argumentation, dass das bloße Auslesen von Daten zum Anlernen einer KI – das sogenannte Text-und-Data-Mining – nach aktueller Gesetzeslage (§ 44b UrhG in Deutschland, flankiert von der EU-Urheberrechtsrichtlinie) grundsätzlich zulässig ist, sofern die Urheber keinen expliziten Widerspruch eingelegt haben.

Doch dieser juristische Status quo fühlt sich für viele Bildschaffende wie ein fundamentaler Widerspruch zum eigenen Gerechtigkeitsempfinden an. Die Frage sollte daher nicht sein, ob eine KI-Vergütung kommen muss, sondern wie sie aussehen könnte, wenn der politische und gesellschaftliche Druck die Legislative zum Handeln zwingt. Wie lässt sich ein System entwerfen, das nicht nur in Deutschland oder der EU funktioniert, sondern global greift und dem einzelnen Urheber gerecht wird?

Die Fata Morgana der Pauschalabgabe

Der naheliegendste Gedanke führt oft zum Modell der Kopierabgabe, wie wir sie von Druckern, Scannern und Speichermedien kennen. Eine von Verwertungsgesellschaften eingetriebene Pauschale, die nach einem komplexen Schlüssel von der VG Bild-Kunst oder der VG Wort an die Rechteinhaber verteilt wird. Ein bewährtes, wenn auch nicht unumstrittenes System. Doch der Versuch, dieses Prinzip auf das globale Phänomen des KI-Trainings zu übertragen, entpuppt sich bei genauerer Betrachtung als Fata Morgana.

Das Modell scheitert bereits an der fehlenden globalen Infrastruktur. Wer sollte eine Abgabe von einem KI-Unternehmen mit Sitz auf den Cayman-Inseln eintreiben, das seine Modelle mit Servern in Singapur trainiert, auf denen Bilder von einem Amazon-Server in den USA produziert werden? Es gibt keine globale VG Bild-Kunst, keine international gültige Gesetzgebung für eine solche Abgabe, und keine Instanz, die sie weltweit durchsetzen könnte. Eine rein nationale oder europäische Lösung würde vermutlich lediglich zu einer Wettbewerbsverzerrung führen und wäre im globalen Datenstrom leicht zu umgehen.

Das Dilemma der Nachweisbarkeit

Die weitaus größere Hürde ist jedoch das technische Dilemma der Nachweisbarkeit. Eine KI speichert keine Kopien der Trainingsbilder (ein Umstand übrigens, an dem die oben erwähnte Klage von Kneschke erstinstanzlich gescheitert ist). Sie extrahiert statistische Muster, Beziehungen zwischen Bildelementen, Kompositionen und Stile, um daraus eine abstrakte Repräsentation der visuellen Welt zu formen. Nach dem Training ist der direkte Bezug eines generierten Bildes zu einem einzelnen Trainingsbild in der Regel nicht mehr herstellbar.

Dies spaltet das Problem in zwei ungleiche Teile: die Vergangenheit und die Zukunft. Für das bereits erfolgte Training von Modellen wie Midjourney oder Stable Diffusion ist eine exakte, individuelle Zuordnung der Beiträge eine technische Unmöglichkeit. Die Trainingsdatensätze sind oft so gigantisch, dass eine vollständige Analyse und Zuordnung zu einzelnen Urhebern aussichtslos erscheint. Eine nachträgliche Vergütung könnte daher immer nur ein grober politischer Kompromiss sein – eine pauschale Ausschüttung, die sich an der allgemeinen Marktpräsenz eines Künstlers orientiert, aber niemals seiner tatsächlichen Rolle im Trainingsprozess gerecht werden kann.

Für zukünftiges Training ließen sich theoretisch technische Lösungen implementieren: verpflichtende Protokolle der Trainingsdaten, digitale Wasserzeichen oder Opt-in-Systeme, bei denen Urheber ihre Werke aktiv für das Training freigeben. Doch hier kollidiert der Wunsch nach Transparenz mit den Geschäftsgeheimnissen der KI-Konzerne, die ihre Datensätze und Trainingsmethoden als ihr wertvollstes Kapital betrachten.

Zwischen Almosen und Anteil: Die Praxis der Konzerne

Wie eine unzureichende Lösung in der Praxis aussieht, demonstrieren Konzerne wie Adobe. Für die Bereitstellung von Bildern aus dem eigenen Stock-Portfolio zum Training des hauseigenen Modells Firefly erhalten die Bildlieferanten einen jährlichen „Bonus“. Aktuelle Analysen dieser Zahlungen zeigen, dass es sich oft um Beträge im Cent-Bereich pro Bild handelt. Man kann dies als einen ersten Schritt zur Anerkennung des Wertbeitrags sehen. Man kann es aber auch zynisch als eine Art Almosen bezeichnen – eine symbolische Geste, die weit hinter dem tatsächlichen Wert zurückbleibt, den die Daten für die Entwicklung milliardenschwerer Geschäftsmodelle haben. Diese Praxis zementiert ein Machtgefälle, anstatt eine faire Partnerschaft zu begründen.

Die Quadratur des Kreises?

Die bisherigen Ansätze gleichen dem Versuch, ein globales Lauffeuer mit Gießkannen zu löschen. Eine wirklich tragfähige Lösung muss die Schwächen der nationalen Alleingänge und der intransparenten Konzern-Boni überwinden. Sie muss global funktionieren, technisch umsetzbar sein und sowohl die bereits geschehene Ausbeutung adressieren als auch eine faire Grundlage für die Zukunft schaffen. Die Konturen eines solchen Modells könnten wie folgt aussehen:

Ein Lösungsansatz

Der Kern wäre eine globale KI-Wertschöpfungsabgabe. Anstatt Geräte oder einzelne Trainingsläufe zu besteuern, würde eine internationale Übereinkunft eine minimale Abgabe auf die weltweiten Umsätze oder Gewinne der großen KI-Konzerne festlegen. Diese Einnahmen fließen in einen treuhänderisch verwalteten, globalen Fonds. Die eigentliche Innovation liegt jedoch in der zweistufigen Verteilung dieser Mittel, die Vergangenheit und Zukunft getrennt behandelt.

Stufe 1: Die retrospektive Komponente für bekannte Trainingsdaten

Für das bereits erfolgte Training wird ein globales, dezentrales Register geschaffen. Hier können Urheber die digitalen Fingerabdrücke (Hashes) ihrer Werke anmelden. Automatisierte Systeme gleichen diese Hashes dann mit den Inhalten bekannter, offengelegter Trainingsdatensätze wie LAION ab. Die Verteilung eines Teils des Fondsvermögens erfolgt dann auf Basis dieser verifizierten Treffer. Wer nachweisen kann, dass seine Werke Teil des Fundaments aktueller KI-Modelle sind, erhält einen Anteil. Dies ist keine perfekte Gerechtigkeit und für viele Fotografen möglicherweise ein enormer Aufwand, aber es ist eine anerkennende, finanzielle Wiedergutmachung auf Basis nachprüfbarer Fakten – weit mehr als die Almosen, die derzeit gezahlt werden. Und vielleicht könnte spezialisierte Software beim erzeugen der digitalen Fingerabdrücke für ganze Archive helfen.

Stufe 2: Der prospektive „Urheber-Anker“ für die Zukunft

Für alle zukünftig im Netz veröffentlichten Bilder wird ein standardisierter, maschinenlesbarer Metadaten-Container etabliert – eine Art digitaler „Urheber-Anker“ oder Zählpixel. Dieser fälschungssichere Anker, der direkt in die Bilddatei eingebettet wird, enthält eine eindeutige Kennung, die auf den Urheber in einem globalen Register verweist. KI-Unternehmen, die das Web für neue Trainingsdaten durchsuchen, wären durch internationale Abkommen verpflichtet, diese Anker auszulesen und zu protokollieren. Die Vergütung aus dem globalen Fonds würde sich dann dynamisch an der Anzahl der erfassten Werke eines jeden Urhebers in neuen Trainingssätzen orientieren. Das Training würde damit von einem Akt der stillen Aneignung zu einer transparenten, vergüteten Transaktion.

Fazit

Ein solches Hybridmodell wäre ohne Frage eine Herkulesaufgabe. Es erfordert eine beispiellose internationale Kooperation zur Etablierung der KI-Vergütung und zur technischen Standardisierung des Urheber-Ankers. Doch es verlagert die Beweislast dorthin, wo sie hingehört: zu denjenigen, die den Wert aus den Daten ziehen. Es schafft einen Weg, der sowohl die Sünden der Vergangenheit anerkennt als auch einen fairen Rahmen für die Zukunft setzt. Die Alternative wäre, die Wertschöpfung durch kreative Inhalte vollständig den Tech-Konzernen zu überlassen und dann jahrzehntelang zu klagen. Die entscheidende Frage, die sich Bildschaffende stellen müssen, ist daher nicht mehr nur, was ihre Bilder wert sind, sondern ob sie bereit sind, über den Preis ihrer schleichenden Ersetzbarkeit zu verhandeln – oder ob sie beginnen, die Architektur eines Systems zu fordern, das ihren Beitrag nicht nur nutzt, sondern auch vergütet.