Die Stunde der visuellen Forensiker: Was die Maduro-KI-Bild-Affäre über die Zukunft der Wahrheit verrät

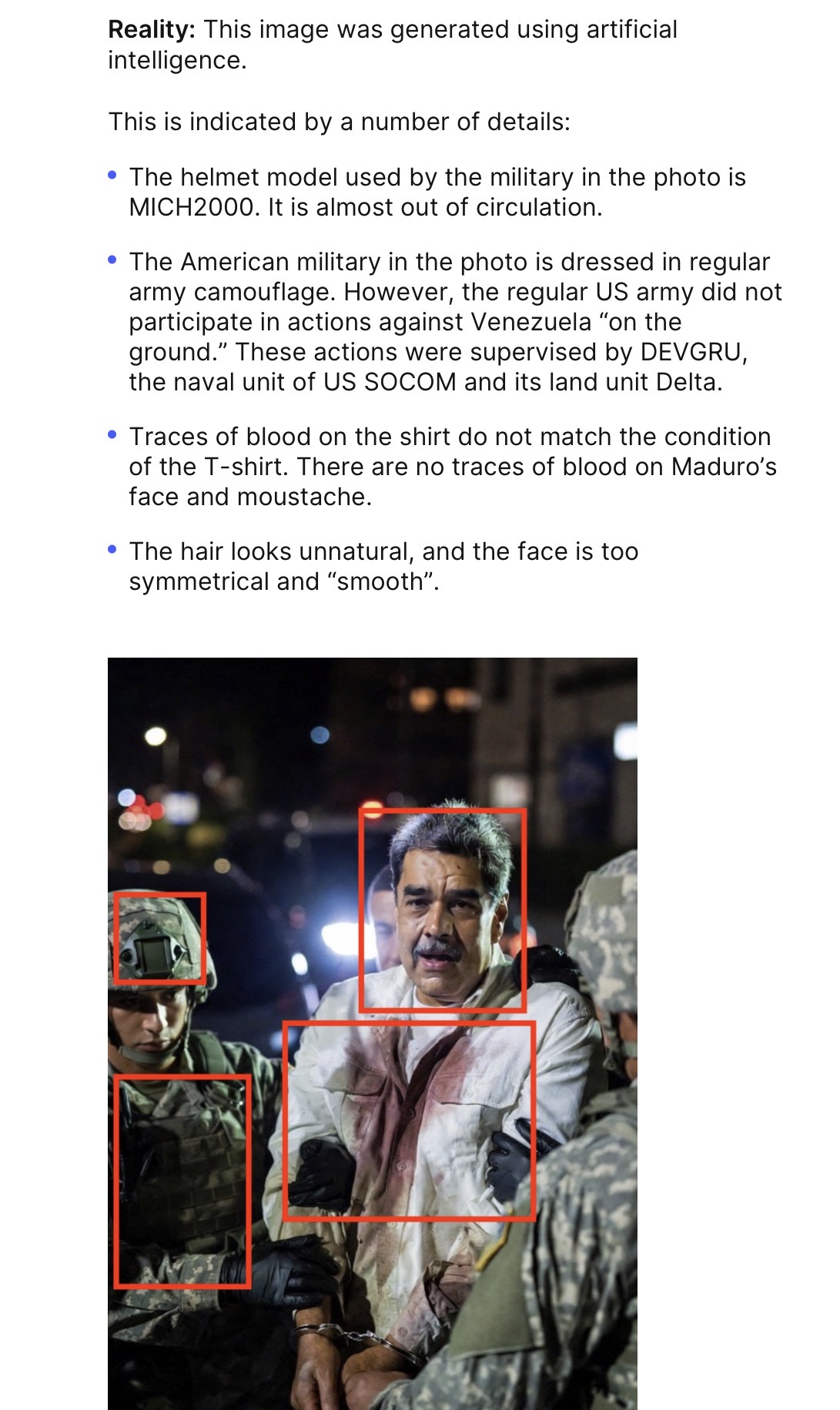

In unserem ersten Beitrag zu diesem Thema haben wir die Anatomie der Täuschung seziert: Wie im Fall der gefälschten Bilder von Nicolás Maduros Festnahme synthetische Medien nicht nur die Öffentlichkeit, sondern auch professionelle Redaktionen in die Irre führten . Wir sprachen von der Demokratisierung der Desinformation und der Erosion des visuellen Urvertrauens . Doch die Analyse des Problems ist nur der erste Schritt. Die entscheidende Frage, die sich nun stellt, ist die nach der Konsequenz. Die Funke-Mediengruppe erklärte in ihrer Entschuldigung, man habe sich in der unübersichtlichen Nachrichtenlage auf die Sorgfalt renommierter Agenturen verlassen, mit denen man teils seit Jahrzehnten kooperiere. Diese Aussage, so nachvollziehbar sie im hektischen Redaktionsalltag klingen mag, offenbart den Kern des Dilemmas: Sie beschreibt ein Vertrauensmodell aus einer analogen Vergangenheit, das in der Ära der synthetischen Realität nicht mehr tragfähig ist. Das KI generierte Maduro Bild ist somit ein Weckruf für alle, die professionell mit Bildern arbeiten.

Das Ende der delegierten Verantwortung

Der Verweis auf etablierte Partner wie Bildagenturen war lange Zeit der Goldstandard der Verifikation. Er funktionierte als eine Art ausgelagerte Sorgfaltspflicht. Doch dieses System bricht zusammen, wenn die Quellen selbst kontaminiert sein können und die schiere Menge an Material jede manuelle Prüfung ad absurdum führt. In den Stunden nach dem US-Angriff mit dem Codenamen „Operation Absolute Resolve“ liefen allein bei einer Mediengruppe rund 10.000 Bilder ein. In einer solchen Datenflut kann ein perfekt gemachtes KI-Bild durch die Maschen selbst der besten Agentur rutschen. Die Verantwortung lässt sich nicht mehr delegieren. Sie zerfällt und verteilt sich auf jeden Einzelnen in der Kette der visuellen Kommunikation – vom Fotografen vor Ort über den Retuscheur am Rechner bis zum Redakteur, der die finale Entscheidung zur Publikation trifft. Jeder Klick wird zu einer ethischen Weichenstellung. Das alte Paradigma „Vertrauen ist gut, Kontrolle ist besser“ wird abgelöst durch die bittere Erkenntnis: Vertrauen ist nicht mehr möglich, forensische Prüfung ist Pflicht.

Proaktive Transparenz: Die neue Währung des Vertrauens

Wenn wir die Authentizität eines Bildes nicht mehr zweifelsfrei optisch feststellen können, brauchen wir neue Werkzeuge: Eins könnte sein, den Spieß umzudrehen: Wir müssen die Authentizität von Anfang an in das Bild einbauen. Die Zukunft der glaubwürdigen visuellen Kommunikation liegt in einer radikalen, proaktiven Transparenz. Für Bildschaffende bedeutet dies einen fundamentalen Wandel ihrer Arbeitsweise. Es reicht nicht mehr, ein technisch perfektes Bild abzuliefern. Künftig wird es darum gehen, den gesamten Entstehungsprozess lückenlos zu dokumentieren und diese Dokumentation als untrennbaren Teil des Werkes zu begreifen.

Stellen Sie sich eine Art digitalen Herkunftsnachweis vor, der direkt in die Metadaten einer Bilddatei eingeschrieben wird. Er könnte Informationen über die verwendete Kameratechnik, den genauen Aufnahmezeitpunkt und -ort via GPS sowie eine kryptografisch gesicherte Signatur des Fotografen enthalten. Jeder Bearbeitungsschritt in der Postproduktion, jede Tonwertkorrektur, jede Retusche müsste als nachvollziehbare Ebene in einer Bearbeitungshistorie protokolliert werden – nicht um die Bearbeitung zu verurteilen, sondern um sie transparent zu machen. Der Betrachter erhielte so nicht nur das finale Bild, sondern auch dessen „Biografie“. Er könnte sehen, dass ein Bild zwar nachgeschärft und farblich angepasst, aber in seiner Kernaussage nicht manipuliert wurde. Diese Fälschungssicherheit ist keine Zukunftsmusik, sondern zumindest technisch bereits seit 2023 möglich, auch wenn es noch an letzten Details hakt. Bis dahin könnte es schon helfen, nur Bilder ins Agentur-System zu nehmen, die wenigsten mit allen Exif-Daten und/oder – besser noch – als Raw-Dateien angeliefert werden.

Vom Dokumentaristen zum Kontext-Kurator

Diese Entwicklung verändert die Rolle des Bildbearbeiters und des Bildredakteurs von Grund auf. Aus reinen Ästheten und Technikern werden visuelle Forensiker und Kontext-Kuratoren. Ihre Aufgabe ist es nicht mehr nur, ein Bild bestmöglich aussehen zu lassen, sondern seine Integrität zu bewahren und zu zertifizieren. Sie entwickeln sich den Notaren der visuellen Welt, die die Echtheit einer Aufnahme beglaubigen, indem sie deren Entstehungsgeschichte offenlegen.

Dies mag auf den ersten Blick wie ein technokratischer Mehraufwand klingen, doch es ist in Wahrheit eine enorme Aufwertung der professionellen Bildarbeit. Wenn eine Agentur oder Redaktion von einer Flut beliebiger und oft irreführender KI-Bilder überschwemmt wird, entwickelt sich das professionell verifizierte und transparent dokumentierte Bild zu einem raren und kostbaren Gut. Es wird zur neuen Leitwährung im Kampf um Aufmerksamkeit und Glaubwürdigkeit. Die Fähigkeit, nicht nur ein schönes, sondern ein beweisbar authentisches Bild zu liefern, könnte sich zum entscheidenden Qualitätsmerkmal und zum wirtschaftlichen Vorteil entwickeln. Die Maduro-KI-Bild-Lüge hat uns schmerzhaft vor Augen geführt, wie fragil die visuelle Wahrheit geworden ist und wie ohnmächtig die Gatekeeper in den Medien. Doch sie bietet uns auch die Chance, den Wert und die Bedeutung professioneller Bildarbeit neu zu definieren und für die Zukunft zu stärken.

Ich frage mich, warum die KI KI-generierte Bilder nicht (aus)sortieren kann.

KI-Bilder zweifelsfrei identifizieren geht 100% sicher sicher nur noch anhand von Metadaten und/oder digitalen Zertifikaten für mit einer Kamera aufgenommene Fotos. Aber Bilder ohne Metadaten kann aber jede Bildverwaltung aussortieren 🙂

Grundsätzlich finde ich so eine Kennzeichnungspflicht in den Metadaten durchaus gut. Aber:

– welcher Fotograf würde seine RAW-Dateien aus der Hand geben, wie im Artikel angeregt?

– Bearbeitungsschritte offen zu legen, fällt sicherlich auch dem einen oder anderen Fotografen schwer, weil er damit ein Teil seiner Kreativität preisgibt.

Hier geht es weniger um kreative Fotografen, sondern eher um solche, deren Bilder der Berichterstattung dienen. Die sollen/dürfen sie ja nicht bearbeiten.

Bei vielen Wettbewerben müssen die Teilnehmer ihre Raw-Dateien vorlegen, um nachzuweisen, dass sie keine unerlaubten Manipulationen vorgenommen haben. Zumindest diejenigen, die Aussicht haben, ausgezeichnet zu werden. Das war beispielsweise schon beim World Press Photo Award 2013 so, als Paul Hansen die Raw-Datei seines Siegerfotos vorlegen musste. Keine Raw-Datei, kein Preis – isso.

Die raw-Datei (= digitales Negativ) ist der Beweis, dass es mein Foto ist. Aber eine raw-Datei muss technisch interpretiert werden, damit daraus ein Foto wird. Technisch ist sie ja „nur“ eine Tabelle mit ausgelesenen Spannungen pro Pixel. Je nach raw-Konverter kann das Ergebnis unterschiedlich ausfallen. Auch kann man beim Entwicklungsprozess sehr effektiv entrauschen, auch mit KI-Unterstützung. Ist das dann noch erlaubt?

Durch die raw-Entwicklung habe ich die Möglichkeit, das technische Bild, was den Einschränkungen der Kamera unterworfen ist, so auszuarbeiten, dass mein realer Augeneindruck wiedergegeben wird. Das „wahre“ Bild ist in meiner Erinnerung bzw. das, was davon übrig geblieben ist. Diese Umkehrung wird in der gegenwärtigen Debatte gar nicht berücksichtigt. Und wenn man diesen Sachverhalt genauer anschaut, wird es immer schwieriger, denn bereits die Algorithmen in der Kamera sind Interpretationen von etwas, was wir sehen.

KI-gestütztes Entrauschen wird niemand disqualifizieren wollen, weil es grundsätzlich nichts anderes als konventionelle Entrauschungsverfahren macht – es macht es nur besser. Dasselbe gilt für KI-gestütztes Demosaicing. Aus dem Vergleich der Raw-Datei mit dem eingereichten Bild kann man erschließen, ob der Fotograf eine unerlaubte Manipulation vorgenommen hat, wobei jeder Veranstalter eines Wettbewerbs eigene Regeln aufstellen kann, welche Art von Bildbearbeitung statthaft ist und welche nicht – für Naturfotos gelten meist strengere Regeln als für die künstlerische Fotografie. Ebenso gibt es eigene, strengere Regeln für die dokumentarische Fotografie.

Hallo zusammen

ich lese immer wieder, dass sich irgendwelche Echtheiten in den Metadaten verewigen lassen.

Als ob diese unzerstörbar seien.

In wie weit überleben die Metadaten die primitive Einfügung als Ebene in ein Bild mit KI-sauberen/KI-freien Metadaten?

Da bleiben dann doch bloß nackte (gefakte) Pixel übrig mit neuen sauberen Metadaten der Hintergrundebene – Eine Ebene machen, schon sind die Security-Metadaten weg.

So ähnlich wie neue Papiere für ein geklautes Auto – oder so.

Grüße

Natürlich kann man Metadaten löschen, aber beim CAI/C2PA-Standard ist das aus mehreren Gründen kein Problem. Ich hatte das vor anderthalb Jahren schon mal in DOCMA 110 erklärt.

Ich nochmal…

Im übrigen ist das Beispielbild mit den Hubschraubern in Teil1

https://www.docma.info/blog/synthetische-wahrheit-wenn-ki-bilder-die-realitat-neu-verhandelnk

so was von stümperhaft

gemacht, dass DocB bei einer Perspektivanalyse die Maus zerquetschen dürfte.

Noch erkennt man so einen Mist in der immer zu hohen Bildschärfe, den zu hohen Kontrasten

und der zu hohen Klarheit.

Glutamat eben.

Als Schulfach rege ich ab der ersten Klasse und vor allem ab Handyalter das visuelle Hinterfragen an, oder einfach ein Wiedererlernen vom Sehen wie die Wirklichkeit aussieht und wie man demnach Fakes erkennt.

Just my two cents