Adobe bringt KI-Assistenten für Photoshop Web und Mobile und erweitert den Firefly Image Editor

Adobe erweitert die Leistungsfähigkeit der dialogorientierten KI um neue Funktionen zur Fotobearbeitung durch einen dialogorientierten KI-Assistenten für Adobe Photoshop Web und Mobile sowie neue Bearbeitungswerkzeuge im Adobe Firefly Image Editor.

KI-Assistent in Photoshop: Bearbeitung per Sprache und Text

Der KI-Assistent für Photoshop Web und Mobile steht ab sofort als öffentliche Beta – also als öffentlich zugängliche Testversion vor dem endgültigen Release – zur Verfügung. Der KI-Assistent ermöglicht es, eine gewünschte Änderung in eigenen Worten zu diktieren, beispielsweise „Entferne den Hintergrund und helle das Gesicht auf“. Der Assistent setzt die Anweisung entweder automatisch um oder führt den Nutzer in einzelnen Schritten durch den Prozess – je nachdem, welche Option man wählt. In der mobilen Photoshop-App lassen sich Anweisungen sogar durch Sprechen eingeben. Wer mit einem Stativ vor Ort arbeitet, kann Korrekturen diktieren, ohne auf dem Smartphone tippen zu müssen.

Ergänzend dazu führt Adobe in Photoshop Web die Funktion „AI Markup“ (ebenfalls öffentliche Beta) ein. Sie ermöglicht es, direkt auf dem Bild zu zeichnen und den markierten Bereich mit einem Textbefehl zu verknüpfen. Wer etwa den Himmel in einem Landschaftsbild verändern möchte, zieht mit dem Finger oder der Maus über den Bereich und gibt ein: „Ersetze durch dramatische Gewitterwolken.“ Photoshop generiert das Ergebnis innerhalb weniger Sekunden.

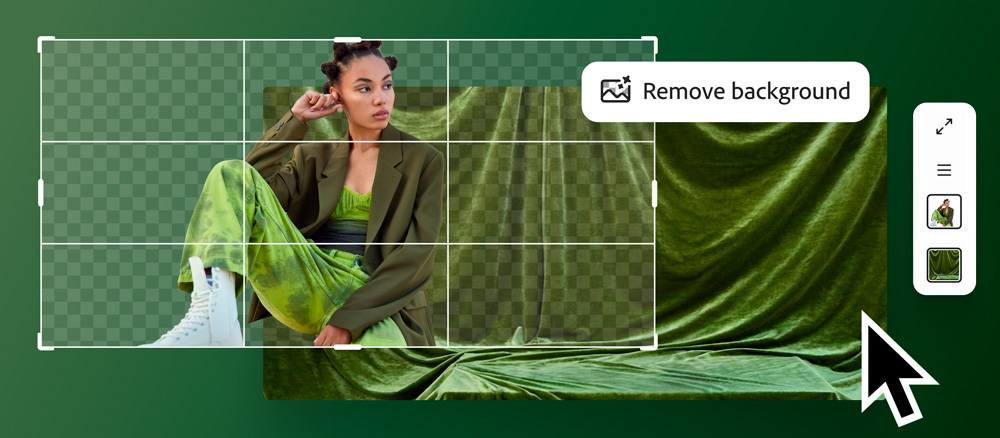

Der Assistent unterstützt Aufgaben wie das Entfernen störender Personen oder Objekte, das Anpassen von Licht und Farbe sowie das Freistellen von Motiven – allesamt Arbeitsschritte, die bislang mehrere Ebenen, Masken und Werkzeugwechsel erforderten.

Zahlende Photoshop-Abonnenten können den KI-Assistenten bis zum 9. April 2026 unbegrenzt nutzen. Nutzer der kostenlosen Photoshop-Web-Version starten mit 20 kostenlosen Generierungen.

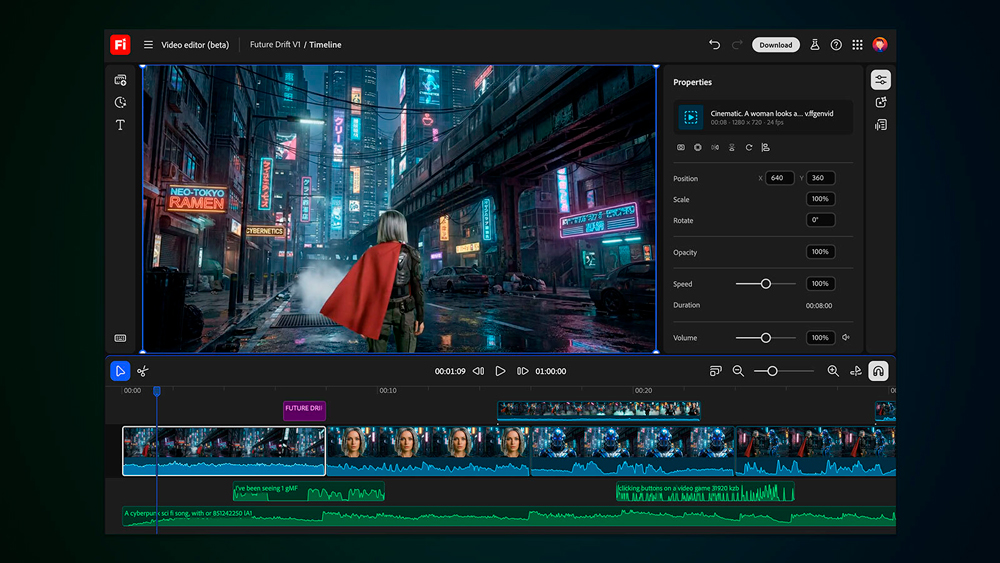

Firefly Image Editor: Fünf neue Bearbeitungsfunktionen in einem Arbeitsbereich

Parallel dazu hat Adobe den Firefly Image Editor – Adobes browserbasiertes KI-Studio – deutlich ausgebaut. Alle neuen Werkzeuge sind per Texteingabe steuerbar, ohne dass der Nutzer zwischen verschiedenen Reitern oder Menüs wechseln muss. Die fünf neuen Funktionen im Einzelnen:

Generatives Füllen ersetzt oder ergänzt Bildbereiche auf Basis einer Texteingabe. Wer auf einem Modefoto das Kleid in einer anderen Farbe sehen möchte, markiert es und gibt die gewünschte Farbe an – das Modell berechnet Licht, Schatten und Textur automatisch mit.

Generatives Entfernen löscht unerwünschte Objekte aus einem Bild und füllt den entstehenden Bereich plausibel mit dem umgebenden Bildinhalt. Ein Straßenschild, das in einer Architekturaufnahme stört, lässt sich so in Sekunden beseitigen.

Generatives Erweitern passt ein Bild an neue Seitenverhältnisse an, indem es die Ränder des Motivs mit passendem Bildinhalt ergänzt. Ein Hochformatbild wird damit zum Querformat – ohne sichtbare Kante.

Generatives Hochskalieren erhöht die Bildauflösung und schärft Details nach. Das kommt vor allem dann zum Tragen, wenn ältere oder niedrig aufgelöste Aufnahmen für den Großformatdruck vorbereitet werden sollen.

Hintergrund entfernen isoliert das Hauptmotiv per Mausklick vom Hintergrund – ein Arbeitsschritt, der früher mehrere Minuten Feinarbeit mit der Freistell-Maske erforderte.

Alle fünf Funktionen sind ab sofort weltweit im Firefly Image Editor verfügbar. Firefly-Abonnenten können sie derzeit unbegrenzt nutzen.

Auch Drittanbieter-KI verfügbar

Im Firefly Image Editor lassen sich mehr als 25 verschiedene KI-Modelle auswählen. Darunter befinden sich neben Adobes eigenen, kommerziell lizenzierten Modellen auch Nano Banana 2 von Google (Gemini 3.1 Flash Image), das Bildgenerierungsmodell von OpenAI, Gen-4.5 von Runway sowie Flux.2 [pro] von Black Forest Labs. Wer mit einem bestimmten Modell generiert hat, kann das Bild anschließend direkt im selben Editor weiterbearbeiten.

Mehr dazu lesen Sie im Adobe Blog.