KI-Bildkennzeichnung, EU AI Act und Fotografie: Warum wir einen Digitalbild-Codex brauchen

Wer heute ein Bild betrachtet, weiß oft nicht mehr, was er eigentlich sieht. Zwischen Kamera, KI und Photoshop verschwimmen die Grenzen – und mit ihnen das Vertrauen. Dieser Vorschlag aus der DOCMA-Redaktion lädt dazu ein, über ein neues Klassifikationsmodell für Bilder zu diskutieren.

Vertrauen ist das eigentliche Bild

Man kennt die Szene: Beim Durchstöbern eines Wettbewerbsportals bleibt der Blick an einer Landschaft hängen: Der Himmel dramatisch, das Licht wie gemalt. Kategorie: Fotografie. Ein Klick auf die Details, und plötzlich steht da: „Mit generativer KI erweitert.“ In einer anderen Kategorie ein Porträt: Makellos, aber irgendwie zu glatt. „AI Art“, heißt es. Doch was bedeutet das? Wurde hier ein Foto verfeinert, ein Motiv synthetisiert, eine Identität erschaffen, die nie existierte?

Diese Unschärfe ist nur auf en ersten Blick ein ästhetisches Problem. Im Kern handelt es sich um ein Vertrauensproblem. Zwischen klassischer Fotografie, KI-gestützter Nachbearbeitung und vollsynthetischer Bildschöpfung herrscht noch ein babylonisches Sprachgewirr. Das hat ganz praktische Folgen für Fotografen, Redaktionen, Agenturen und Auftraggeber. Was fehlt, ist ein gemeinsames Vokabular: ein System, das beschreibt und auszeichnet, um was für ein Bild es sich handelt. Ohne zu werten. Genau hier setzt der Vorschlag an.

Was es schon gibt – und warum es nicht reicht

Die Branche steht längst nicht mehr hilflos vor demProblem. Die C2PA-Initiative versieht Bilder mit kryptografisch signierten Herkunftsnachweisen und wird von Leica (M11-P, SL3), Sony, Adobe und OpenAI (DALL-E, Sora) unterstützt. Nikon hatte C2PA für die Z6 III eingeführt, musste die Funktion nach einer gravierenden Sicherheitslücke jedoch wieder aussetzen und alle Zertifikate widerrufen.

Adobe setzt auf „Content Credentials“, die Bearbeitungsschritte dokumentieren. Die IPTC-Metadaten kennen das Feld „DigitalSourceType“ und unterscheiden zwischen Kameraaufnahme und KI-generierten Medien. Der Deutsche Presserat fordert die Kennzeichnung von Symbolfotos und Montagen; eine Forderung, die sich bald zwingend auf KI-Bilder ausweiten dürfte.

Doch all diese Ansätze teilen einen strukturellen Schwachpunkt: Metadaten werden von sozialen Netzwerken und Plattformen oft entfernt. Die Kennzeichnung bleibt freiwillig, die Kontrolle zahnlos. Und selbst ein sichtbares C2PA-Badge wird möglicherweise von vielen Endanwendern als Warnung missverstanden, obwohl es Authentizität belegen soll. Ein Etikett, das niemand versteht, schafft kein Vertrauen, sondern Rauschen.

Hier drängt sich der Vergleich aus einer anderen Welt auf: dem französischen Appellation-System. Erst ein verbindliches, verständliches Klassifikationssystem machte Herkunft, Methode und Charakter eines Weins sichtbar – und ermöglichte so erst ein fundiertes Urteil ermöglicht.

Der EU AI Act: Gesetzlicher Rahmen, kein Kompass für die Praxis

Ab dem 2. August 2026 gilt: Wer KI-generierte oder KI-manipulierte Bilder veröffentlicht, muss sie doppelt kennzeichnen: maschinenlesbar und für Menschen sichtbar. Die Pflicht trifft nicht nur die Hersteller von KI-Werkzeugen, sondern auch jeden, der solche Bilder nutzt: von der Werbeagentur bis zum Blogger. Deepfakes müssen explizit ausgewiesen werden. Für künstlerische oder satirische Werke reicht ein allgemeiner Hinweis, solange der Werkgenuss nicht beeinträchtigt wird. Wer sich nicht daran hält, riskiert Bußgelder bis zu 15 Millionen Euro oder drei Prozent des weltweiten Jahresumsatzes.

Ein einheitliches EU-Icon ist noch nicht final verabschiedet; eine Taskforce arbeitet an einer harmonisierten Lösung. Bis dahin empfiehlt es sich ein Interims-Icon, etwa ein zweibuchstabiges Kürzel wie „AI“ oder „KI“, zu verwenden.

So wichtig dieser Rechtsrahmen ist, er löst das eigentliche Problem nicht. Das Gesetz definiert ein Minimum, keine Differenzierung. Es unterscheidet im Grunde nicht zwischen dem Journalistenfoto, das KI nur zur Rauschminderung nutzt, und dem vollsynthetischen Bild, das nie eine Kamera gesehen hat. Für die tägliche Arbeit in Redaktionen, Agenturen und Studios braucht es mehr als eine Ja/Nein-Kennzeichnung.

Sechs Stufen für eine neue Bild-Ehrlichkeit

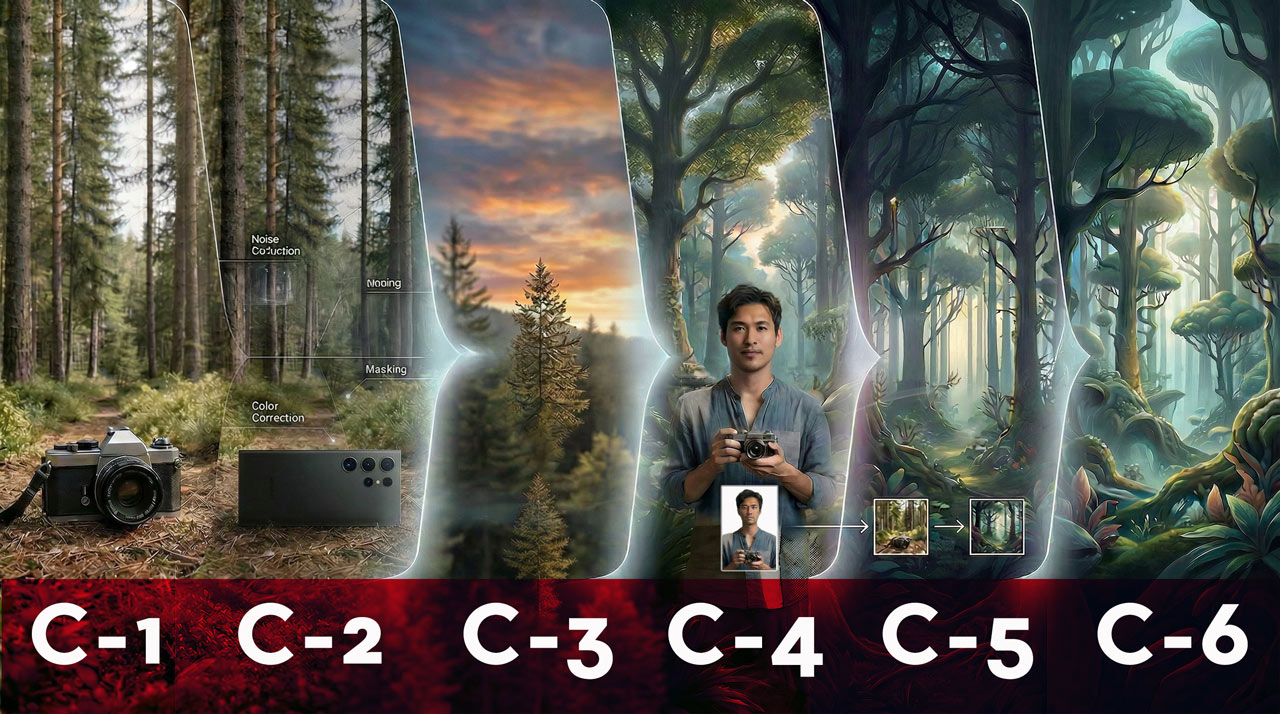

Unser Codex-Vorschlag sieht ein Stufenmodell vor, das von der reinen Fotografie bis zur vollständigen KI-Generierung reicht. Jede Stufe trägt ein Kürzel (C-1 bis C-6) und benennt präzise, was gemacht wurde – ohne zu werten.

C-1 – Reine Fotografie

Das Bild stammt aus einer Kamera ohne KI-Funktionen. Der Mensch entscheidet über Motiv, Licht und Moment; die Nachbearbeitung beschränkt sich auf klassische an die Dunkelkammer erinnernde Werkzeuge wie Helligkeit und Kontrast. Keine KI, nirgends. Hier steht die Dokumentarfotografie.

C-2 – KI-gestützte Fotografie

Die (Smartphone)-Kamera liefert das Bild, KI übernimmt handwerkliche Veredelung: Rauschminderung, Schärfung, Farbkorrektur, Freistellen per Maske. Inhalte bleiben unangetastet; die KI ist unsichtbarer Assistent. Dieses Niveau beschreibt heute schon den Alltag vieler Fotografen und es werden in Zukunft mehr sein, die KI-gestützte Kamerasysteme oder Raw-Entwickler mit KI-Funktionen nutzen.

C-3 – KI-erweiterte Fotografie

Hier greift die KI in den Bildinhalt ein: Generative Fill entfernt störende Elemente, der Himmel wird optimiert oder ausgetauscht, die Farbigkeit wird angepasst, Hintergründe etwa hinsichtlich ihrer Tiefenschärfe überarbeitet. Der fotografische Kern bleibt erkennbar, aber die Szene wurde interpretiert. Offenlegung ist ab hier Pflicht, nicht unbedingt juristisch, aber aus beruflichem Ethos.

C-4 – Fotografisch-KI-Hybrid

Fotografische und synthetische Elemente verschmelzen: echte Porträts auf KI-Hintergründen (oder wie hier anders herum), reale Objekte in generativ ergänzten Szenen, großflächiges Inpainting. Weder reine Fotografie noch reine KI-Generate und oft gerade deshalb besonders ausdrucksstark, aber zwingend kennzeichnungspflichtig.

C-5 – KI-Generate mit fotografischen Elementen

Das Bild ist primär KI-generiert, nutzt jedoch Fotos als Stilvorlage, als Zugabe zum Prompt, als Charakter-Vorgabe, also als Ausgangsmaterial für Bild-zu-Bild-Verfahren. Das Ergebnis ist klar als synthetisches Bild erkennbar; die Fotografie dient noch als Rohstoff.

C-6 – Reine KI-Generierung

Das Bild entsteht vollständig aus Texteingaben, ohne fotografische Vorlage. Werkzeuge wie GPT Image, Firefly, Nanao Banana oder Midjourney sind hier im Einsatz, KI-Artists die Urheber –

oder eben nicht, je nachdem wie sich die Rechtssprechung entwickelt.

Die Zuordnung zu den gesetzlichen Pflichten des EU AI Act ist eindeutig: C-1 und C-2 sind von der Kennzeichnungspflicht ausgenommen. C-3 liegt in der Grauzone, verlangt aber vielleicht aus ethischen Gründen einen Hinweis auf KI-Erweiterung. C-4 bis C-6 erfordern volle Kennzeichnung, maschinenlesbar und für den Betrachter sichtbar.

Was das in der Praxis bedeutet

Für Fotografen im Journalismus und in der Dokumentation ist C-1 die Heimzone; C-2 ist akzeptabel, solange transparent kommuniziert wird. C-3 markiert die eigentliche rote Linie: Wer hier arbeitet, sollte von sich aus kennzeichnen, unabhängig davon, ob das Gesetz es bereits verlangt. World Press Photo zum Beispiel hat KI-generierte Bilder, einschließlich generativer Füllungen, aus allen Wettbewerbskategorien ausgeschlossen.

Retuscheure und Bildbearbeiter bewegen sich täglich zwischen C-2 und C-4. Und das oft ohne dass Kunden oder Auftraggeber wissen, was genau in der Nachbearbeitung geschieht. Adobe Content Credentials dokumentieren KI-Schritte bereits heute automatisch; die Herausforderung bleibt, diesen Herkunftsnachweis plattformübergreifend zu sichern. Grafiker und kreative Bildgestalter, die in C-4 bis C-6 arbeiten, arbeiten mit der Kennzeichnung EU-gesetzeskonform unter Transparenz.

Ein Blick zu den Stock-Agenturen

Adobe Stock akzeptiert KI-generierte Bilder aller Tools, sofern sie klar als solche gekennzeichnet werden. Shutterstock hingegen verbietet sämtliche KI-generierte Inhalte von externen Anbietern; nur Bilder, die direkt mit dem eigenen KI-Tool auf der Plattform erzeugt werden, stehen Kunden zur Verfügung, ein Upload durch Nutzer ist nicht möglich. Getty Images untersagt sämtliche KI-generierte Uploads von außen; Bilder aus dem eigenen KI-System sind ausschließlich für Direktlizenzen verfügbar.

Für KI-Artists ordnet das Stufenmodell die eigene Arbeit ein, ohne sie zu disqualifizieren. Die künstlerische Ausnahmeregelung im EU AI Act greift hier: Ein allgemeiner Hinweis genügt, solange der Werkgenuss nicht gestört wird. Langfristig könnte das Modell dazu beitragen, KI-Generate als eigenständige Bildgattung zu etablieren.

Die technische Architektur

Das Modell ist mehrschichtig aufgebaut. Sichtbar: ein Label mit C-Nummer oder einem kleinen Icon im Bild oder in der Bildunterschrift. Maschinenlesbar: das IPTC-Feld „DigitalSourceType“, ergänzt um ein spezifisches Feld für die Stufe. C-1 entspricht „digitalCapture“, C-2 ebenfalls, jedoch mit KI-Werkzeugvermerk ohne Inhaltsänderung, C-3 bis C-6 nutzen „trainedAlgorithmicMedia“ mit Abstufungen. Optional kann ein C2PA-Herkunftsnachweis die Bearbeitungskette kryptografisch dokumentieren. Damit ist das Modell von Beginn an EU-konform und in bestehende Infrastrukturen integrierbar.

Mehr als ein Etikett

Die Frage, was ein Foto ist, begleitet die Fotografie seit 1839. Schon damals stritten Maler und Lichtbildner über die Grenzen des Mediums. In den 1990er Jahren entbrannte die Debatte um digitale Manipulation. Dann kam CGI und mischte die Karten wein weiteres Mal. Heute verschiebt die generative KI die Grenze erneut, nur schneller, grundlegender, mit weitreichenderen Folgen für das Vertrauen in Bilder.

Zur Diskussion

Das hier vorgestellte Stufenmodell ist kein Polizeiinstrument und kein Rückzugsgefecht. Es ist ein Diskussionsangebot: eine gemeinsame Sprache für eine Branche im Wandel, ein Rahmen, der nicht bestraft, sondern unterscheidet. Die eigentliche Frage lautet nicht, welche Software genutzt wurde. Sie lautet: Welches Vertrauensverhältnis besteht zwischen dem, der ein Bild zeigt, und dem, der es sieht? Das Modell gibt diesem Versprechen einen Namen – und lädt zur Debatte ein.

Und wann verstehen Sie, dass Fotografie nur noch der Anfang ist? Christoph Künne verbindet über drei Jahrzehnte Expertise in Post-Photography mit modernster KI-Praxis und coacht Medienteams dabei, die Grenzen zwischen Kamera, Composing und generativer Bildkunst produktiv aufzulösen.

Hallo, Christoph,

nett gedacht, halte ich aber für zu kompliziert. Wozu die feine Klassifizierung, des Rohmaterials, wenn’s am Ende doch um den Kontext der Nutzung geht und die dort akzeptablen Eingriffe?

Grundlage für die Klassifizierung müssten ja in jedem Fall Provenienzdaten sein, die Quelle und Modifikationen bis zur Übergabe des Bilderzeugnisses dokumentieren.

Ich (bzw. im EU-Konsultationsprozess der Fotorat) plädiere daher für eine verpflichtende Pipeline für Provenienzdaten (die im 1. Entwurf des Code of Practise zur Transparenzregel noch obligatorisch waren, im 2. Entwurf nur noch optional), welche Digital Source (Kamera, Software, GenKI….) zeigen und nachfolgende Editiervorgänge automatisch (ohne händische Eingaben) protokollieren (bereits recht fortgeschritten in C2PA-Mechanismen bereits implementiert).

Basierend darauf könnten dann bei Publikation Vertrauenszonen definiert werden (ähnlich deiner „Heimzone“). Und da genügen eher wenige. Z.B. T1 (Trust Zone) für den Journalismus. Hier akzeptiert man kamerabasierte Bilder (idealerweise schon in der Kamera signiert, oder von einer vertrauenswürdigen Quelle verbürgt) mit Nachbearbeitungen, wie sie z.B. die Liste von World Press Photo erlaubt.

In T2 sind größere Freiräume bei der Nachbearbeitung erlaubt, z.B. das Retuschieren von Bildelementen oder größere Farb/Kontraseingriffe, die World Press verbietet.

T3 ist dann Freestyle, wie in der Werbung üblich. Da spielt es eigentlich keine Rolle, welche Werkzeuge verwendet werden.

Wichtig: Die Abwesenheit von Provenienzdaten ist auch ein wichtiges Signal, nämlich dass das Bild nicht für eine Verwendung in T1 geeignet ist.

In einer Zeit der beliebig formbaren Realität werden Provenienzdaten genauso wichtig wie die Bilddaten selbst. Noch mehr Label nützen da nichts. Wer Authentizität behaupt, muss diese auch nachprüfbar zeigen können. Und das sollte nicht durch noch mehr Bürokratie (wie in der DSGVO) geschehen sondern durch unterstützende Software-Helferlein.

Viele Grüße

Jürgen Scriba

Ja, ich hatte auch schon in einem Facebook-Kommentar zu diesem Artikel (die meisten kommentiere ja dort und nicht hier) geschrieben, dass Content Credentials nach CAI/C2PA-Standard die Basis von allem sind; Klassifizierungen müssen darauf aufsetzen, wenn sie irgendeine Aussagekraft haben sollen. Und was für Klassen man dann definieren sollte, hängt von den Zwecken ab, die man damit verfolgt; das sind im Journalismus andere als in einem Fotowettbewerb oder vor Gericht, um nur ein paar Beispiele zu nennen.