Wenn Gesichtserkennung KI-Fehler macht: Wie eine Großmutter zur Hauptdarstellerin im Justizthriller wurde

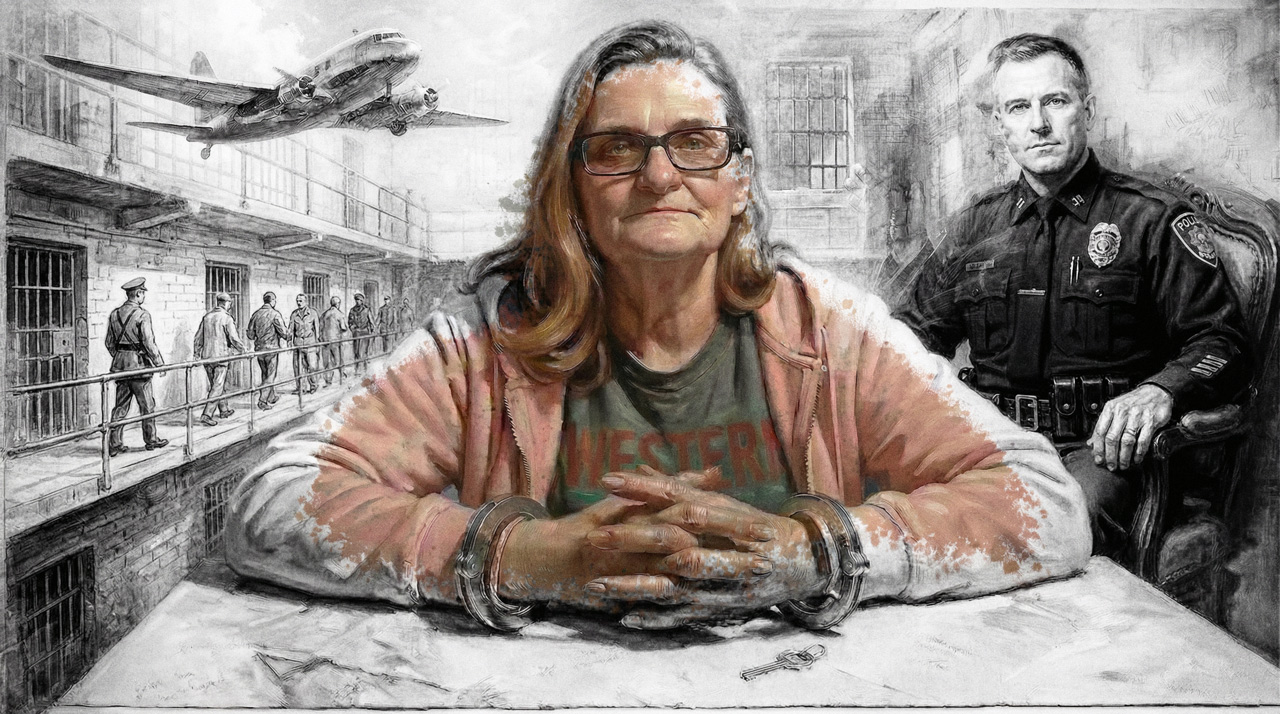

Es gibt Geschichten, die klingen so absurd, dass man sie Hollywood nicht einmal als B-Movie durchgehen lassen würde. Doch manchmal schreibt das Leben. Oder einfach die Technik die haarsträubendsten Drehbücher. Angela Lipps, 50 Jahre alt, fünffache Großmutter aus Tennessee, hätte sich vermutlich nie träumen lassen, dass sie eines Tages die Hauptrolle in einem Justizdrama spielen würde, das irgendwo zwischen Science-Fiction und bitterer Sozialstudie pendelt. Ihr Vergehen? Sie hatte das Pech, ein Gesicht zu besitzen, das einer Bankbetrügerin in Fargo, North Dakota, entfernt ähnelte; zumindest nach Meinung einer Gesichtserkennungssoftware und eines besonders kreativen Detectives, der „Gesichtsmerkmale, Körperbau, Frisur und Farbe“ für ausreichend hielt, um einen Haftbefehl zu beantragen.

So kam es, dass am 14. Juli 2025 schwer bewaffnete US Marshals vor ihrer Haustür standen, während sie gerade vier Enkelkinder hütete. Die Szene hätte auch aus einem schlechten Krimi stammen können: Die Großmutter, die nie in ihrem Leben in North Dakota, also am Ort des Verbrechens war, wird als gefährliche Betrügerin verhaftet und ohne weitere Nachfrage ins Gefängnis gesteckt. 108 Tage verbringt sie in Tennessee hinter Gittern, bevor sie in Handschellen in ein Flugzeug nach North Dakota gesetzt wird. Es war wohl der erste Flug in ihrem Leben. Am Ziel wartet ein weiteres Kapitel im kafkaesken Justizroman: Noch einmal Wochen in Haft, bis ein Anwalt namens Jay Greenwood auf die Idee kommt, einfach mal die Bankauszüge zu prüfen. Die zeigen: Angela Lipps war zur Tatzeit 1.200 Meilen entfernt, in Tennessee, und bestellte Pizza statt Bankkonten zu plündern.

Am Heiligabend 2025 wird sie entlassen. Keine Entschuldigung, kein Fahrgeld, kein Happy End. Ihr Zuhause, ihr Auto und sogar ihr Hund sind inzwischen weg – die Rechnungen konnte sie aus dem Gefängnis heraus nicht bezahlen. Die Polizei von Fargo? Schweigt. Der scheidende Polizeichef David Zibolski bedankt sich auf seiner Abschiedspressekonferenz artig für die Nachfrage, will aber „heute nicht darüber sprechen“. Die Rückreise nach Tennessee bezahlt ein freundlicher Anwalt aus eigener Tasche. Willkommen zurück im echten Leben.

Wer jetzt denkt, das sei ein Einzelfall, unterschätzt die Kreativität von Algorithmen und die Trägheit des Justizsystems. Gesichtserkennung gilt als Wunderwaffe der Polizeiarbeit, doch sie ist so zuverlässig wie ein Wetterbericht im April. Besonders für Menschen, die nicht dem Standardprofil der Softwareentwickler entsprechen – also für Frauen, Dunkelhäutige oder eben Großmütter aus Tennessee. Studien zeigen: Öffentliche Verteidiger in den USA jonglieren mit bis zu 19.000 Fällen pro Jahr, manchmal bleiben ihnen sieben Minuten pro Mandant. Wer Geld hat, engagiert einen Privat-Anwalt, der die KI-Treffer kritisch prüft und notfalls einen eigenen Gutachter bestellt. Wer keines hat, wartet – und verliert im Zweifel alles. „Wenn Lipps mehr Geld gehabt hätte, hätte sie vermutlich nie eine Gefängniszelle von innen gesehen. Die Armen müssen sich auf öffentliche Verteidiger verlassen“, sagt ein Experte.

Angela Lipps ist kein Einzelfall, sondern ein Symbol. Ein Symbol dafür, wie Technik, die uns angeblich schützt, zum Brandbeschleuniger sozialer Ungleichheit werden kann. Die KI erkennt alles – nur nicht, ob jemand das nötige Kleingeld für Gerechtigkeit besitzt. Die Justiz ist im Zeitalter der Algorithmen nicht blinder geworden, sondern sieht manchmal einfach nur auf den Kontostand. Wer sich einen eigenen Anwalt leisten kann, wird schneller aus dem digitalen Irrgarten befreit. Wer nicht, bleibt im System stecken – und verliert nicht nur Zeit, sondern oft auch das, was das Leben lebenswert macht.

Angela Lipps arbeitet inzwischen mit Anwälten an einer Zivilklage. Das ist die positive Seite der öffentlichen Wahrnehmung des Falls. Ob sie je eine Entschuldigung oder gar Entschädigung bekommt, steht in den Sternen. Die KI hat ihr Gesicht erkannt, aber nicht ihre Geschichte. Vielleicht ist das die eigentliche Tragik: Im Zeitalter der künstlichen Intelligenz entscheidet nicht der Algorithmus über Schuld und Unschuld, sondern das alte Spiel von Geld und Klasse. Gerechtigkeit gibt es auch heute noch – sie kommt nur unterschiedlich schnell, je nachdem, wie viel man sich leisten kann.

Und so bleibt die Frage: Wer schützt uns eigentlich vor der Technik, wenn die Technik uns nicht richtig unterscheiden kann? Vielleicht ist es an der Zeit, dass wir nicht nur die Algorithmen, sondern auch unsere Vorstellung von Gerechtigkeit neu programmieren.

Dieser Vorfall – und andere, ähnliche, nicht nur in den USA – hat mehrere Aspekte. Dazu zählt das erwähnte Missverhältnis bei der Strafverfolgung in den USA, mit dem Ergebnis, dass das Einkommen eines Verdächtigen oft mehr Einfluss auf die Chance hat, verhaftet und angeklagt zu werden, als dessen Schuld oder Unschuld. Ein anderer ist die ebenfalls erwähnte Voreingenommenheit der Gesichtserkennungs-KI, die bei manchen Menschen weniger differenziert als bei anderen. Dem Vorurteil „Die sehen doch alle gleich aus!“ erliegen nicht nur Menschen. Wobei die Täterin im konkreten Fall der verdächtigten Großmutter nicht einmal besonders ähnlich sieht – sie wirkt vielmehr deutlich jünger, so weit man das aus der Perspektive der Überwachungskamera an der Decke überhaupt beurteilen kann.

Hier gibt es aber noch ein anderes, grundsätzliches Problem, nämlich eine weit verbreitete Fehleinschätzung der Sicherheit, mit der eine Gesichtserkennung bestimmte Personen identifizieren kann. Nehmen wir an, nur mal so als Hausnummer, eine Gesichtserkennung hätte im Mittel aller untersuchten Fälle eine False-Positive-Rate von 0,1 Prozent – von 1000 Bildern, auf denen sie eine gesuchte Person zu erkennen meint, zeigt nur eines nicht die gematchte Person. Erfahrungsgemäß wird eine solche Rate höchstens im Durchschnitt erreicht; wenn es um Minderheiten geht, ist sie vielfach höher. Wenn die Strafverfolgungsbehörden diese Software nun einsetzen, um in ihrem Fotoarchiv nach Matches mit der Aufnahme einer Überwachungskamera zu suchen, sie einen Treffer liefert, wie groß ist dann die Wahrscheinlichkeit, dass die gematchte Person tatsächlich die Gesuchte ist? 99,9 Prozent, könnte man naiverweise denken, doch das stimmt nicht – und das gilt nicht nur für Angehörige ethnischer Minderheiten.

Die False-Positive-Rate ist eine bedingte Wahrscheinlichkeit: Wie groß ist die Wahrscheinlichkeit einer Fehlidentifikation, wenn ein verglichenes Bild nicht die gesuchte Person zeigt? Relevant ist aber die unbedingte Wahrscheinlichkeit, dass eine bestimmte Person (nicht) die Gesuchte ist. Wenn die Gesichtserkennungssoftware eine Datenbank mit Millionen von Vergleichsfotos durchsucht, wird sie eine Vielzahl von Matches liefern, und da ja höchstens einer der Matches die Gesuchte zeigen kann, handelt es sich bei der Mehrzahl davon um Fehlidentifikationen. Die Wahrscheinlichkeit, eine Täterin gefunden zu haben, ist also keineswegs nahe 100 Prozent; vielmehr ist das bei jedem einzelnen Match recht unwahrscheinlich, sofern man ihn nicht mit unabhängigen Indizien untermauern kann – die es im Fall aus North Dakota nicht gab.

Nun könnte man argumentieren: Was, wenn die Gesichtserkennung nicht etliche mögliche Kandidaten ausspuckt, sondern nur einen einzigen? Hieße das nicht, dass dieser Kandidat nicht nur dem Gesuchten ähnlich sieht, sondern alle anderen verglichenen Personen ihm unähnlich sind? Und wäre das kein guter Hinweis darauf, den Täter identifiziert zu haben? Theoretisch schon. Es setzt allerdings nicht nur einen zuverlässigen Gesichtsvergleich voraus, sondern auch, dass die genutzte Datenbank vollständig ist, was selten der Fall sein wird. Da von der gesuchten Person schlicht kein Foto verfügbar sein mag, bleibt die Wahrscheinlichkeit groß, dass der wahre Täter schlicht nicht erfasst worden ist.

In jedem Fall kann auch die beste verfügbare Gesichtserkennungssoftware (wobei es übrigens keine große Rolle spielt, ob diese auf einem KI-Modell oder irgendeinem anderen Verfahren basiert) allenfalls Anlass sein, sich mit der vermeintlich identifizierten Person näher zu beschäftigen. Für einen Haftbefehl reicht sie definitiv nicht aus. Im Fall aus North Dakota hätte die Polizei von Fargo also die Kollegen in Tennessee bitten müssen, zusätzliche Informationen zu sammeln – es wäre ja nicht weiter schwierig gewesen, die Großmutter nach einem Alibi zu fragen und dieses zu überprüfen. Aber manches hätte man auch schon in Fargo schnell erkennen können. Zum Beispiel, dass die Perspektive der Überwachungskamera für eine halbwegs sichere Identifizierung kaum geeignet war. Zudem erschien die Täterin, wie ich schon schrieb, deutlich jünger. Die Gesichtserkennung basierte auf dem Foto im Führerschein der Großmutter aus Tennessee, und wie es mit Führerscheinfotos so ist: Sie zeigen einen durchweg in jüngeren Jahren. Ein Abgleich des Geburtsdatums hätte das Problem sofort offenbart. Hier gab es also einen eklatanten Mangel an natürlicher Intelligenz – an common sense.