| KI generiert beeindruckende Tierfotos. Aber wie so oft macht sie ihre Arbeit mitunter zu gut, oder genauer: zu schön. Laien erkennen dann durchaus eine Kröte oder sogar konkreter eine Gelbbauchunke – doch Fachleute schütteln da oft nur mit dem Kopf, weil zahlreiche Details nicht stimmen. Die Heinz-Sielmann-Stiftung hält solche Bilder nicht nur für falsch, sondern sogar für gefährlich. Das mag ein wenig überzogen sein, aber was für den Privatgebrauch noch durchgehen mag, ist bei solchen Abweichungen bei Abbildungen in Medien durchaus problematisch. Man stelle sich vor, man ließe KI das „Foto“ eines (essbaren) Wiesenchampigons erzeugen und erhielte stattdessen eines des (giftigen) Knollenblätterpilzes. Das wäre dann in der Tat höchst gefährlich. |

© G. & R. Kistowski/Matthias Neumann

Hier die Pressemeldung der Heinz Sielmann Stiftung:

Künstlich schön – biologisch falsch: Deshalb sind KI-Bilder von Tieren so gefährlich

Kein passendes Tierfoto zur Hand? Die Verlockung ist groß, jetzt auf KI-Bilder zurückzugreifen. Doch deren Nutzung ist riskant. Sie enthalten häufig eklatante Fehler und verzerren so die Wahrnehmung von echter Natur und echten Tieren. Die Heinz Sielmann Stiftung präsentiert einige besonders frappierende Beispiele. Hätten Sie den Unterschied erkannt?

Beide Fotos sollen eine Gelbbauchunke darstellen, aber nur eines zeigt das echte Tier. Erkennen Sie das KI-generierte Bild? Die Auflösung und weitere Beispiele finden Sie unten. Fotos: G. & R. Kistowski/Matthias Neumann

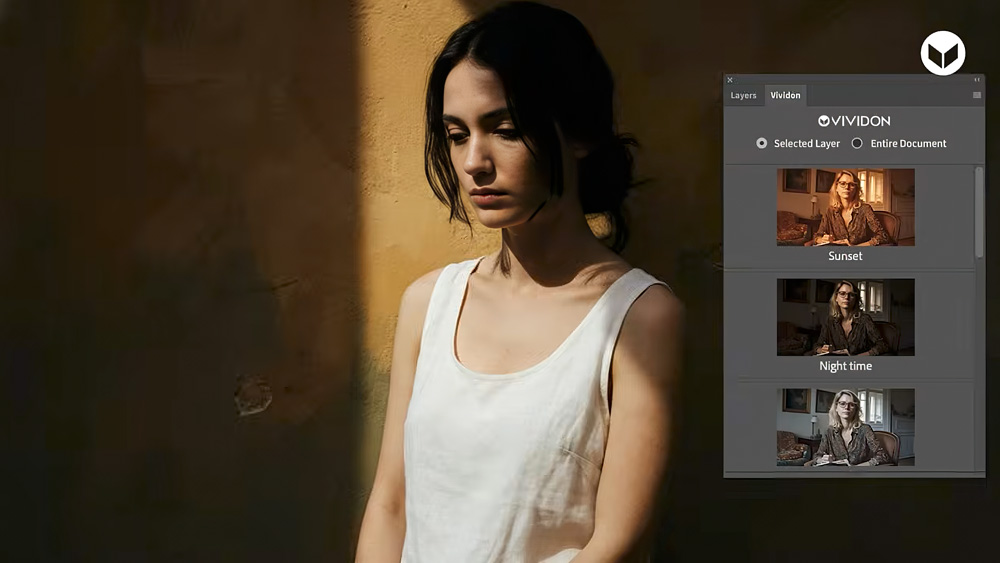

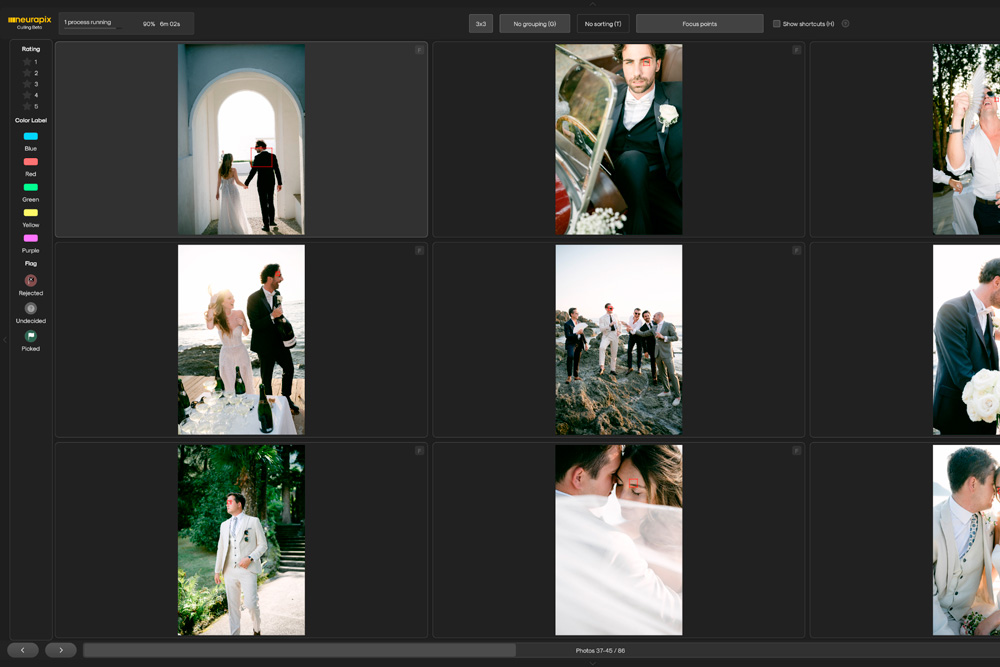

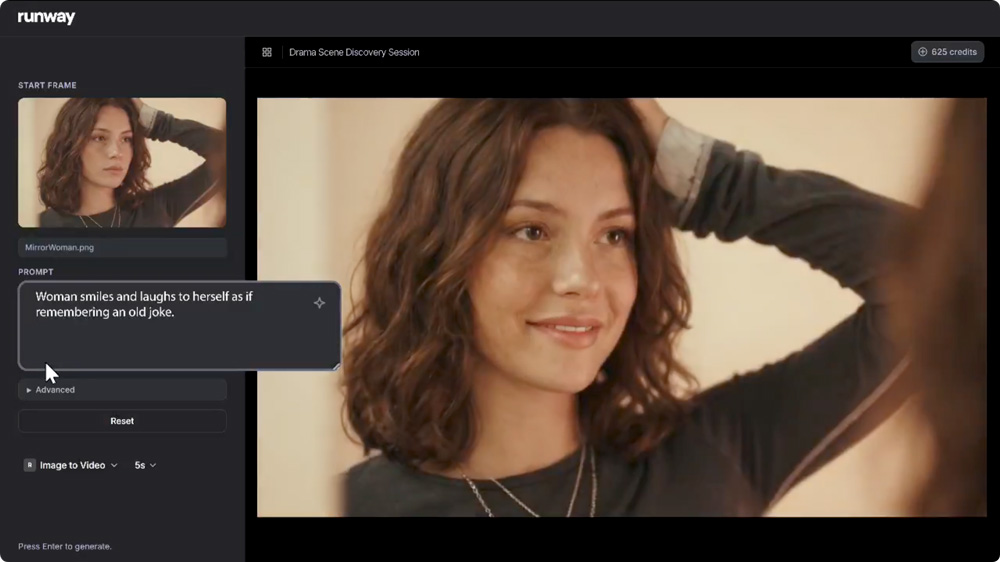

Wenn Redaktionen, Verlage oder Agenturen ausdruckstarkes Bildmaterial benötigen, kommen immer öfter KI-Tools zum Einsatz, wie etwa Midjourney, Stable Diffusion oder DALL·E, auf das auch ChatGPT zurückgreift. Künstliche Intelligenz macht es heute möglich, kostengünstig und mit wenigen Klicks ästhetisch überzeugende Bilder zu erzeugen – auch von Tieren. Doch wer darauf vertraut, dass die KI dabei realistische Naturfotos produziert, liegt schnell falsch.

Täuschend echt, aber total fake

„Viele KI-Bilder wirken täuschend echt. Tatsächlich haben diese Bilder aber mit der Realität häufig wenig gemein“, warnt Dr. Hannes Petrischak, Leiter des Geschäftsbereichs Sielmanns Naturlandschaften und Naturerlebnis bei der Heinz Sielmann Stiftung. Das Problem: Bei KI-erzeugten Tiermotiven gehen oft entscheidende arttypische Merkmale verloren. Anzahl und Stellung der Beine etwa, Färbungsmuster von Haut und Fell oder auch Körperproportionen werden von der KI verfälscht oder vermischt. Solche Fehler sind für Fachleute leicht erkennbar — für Laien aber meist nicht. Erst im direkten Vergleich werden die Mängel eindeutig.

Zur Veranschaulichung hat die Heinz Sielmann Stiftung testweise Bilder von gut identifizierbaren, heimischen Arten durch die KI „Midjourney“ generieren lassen und sie echten, professionellen Tierfotos gegenübergestellt (siehe Pressefoto-Link und Bildbeschreibungen unten). In fast allen Testfällen verfälschte die KI das Aussehen der Tiere. Gerade bei Tieren, von denen es nur wenig Bildmaterial im Internet gibt, passierten die meisten Fehler – insbesondere bei seltenen Arten oder Jungtieren.

KI neigt zu Halluzination und Schönfärberei

KI‑Modelle lernen häufig aus großen, öffentlich verfügbaren Bildbeständen. Die Testbilder zeigen, was auch unterschiedliche Forschungsstudien bereits dokumentiert haben: Wo Metadaten fehlen oder die KI-Modelle mit fehlerhaften Daten trainiert wurden, erzeugen sie regelmäßig Fehlrepräsentationen von Tierarten oder „halluzinieren“ plausible, aber erfundene anatomische Merkmale. Tendenziell neigen KI-Modelle außerdem zu idealisierten und verniedlichten Darstellungen von Tieren. Augen und Kopf werden häufig größer dargestellt, sodass die generierten Tiermotive mehr dem Kindchenschema entsprechen. Zudem sind die KI-erzeugten Wildtiere oft unnatürlich sauber.

Für den Biologen Petrischak ist klar: „Generative KI ersetzt bisher noch nicht die biologische Kenntnis von menschlichen Artenexperten. Dass beispielsweise Libellen kurze Fühler haben, weiß die KI häufig nicht. Stattdessen nimmt sie einfach die Fühler von ähnlichen Insekten mit längeren Fühlern als Maßstab. Das verzerrt unser Bild von Natur erheblich.“

KI-Bilder verbreiten Unwissen und Desinformation

Im Internet finden sich zuhauf Beispiele, die die Sorge des Biologen bestätigen. Bereits vor zwei Jahren ging das KI-generierte Foto eines vermeintlichen Pfauenkükens viral. Der dargestellte Jungvogel trägt ein blau-grün schillerndes Federkleid, wie es für erwachsene männliche Pfauen typisch ist. Tatsächlich sind Pfauenküken aber unscheinbar braun gefärbt. Erst im Erwachsenenalter entwickeln die Männchen ihre bunten Federn. Die meisten Nutzer in den Sozialen Medien hielten das niedliche KI-Küken trotzdem für echt.

Beispiele wie dieses machen deutlich: Bei unkritischer Nutzung tragen KI-Tierbilder zur allgemeinen Flut an Desinformationen bei und fördern Unwissen über die Natur und Biodiversität. Angesichts des ohnehin stark abnehmenden naturkundlichen Allgemeinwissens in der Bevölkerung und des dramatischen Artensterbens ist diese Entwicklung höchst problematisch.

Gefahr für den Natur- und Artenschutz

„Reale Bilder sind daher heute wichtiger denn je, um Menschen über biologische Zusammenhänge aufzuklären und für Naturschutz zu sensibilisieren“, sagt Petrischak: „Das Foto eines Tiers in der freien Natur hat einen großen ökologischen oder verhaltensbiologischen Wert und erzählt eine spezifische Geschichte. Es zeigt das Tier in seiner natürlichen Umgebung mit seinem typischen Verhalten. Eine KI erzeugt dagegen aus ähnlichen Bildern, oft auch von anderen Arten, höchstens Näherungen an die Realität.“

Die Heinz Sielmann Stiftung rät daher: Eine verantwortungsvolle Mediennutzung verlangt sowohl eine transparente und eindeutige Kennzeichnung von KI-Bildern als auch eine gründliche fachliche Prüfung. Besonders in Publikationen und Medienformaten, die Umweltwissen und naturwissenschaftliche Inhalte vermitteln, haben KI-erzeugte Tierfotos nichts zu suchen. Die Entscheidung, KI-Bilder zur Illustration von Natur zu nutzen, sollte grundsätzlich kritisch hinterfragt werden. Im Zweifel ist es immer ratsam, auf die Werke professioneller Naturfotografen zurückzugreifen.

© Kerstin Hinze/Matthias Neumann

© Thomas Hinsche/Matthias Neumann

© Dr. Hannes Petrischak/Matthias Neumann

© Sebastian Hennigs/Matthias Neumann

Wieder mal eine Bestätigung meiner Ansicht, daß die sog. „KI“ NUR! zum Bescheißen der Leute tauglich ist, und, wie man sieht, nicht mal das können diese Mist-Progs überzeugend.

Aber – auf der anderen Seite – wenn man die Progs eben nur mit Bildern von Kröten „trainiert“, kommen auch nur „Kröten“ dabei heraus. Die beschämende Krux bei diesen sog. „Ki’s“, daß sie über keinerlei Allgemeinwissen verfügen und nur anhand von „Tarinungsdaten“ (SELBSTVERSTÄNDLICH aus unerlaubt dazu verwendeten Werken – versteht sich von selbst!) ein Mikro-Minimal-Jota an Ausgangsmaterial zur Verfügung steht. Und aus diesem jämmerlich-erbärmlichen „Wissen“ können auch nur falsche bis jämmerlich-erbärmliche „Werke“ entstehen.

Da scheint mir doch einiges durcheinander zu gehen. Wenn jemand bescheißt, so steckt die Absicht dahinter, den derart Beschissenen zu hintergehen – meist im Interesse des Bescheißers. Nehmen wir mal an, jemand hat keine Ahnung davon, wie KI funktioniert, und erklärt nun anderen, was es mit dem Trainieren künstlicher neuronaler Netze nun so auf sich hat. Da diese Person aus bloßer Unkenntnis argumentieren würde, kann man ihr nicht vorwerfen, sie würde die Empfänger ihrer Nachrichten bescheißen wollen; sie weiß es einfach nicht besser. Im Ergebnis kann das aufs Gleiche hinauslaufen, aber es stehen unterschiedliche Absichten dahinter.

Es ist zwar richtig, dass KI (noch) nicht über so etwas wie Allgemeinwissen – eigentlich spricht man hier von „Weltwissen“ – verfügt. „Ihr“ das vorzuwerfen ist aber so ähnlich, als wollte man einem Erstklässler vorwerfen, dass er die Hebelgesetze nicht kennt und nicht weiß, was Entropie ist, obwohl er doch ständig damit zu tun hat. Sie wird es bald lernen; das Training mit Videosequenzen statt mit Einzelbildern ist ein Schritt auf diesem Weg.

Zudem erscheint es mir unangemessen, die Ergebnisse bildgenerativer KI als jämmerlich zu bezeichnen – sind sie doch um Größenordnungen besser als das, was die meisten Menschen realisieren können – viele Künstler und solche, die sich dafür halten, eingeschlossen.

Es gibt tatsächlich einiges das durcheinandergeht. Das ist jedoch die prinzipielle Vorgabe, dass AI etwas mit Intelligenz zu tun hat!

Derzeitige Fähigkeiten der so bezeichneten AI mit den Fähigkeiten eines Erstkässerls gleichzusetzen ist einfach nur falsch.

Die AI versteht nicht, absolut nichts! Sie begreift nichts. Man kann sie mit Daten füttern, Daten die von Menschen stammen, oder noch schlimmer, von AI-Systemen aus dem Datenbestand generiert wurden.

AI führt nur Befehle aus. Sie versteht nicht, was diese Befehle bedeuten oder bewirken.

Alle Menschen und nicht erst Erstklässler nehmen mit ihren Sinnen die Umwelt wahr, entwicklen Intelligenz und in ihren Gehirnen ein individuelles Bild und Verständnis der Realität, soweit sie für das Überleben und eventuel noch mehr nötig ist.

Eine AI hat derzeit keinen Antrieb, ohne Befehle irgendetwas wahrzunehmen. Jedes neugeborene Lebewesen lernt zu begreifen, AI begreift nichts! AI-Systeme sind offensichtlich in streng abgegrenzten Bereichen fähig Aufgaben, z.B. in der Medizin, zu erledigen. Doch nur unter Aufsicht von qualifizierten Menschen.

AI ist ein Marketingbegriff und hat nichts, aboulut nichts, mit Intelligenz von Organismen oder Lebewesen zu tun.

Ähh … bevor man so was behauptet, sollte man sich vielleicht doch mal umfassender informieren. Zwei empfehlenswerte Titel dazu sind etwa „Natürliche und künstliche Intelligenz. Ein kritischer Vergleich“ von dem bekannten Hirnforscher Gerhard Roth, zusammen mit Lukas Tuggener und Fabian Christoph Roth, oder von Patrick Krauss „Künstliche Intelligenz und Hirnforschung. Neuronale Netze, Deep Learning und die Zukunft der Kognition“, beide im Wissenschaftsverlag Springer erschienen (ganz abgesehen von meinem eigenen Buch „KI-Bilder. Künstlich oder auch künstlerisch?)

Wittgenstein schreibt, die Bedeutung eines Begriffs sei sein Gebrauch. Natürlich ist KI (noch) nicht in dem Sinne intelligent, wie es Menschen sind (die es wiederum auf andere Weise sind als Tiere). Aber sie löst effektiv Probleme aller Art, und das ist ein relevanter Aspekt, wenn auch nicht alles. Ein Flugzeug fliegt nicht wie ein Vogel – aber es fliegt.

„Natürlich ist KI (noch) nicht in dem Sinne intelligent, wie es Menschen sind (die es wiederum auf andere Weise sind als Tiere).“

Auch bei Mensch und Tier ist die Trennlinie der „Intelligenz“ bei weitem nicht so scharf, wie es viele einfach annehmen.

Und aktuelle KI-Systeme sind auch keine rein „stochastischen Papageien“ mehr.

Geoffrey Hinton weist ja darauf hin, dass es typische Fehlleistungen von KI-Modellen ebenso beim Menschen gibt, weil die Unterschiede eben doch nicht so groß sind. Zum Beispiel was das Halluzinieren/Konfabulieren angeht: „“People always confabulate,” he says. Half-truths and misremembered details are hallmarks of human conversation: “Confabulation is a signature of human memory. These models are doing something just like people.”“ (https://www.technologyreview.com/2023/05/02/1072528/geoffrey-hinton-google-why-scared-ai/) Mir geht er damit ein bisschen zu weit, denn ich sehe da noch einen qualitativen Unterschied, aber es stimmt schon: Die naive Vorstellung, wir hätten die Repräsentationen von Ideen im Kopf, die unser Verständnis von irgendetwas widerspiegeln, und würden diese dann nur noch in Worte fassen (während LLMs einfach nur nach statistischen Verfahren Texte fortsetzen), entspricht nicht der Realität. Manchmal weiß ich erst, was ich denke, wenn ich höre, was ich sage.

Die wundersame Brennweitenverlängerung von Objektiven bei APS-C-Kameras gegenüber 24x36mm-Kameras beweist, dass nur viele über lange Zeit eine Behauptung aufstellen müssen, die von noch mehr Leuten geglaubt und an noch mehr Leute weitergegeben werden, um daraus eine scheinbare Wahrheit zu manifestieren. So falsch sie in jeder Hinsicht ist. Wenn sie, sagen wir mal 90% der Hersteller und „Fachjournalisten“ verwenden wird sie nicht wahr oder richtig. Doch Bestandteil des Schwarmwissens. Oder eben das, was ein Schwarm als „Wissen“ empfindet. Es wird eben dieser „Brennweitenverlängerungs-Schwarm“ eben von keinen Raubfischen aus dem Verkehr gezogen, so können sie ihr geglaubtes „Fachwissen“ nächsten Generationen weitergeben.

Glauben ist eben viel bequemer als Wissen erwerben.

Da AI-Systeme von Menschen entwickelt werden, sind menschliche Grenzen integraler Bestandteil deren sogenannter „Intelligenz“. Und das nur von einem sehr kleinen Teil der Menschen, die auf die theoretische und praktische Entwicklung dieser Systeme spezialisiert sind und diese umsetzen, also kein repräsentativer Teil der Menschheit. Volkstümlich nennt man solche Spezialisten „Fachidioten“.

Die gezeigten AI-generierten Tierbilder weisen darauf hin, dass nicht wenige Tierzeichnungen aus vorwiegend amerikanischen Comics und Animationsfilmen der letzten knapp 100 Jahre zum Trainig verwendet wurden, das lassen z.B. vergrößerte Augen und ähnliche Merkmale vermuten. Dass eine AI beim Trainig zwischen Realität und Übertreibung nicht unterscheiden kann und ziemlich sicher nicht die Qualität eines Bildes vom kommerziellen Erfolg eines Produkts unterscheiden kann ist mangels vorhandener Fähigkeit der Erkenntnis augenscheinlich.

Dass Tiere weniger intelligent als Menschen sind gehört zum Weltbild vieler. Mir diese Einstellung zu unterstellen kann aus meinen Kommentaren nicht abgeleitet werden.

Wie beschrieben: Je enger das Aufgabengebiet eingegrenzt, desto besser die möglichen Ergebnisse. Doch unbeaufsichtigt darf man solche Systeme nicht lassen. Und mangels Erkenntnis und Wissen sind sie dumm. So dumm, wie eine Autofahrerin oder ein Autofahrer die ohne auf die Beschaffenheit der Straße mit einem Sattelschlepper den Angaben eines Navis folgt und über einen Feldweg in einem Teich landet.

Nachdem hier von einer „wundersame(n) Brennweitenverlängerung von Objektiven“ die Rede war, scheint das Konzept der kleinbildäquivalenten Brennweite noch immer nicht von jedem verstanden zu sein. Dabei ist das gar nicht so schwer, und in einem Beitrag von vor zwei Jahren hatte ich es ausführlich erklärt: https://www.docma.info/blog/ewig-missverstanden-die-kleinbildaequivalente-brennweite