Ein Richterspruch aus Kalifornien, der vordergründig von Büchern handelt, wirft auch ein Schlaglicht auf die Werkstätten der Bildzauberer. Es ist eine jener Entscheidungen, die wie ein leises Beben eine ganze Industrie erschüttern und deren Nachhall noch lange zu spüren sein wird. Im Fall gegen das KI-Unternehmen Anthropic wurde eine feine, aber entscheidende Linie gezogen, die auch für das Schicksal digitaler Bilder von größter Bedeutung ist: die zwischen dem rechtmäßigen Lernen und dem schlichten Diebstahl. Für alle, die sich mit Fotografie, digitaler Bildgestaltung und dem Urheberrecht in Zeiten der KI befassen, ist dieses Urteil ein wegweisendes Signal, das Hoffnung und Mahnung zugleich ist.

Die Herkunft als Schicksal

Richter William Alsup vom US District Court für Nordkalifornien vollführte einen juristischen Spagat, der die Branche aufhorchen lässt. Er gestand der künstlichen Intelligenz zu, was wir jedem Studenten zubilligen: aus legal erworbenen Quellen zu lernen, um etwas Neues, Eigenes hervorzubringen. Diese Nutzung sei „transformativ“, so die Begründung, und falle damit unter die Fair-Use-Doktrin des US-Rechts. Die KI, so das Urteil, ahmt nicht einfach nach, sie analysiert Muster, um eine neue Sprache zu sprechen oder, wie es in Umberto Ecos „Der Name der Rose“ heißt, um aus alten Zeichen neue zu deuten.

Doch dieser Freispruch gilt nur für die saubere Weste. Sobald die KI mit Piraterie gefüttert wird, mit unrechtmäßig kopierten Werken aus den dunklen Ecken des Netzes, verkehrt sich die Tugend ins Gegenteil. Dann, so der Richter unmissverständlich, wird aus dem Schüler ein Komplize und aus dem Archiv eine Hehlerwarensammlung. Gleichwohl ist die Sache für Anthropic nicht ausgestanden; ein separates Verfahren über die Höhe des Schadenersatzes für die nachweislich illegal genutzten Quellen steht noch aus und könnte Forderungen in Milliardenhöhe nach sich ziehen. Die eigentliche Schlacht beginnt also erst.

Die neuen Spielregeln für Bildgeneratoren

Was bedeutet das für uns, die wir in Pixeln denken und in Kompositionen fühlen? Es ist eine fundamentale Verschiebung der Debatte. Die großen Klagen, die derzeit gegen Bildgeneratoren wie Midjourney oder Stability AI laufen, bekommen durch dieses Urteil eine neue Schärfe. Die entscheidende Frage wird nicht mehr nur sein, ob eine KI mit urheberrechtlich geschützten Bildern trainiert wurde, sondern wie sie an diese Bilder gelangte. Die Herkunft der Daten rückt ins Zentrum der juristischen Auseinandersetzung.

Hat das Unternehmen Lizenzen erworben, wie es Adobe für seine Firefly-Modelle mit Inhalten aus dem eigenen Stock-Portfolio und gemeinfreien Werken tut? Oder hat es, wie ein digitaler Lumpensammler, das Netz leer gefegt und dabei Millionen von Bildern ohne Erlaubnis eingesackt? Oder hat es die im Netz vorhandenen Bilder im akademischen Sinn zitiert, ohne sie zu speichern? Das Anthropic-Urteil legt nahe, dass Gerichte diesen Unterschied sehr genau nehmen werden. Die Beweislast verschiebt sich. Es reicht nicht mehr, pauschal die Nutzung von Bildern anzuprangern; Kläger müssen künftig möglicherweise den illegalen Ursprung der Daten nachweisen.

Zwischen Hoffnung und harter Realität

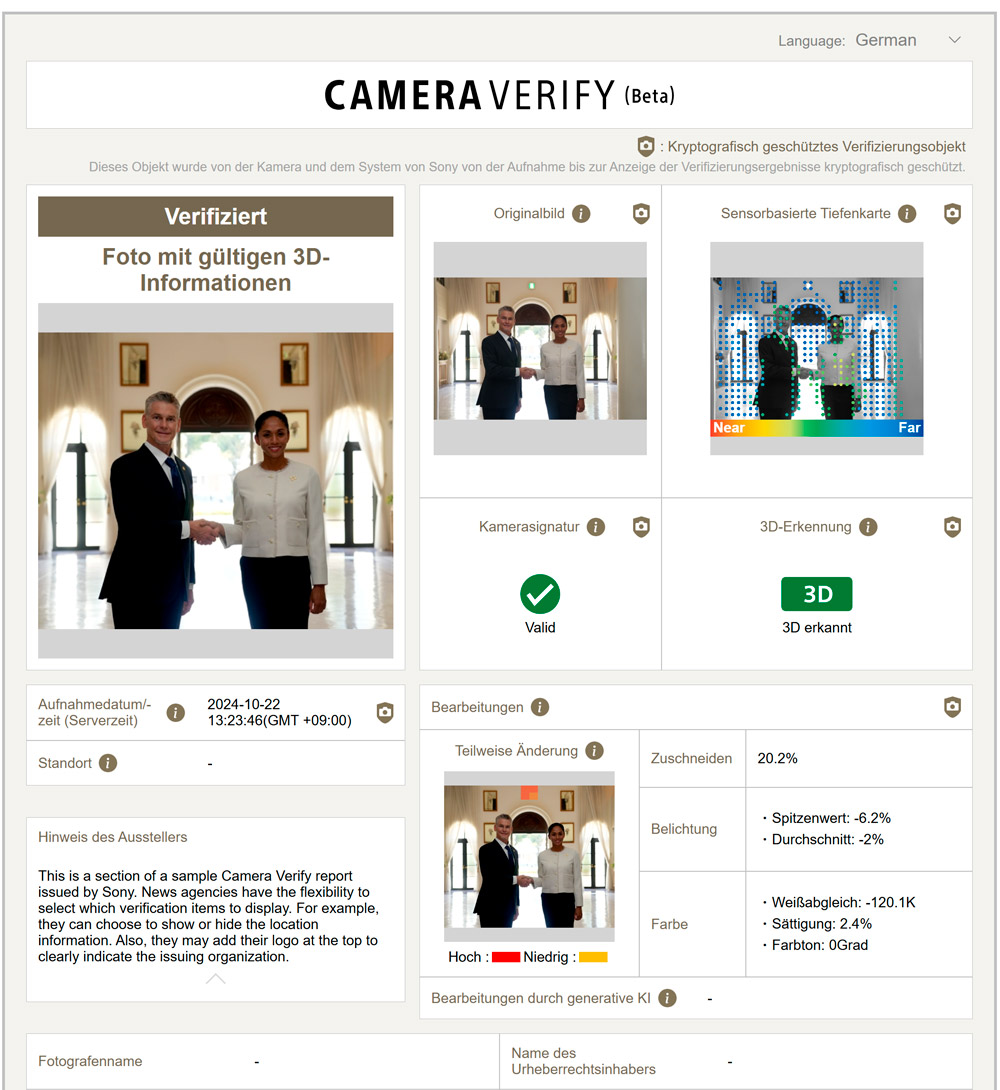

Diese Entwicklung erklärt die zunehmende Nervosität im Feld der KI-Entwickler und die plötzliche Betonung von Transparenz. Initiativen wie die Content Credentials (C2PA) oder Opt-out-Register wie „Do Not Train“ von Spawning sollen signalisieren, dass man die Rechte der Urheber ernst nimmt. Doch die Realität ist ernüchternd. Diese Mechanismen beruhen größtenteils auf Freiwilligkeit und werden oft ignoriert. Aktuelle Analysen zeigen, dass nur etwa ein Viertel der großen Websites den Crawler von OpenAI aktiv blockiert.

Hinzu kommen technische Hürden: Metadaten, die einen Urheber ausweisen, können bei der Verarbeitung entfernt werden, und einmal in einem Trainingsdatensatz erfasste Bilder lassen sich kaum wieder entfernen. Die Hoffnung auf eine einfache technische Lösung für ein komplexes rechtliches und ethisches Problem erweist sich als trügerisch. Die Zeit des rechtlichen Vakuums, des digitalen Wilden Westens, neigt sich dennoch ihrem Ende zu.

Für uns Kreative bedeutet dieses KI-Urteil: Der Wert unserer Bilder wird nicht durch KI annulliert, sondern auf eine neue Probe gestellt. Die rechtliche Anerkennung, dass die Herkunft der Daten zählt, stärkt unsere Position fundamental. Es zeichnet sich ein Weg ab, der wegführt von der massenhaften, unentgeltlichen Enteignung und hin zu einem System, in dem Zustimmung und Lizenzierung eine zentrale Rolle spielen. Die Magie der KI wird nicht verschwinden, aber sie wird gezwungen, ihre Quellen offenzulegen. Und das ist vielleicht die beste Nachricht seit Langem.