Updates für Creative Cloud Anwendungen bringen mehr KI-Unterstützung

Adobe stattet die Creative Cloud Anwendungen mit neuen und verbesserten KI-Funktionen aus. Dazu zählen unter anderem ein dialoggestützter, auf Agentic KI basierender KI-Assistent für Photoshop, das neue Firefly Image Model 5 (Beta), die Modelle Topaz Bloom und Topaz Gigapixel in Photoshop für Generative Upscale sowie Topaz Bloom in Adobe Firefly.

KI-Assistenten und Modelle

Adobe integriert in Programme wie Photoshop und Adobe Express neue dialoggestützte KI-Assistenten. Diese basieren auf sogenannten agentenbasierten Systemen (agentic AI): Nutzer formulieren in eigenen Worten, was sie erzielen möchten – etwa „Ich möchte die Belichtung etwas heller und den Hintergrund stärker weichzeichnen“ – und erhalten Empfehlungen, gleichzeitig bleibt der manuelle Feinschliff möglich.

Darüber hinaus bietet Adobe Zugriff auf vielfältige KI-Modelle. Dazu gehört das eigene Adobe Firefly Image Model 5 (öffentliche Beta) mit nativer 4-Megapixel-Auflösung. Zudem integriert Adobe Partner-Modelle von Unternehmen wie Google bzw. OpenAI. Neu sind außerdem die Firefly Custom Models (private Beta) in der Firefly-App: Anwender ziehen eigene Bild- oder Skizzen-Referenzen, für die sie die Nutzungsrechte haben, ein und trainieren damit ein Modell im persönlichen Stil. So können sie ganze Serien von Assets mit visueller Konsistenz in ihrem eigenen Stil generieren.

das Firefly Image Model 5 vereint Bildgenerierung und -bearbeitung und unterstützt das neue Tool Prompt to Edit von Firefly, mit dem Anwender in normaler Sprache beschreiben können, was sie von der KI wollen. Außerdem ermöglicht das neue Modell die Bildbearbeitung über mehrere Ebenen (in der Vorschau) für exakte, kontextsensitive Kompositionen.

Erweiterte Funktionen in Kreativ-Apps

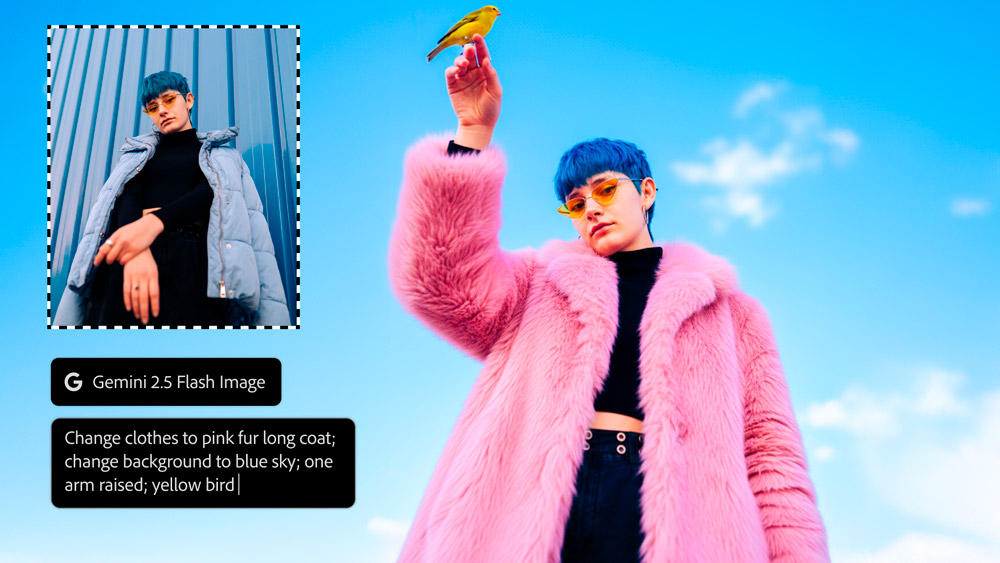

Generatives Füllen mit Partnermodellen in Photoshop

Adobe erweitert die Funktion „Generatives Füllen“ um Modelle externer Partner wie Google Gemini 2.5 Flash Image und Black Forest Labs FLUX.1 Kontext, ergänzt durch Fireflys eigene Bildmodelle. Diese Kombination verbessert die Präzision bei anweisungsbasierten Bildänderungen. Anwender können mit kurzen Texteingaben Elemente hinzufügen, entfernen oder verändern, ohne dass dabei der Gesamteindruck des Motivs verloren geht. Das System achtet darauf, dass Perspektive, Licht und Farbe stimmig bleiben – etwa wenn in einer Landschaft neue Objekte eingefügt oder störende Details entfernt werden.

Generative Upscale in Photoshop

Mit „Generative Upscale“ führt Adobe ein Werkzeug ein, das die KI-Technologie von Topaz Labs nutzt, um Bilder sofort in höherer Auflösung darzustellen. Das Verfahren rechnet kleine oder beschnittene Motive auf 4K-Qualität hoch, ohne sichtbare Artefakte zu erzeugen. Besonders nützlich ist das für Inhalte, die ursprünglich aus Modellen mit begrenzter Auflösung stammen – etwa KI-generierte Produktaufnahmen oder stark beschnittene Fotos. Die Funktion bewahrt feine Texturen und erzeugt eine Schärfe, die an echte High-End-Aufnahmen erinnert.

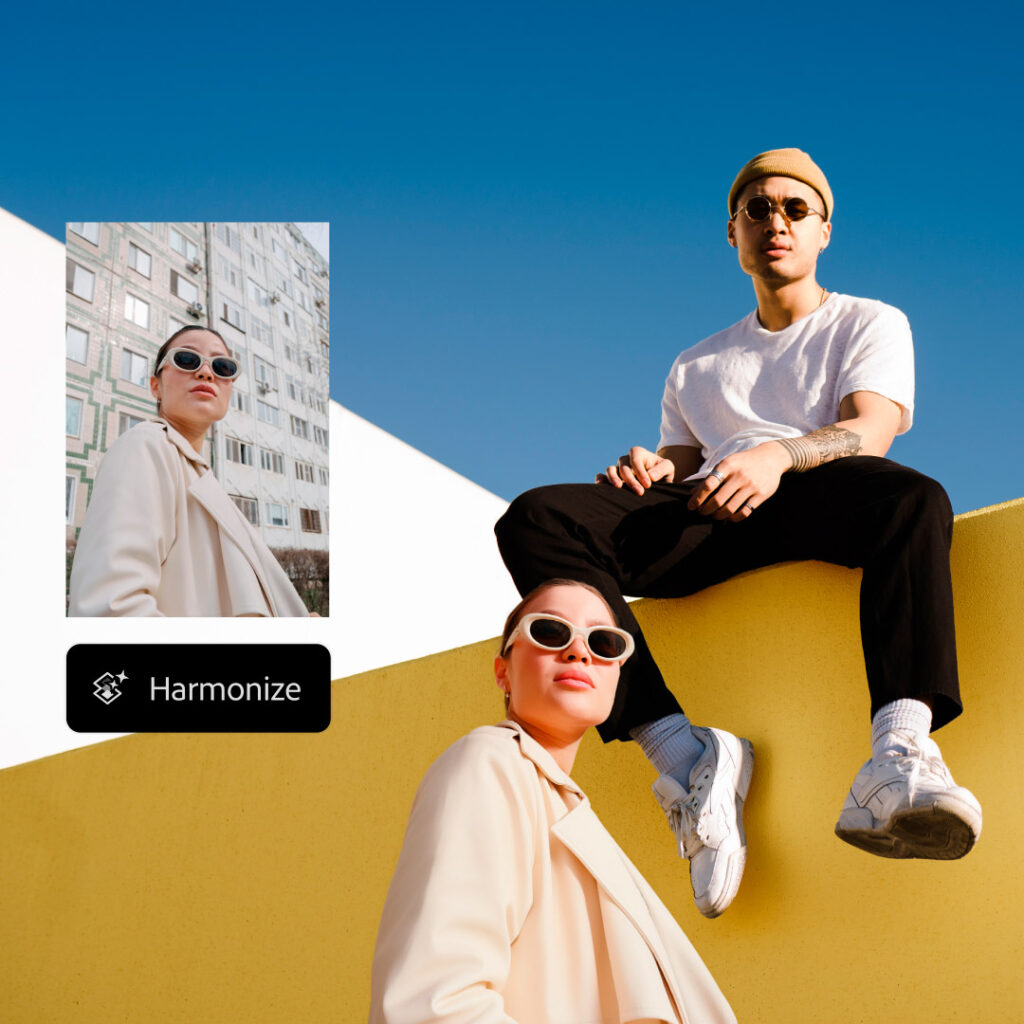

Harmonize in Photoshop

Das Werkzeug „Harmonize“ automatisiert weite Teile des Compositings. Es soll Lichtstimmung, Farbe und Tonwerte von Objekten oder Personen so angleichen, dass sie sich nahtlos in eine neue Umgebung einfügen. Wer etwa ein Porträt in eine andere Szenerie montiert, erhält im Idealfall ein realistisches Ergebnis, ohne jede Ebene manuell anpassen zu müssen. Die KI analysiert den Hintergrund und passt das eingefügte Motiv an – von der Farbtemperatur bis zum Schattenverlauf.

AI Object Mask in Premiere Pro (Beta)

In der Videosoftware Premiere Pro identifiziert die Funktion „AI Object Mask“ automatisch Personen und Objekte innerhalb einzelner Frames. Sie isoliert die erkannten Elemente, sodass gezielte Farbkorrekturen, Unschärfen oder visuelle Effekte ohne aufwendiges manuelles Rotoskopieren möglich sind. Mit Object Mask lassen sich Farbkorrekturen, Unschärfeeffekte und Spezialeffekte schneller und einfacher auf bewegte Hintergründe anwenden.

Rechteck-, Ellipsen- und Stiftmaskierung in Premiere Pro (Beta)

Neue Maskierungswerkzeuge erweitern die Möglichkeiten der selektiven Videobearbeitung. Mit geometrischen Masken wie Rechteck und Ellipse lassen sich bestimmte Bildbereiche exakt isolieren. Der klassische Stift erlaubt freihändige oder vektorbasierte Masken für komplexe Formen. Diese Werkzeuge erleichtern präzise Korrekturen – etwa, um nur den Himmel zu entsättigen oder ein Gesicht gezielt aufzuhellen.

Fast Vector Mask in Premiere Pro (Beta)

Das überarbeitete „Fast Vector Mask“-System beschleunigt das Tracking deutlich. Es unterstützt bidirektionales Tracking und kann Bewegungen auch in 3D-Perspektive nachverfolgen. Damit lassen sich Masken schneller an Kamerafahrten und sich drehende Objekte anpassen. Videoprofis können so dynamische Szenen mit realistischen Effekten versehen, ohne Frame für Frame nachzuarbeiten.

Assisted Culling in Lightroom (Beta)

In Lightroom beschleunigt das Werkzeug „Assisted Culling“ die Bildauswahl bei großen Serien. Die KI bewertet Aufnahmen nach Schärfe, Blickrichtung und Fokusstufen und filtert automatisch die technisch besten Ergebnisse heraus. Fotografen sollen damit Hunderte ähnlicher Motive – etwa aus einem Porträt- oder Hochzeits-Shooting – in kürzester Zeit sichten können. Das System zeigt Varianten nebeneinander und hebt jene hervor, die den festgelegten Kriterien am besten entsprechen.

Produktions- und Workflow-Optimierung

Adobe erweitert das Modul Firefly um sogenannte Batch-Bearbeitungsfunktionen: In der Vorschauversion „Firefly Creative Production“ lassen sich Tausende von Bildern gleichzeitig verändern – etwa Hintergründe ersetzen, Farblooks durchziehen, Zuschneiden vereinheitlichen.

Für Unternehmen steht mit GenStudio eine Lösung bereit, die den gesamten Prozess von Planung über Produktion bis Ausspielung abdecken soll: Inhalte strategisch planen, generativ erzeugen, verwalten und messen. Partner-Integrationen mit Plattformen wie TikTok oder LinkedIn sollen Kampagnen auf mehreren Kanälen unterstützen.

Zudem wurde mit Firefly Foundry angekündigt, dass Marken gemeinsam mit Adobe eigene Modelle trainieren können – auf Basis eigener Daten – um Inhalte in markenkonformer Qualität und skalierbar zu erzeugen.

Mehr zu den Neuerungen können Sie hier erfahren.

Es ist Wahnsinn, wie schnell sich Adobe nach Jahren des gefühlten Stillstands bewegt. Das finde ich gut und viele Features sind auch wirklich sinnvoll und hilfreich.

Was mir leider seit gefühlt 15 Jahren immer noch fehlt, ist ein Background-Blur für transparente Objekte in InDesign. Ich kann mir nicht vorstellen, dass ich der Einzige bin, der so etwas einsetzt.