200 Megapixel – wer bietet mehr?

Samsungs neuer, für Smartphones gedachter Sensor ISCOCELL HPX löst sagenhafte 200 Megapixel auf, womit sich wieder einmal die Frage stellt, ob so viele Pixel noch einen Sinn haben.

Da der Sensor ja in ein Smartphone-Kameramodul passen soll, musste das Pixelraster auf 0,56 Mikrometer schrumpfen, und damit sind die Pixel bereits kleiner als die Wellenlänge roten Lichts. Natürlich geht das Licht dennoch hinein, aber die unvermeidliche Beugung macht sich hier empfindlich bemerkbar und begrenzt die effektiv erreichbare Auflösung. Geht man von einer kleinbildäquivalenten Brennweite von 28 Millimeter und einem diagonalen Bildwinkel von 75 Grad aus, wäre eine Öffnung von 7,2 Millimetern nötig, wenn die Beugungsscheibchen nicht größer als ein Sensorpixel werden sollen. So große Objektive passen allerdings in kein handelsübliches Smartphone.

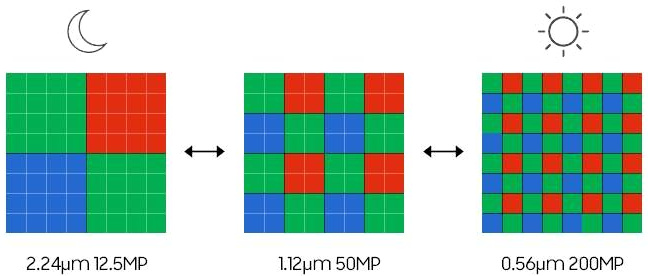

Die 200 Millionen Pixel dürften auch eher als Trumpf beim Kameraquartett als in der fotografischen Praxis taugen. Bei weniger als idealen Lichtverhältnissen sollen jeweils vier oder 16 Sensorpixel zu einem virtuellen Superpixel verrechnet werden, womit der Rauschabstand und der Dynamikumfang steigen, die Auflösung aber auf 50 beziehungsweise 12,5 Megapixel sinkt – also auf das Niveau, das die bislang üblichen Kameramodule für Smartphones auch bieten.

Zur Vereinfachung der Pixelverrechnung hat Samsung das schon länger bekannte Quad-Bayer-Farbfiltermuster zu einem 16-fach-Bayer-Muster erweitert – jeweils vier mal vier benachbarte Sensorpixel haben dasselbe Farbfilter. Will man allerdings 50 oder die vollen 200 Megapixel nutzen, wird es kompliziert. In einem Re-Bayer-Verfahren müssen zunächst neue, virtuelle Pixel im klassischen Bayer-Muster berechnet werden, was bereits eine Interpolation erfordert. Gängige Interpolationsverfahren sind aber nicht geeignet, zu 16 Pixeln mit nur je einer Grundfarbe die fehlenden zwei Drittel der RGB-Werte zu ergänzen – jedenfalls nicht so, dass man am Ende eine echte 200-Megapixel-Auflösung erhielte. Allenfalls Verfahren der Künstlichen Intelligenz wären dazu in der Lage, müssten die fehlenden Details allerdings passend erfinden, und wozu hat man so viele Sensorpixel, wenn die hohe Bildauflösung am Ende doch von der KI kommt?

Wegen dieser Schwierigkeiten kann Samsungs 200-MP-Sensor auch nicht für sich in Anspruch nehmen, das optische Bild wenigstens besonders fein abzutasten, wie es sonst für extrem hochauflösende Sensoren gilt, die durch Oversampling sehr saubere, artefaktarme Bilder erzeugen. Der ISOCELL HPX eignet sich zum Angeben; für die Fotografie bietet er aber kaum praktische Vorteile.

Vielen Dank für diese Denkanregung.

Die Fotografie hat hat viele Sensorformate und Pixelgrößen. Wie sieht es denn mit der theoretischen Nützlichkeit dieser Technik bei größeren Pixeln bis hin zu Mittelformat aus? Die sind heute im Messbildsektor mit Bayern Patter ja schon bei 150 MB und in Kamerakombination fast beim doppelten, aber mit bisherigen Sony Sensoren und könnten mit dieser Technik einen weiteren Sprung und erhebliche Kostenreduktion im Luftbildsektor erreichen

Prodrejo