Wer hätte gedacht, dass ausgerechnet eine Banane zum Symbol für den nächsten Paradigmenwechsel in der Bildbearbeitung avanciert? Es sind diese Momente, in denen man als professioneller Bildgestalter innehält, den Wacom-Stift zur Seite legt und realisiert, dass sich der Boden unter der digitalen Dunkelkammer wieder einmal verschiebt. Zwischen Cupertino und Mountain View, zwischen Apfel und Banane, entspinnt sich ein neues Kapitel der maschinellen Kreativität. Und wir stehen mittendrin, mit jahrzehntelanger Expertise im Farbmanagement und einer gesunden Portion Skepsis gegenüber allem, was nach einer einfachen Lösung riecht.

Die Ankündigung, dass ausgerechnet Apple, der Gralshüter geschlossener Ökosysteme, Verfechter von Privatsphäre und im Rennen um die Pfründen der Generativen KI nicht gerade weit vorne, Trainingsdaten für Googles KI-Bildbearbeitung „Nano Banana“ bereitstellt, ist mehr als nur eine kuriose Randnotiz. Es ist möglicherweise ein strategischer Schachzug, der das Fundament dessen, was wir unter Bildbearbeitung verstehen, nachhaltig verändern könnte.

Der Kern der Sache: Datenfutter und ein lernfähiges Modell

Um die Tragweite zu verstehen, müssen wir zwei Komponenten als Einheit betrachten: den Datensatz und das Modell. Apple liefert mit „Pico-Banana-400K“ das Futter. Dabei handelt es sich nicht um eine beliebige Ansammlung von Bildern, sondern um einen hochkuratierten Datensatz aus rund 400.000 Bild-Triplets. Jedes Triplet besteht aus einem Originalbild, einer Bearbeitungsanweisung in natürlicher Sprache („Mach den Himmel dramatischer und entferne den Vogel rechts“) und dem von Googles KI-Modell „Nano Banana“ bearbeiteten Ergebnis.

Der Clou liegt in der Qualitätskontrolle: Eine weitere KI, Googles Gemini-2.5-Pro, bewertete die Resultate. Nur die überzeugendsten Bearbeitungen, die sowohl plausibel als auch ästhetisch ansprechend waren, schafften es in den finalen Datensatz. Dieser Prozess etabliert möglicherweise einen völlig neuen Maßstab, eine Art TÜV für KI-gestützte Bildmanipulation, an dem sich künftige Modelle messen lassen müssen.

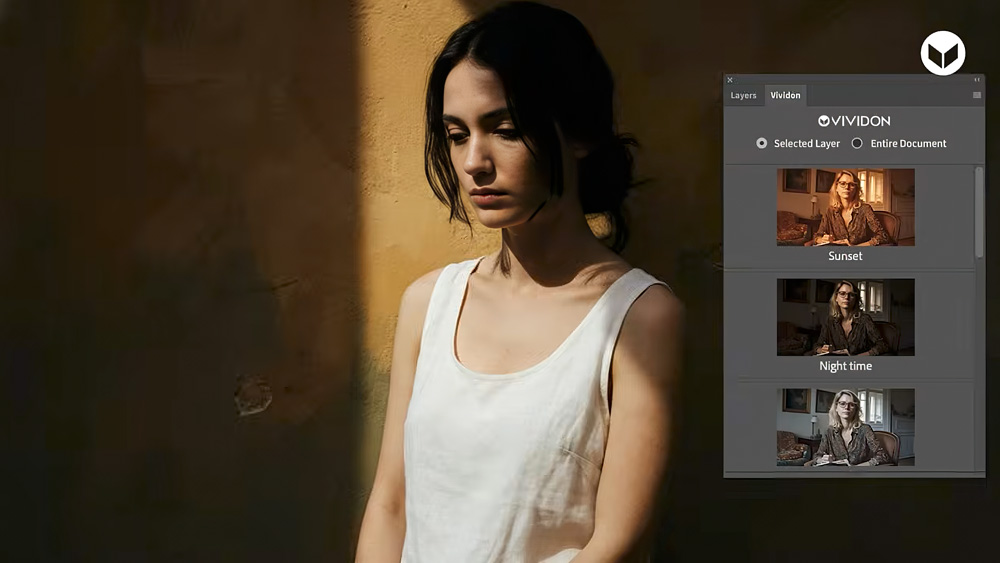

Googles „Nano Banana“ ist dabei der Motor, der auf der MGIE-Technologie (MLLM-Guided Image Editing) aufbaut. Dieses Modell ist weit mehr als ein simpler Filter. Es interpretiert komplexe, umgangssprachliche Anweisungen, führt globale wie lokale Anpassungen durch, entfernt oder ergänzt Objekte und kann sogar Photoshop-ähnliche Aktionen wie das Anpassen von Helligkeit und Kontrast oder das Verändern des Hintergrunds ausführen. Die eigentliche Neuerung ist jedoch seine Fähigkeit zur Kontextualisierung: Die KI merkt sich vorangegangene Bearbeitungsschritte und kann so eine ganze Kette von Anweisungen konsistent abarbeiten. Aus dem statischen Werkzeug wird ein dialogfähiger Assistent.

Photoshops Achillesferse: Amateurwerkzeug oder ernste Gefahr?

Die naheliegende Frage ist, ob diese Entwicklung eine ernsthafte Bedrohung für den Branchenprimus Adobe darstellt oder ob es sich lediglich um ein weiteres Werkzeug für Amateure handelt, die ihre Fotos „aufhübschen“ möchten. Die Antwort ist vielschichtig und für Adobe potenziell beunruhigend. Zunächst einmal zielen Apples Werkzeuge nicht nur auf simple Korrekturen. Die Fähigkeit, komplexe Anweisungen zu verstehen und umzusetzen, geht weit über das hinaus, was integrierte Fotobearbeitungswerkzeuge üblicherweise leisten. Der entscheidende Punkt ist jedoch das Timing. Apples Vorstoß trifft Adobe an einer empfindlichen Stelle: der Qualität der eigenen KI-Funktionen. Mit der Umstellung auf Firefly Version 3 in Photoshop 2025 klagten viele Anwender über eine spürbare Verschlechterung der Ergebnisse bei Funktionen wie „Generatives Füllen“ und dem „Entfernen-Werkzeug“. Wo frühere Versionen überzeugende Retuschen lieferten, generiert die aktuelle Software oft unbrauchbare Füllungen, unpassende Objekte oder künstlich wirkende Texturen. Ein Adobe Senior Product Manager räumte zwar Probleme ein, verwies aber auf die Unberechenbarkeit generativer Modelle und empfahl Nutzern, bei Bedarf auf die ältere Photoshop-Version 2024 zurückzugreifen – ein Offenbarungseid für jeden Softwareentwickler.

Genau in diese Wunde stößt nun Apple. Ein direkter Vergleich der KI-Retusche-Ergebnisse von Photoshop 2025 und Apples neuem „AI Photo Clean Up“ durch das Magazin Petapixel fiel für Adobe beschämend aus. Selbst DOCMA-Autor Olaf Giermann, der den reißerischen Artikel zunächst widerlegen wollte, musste nach eigenen Tests die Überlegenheit der Apple-Lösung bei vielen Retusche-Aufgaben eingestehen. Apple liefert in einem Bereich, den Adobe als zentrales Zukunftsfeld definiert hat, auf Anhieb oft die besseren, weil glaubwürdigeren Ergebnisse. Dies erinnert an frühere Momente, in denen Adobe auf Apple-Plattformen strauchelte, etwa bei der Einführung einer stark kritisierten, rudimentären Photoshop-Version für das iPad.

Eine neue Art der Bildbearbeitung: Vom Handwerker zum Regisseur

Es geht hier nicht darum, ob Apples KI morgen komplexe Compositing-Aufgaben oder die präzise Druckvorstufen-Abstimmung ersetzen kann. Das wird sie nicht. Aber sie leitet eine neue Art der Bildbearbeitung ein, die den Fokus verschiebt. Die technische Hürde zur Erzielung eines professionellen Ergebnisses wird niedriger, der Zugang zur Bildmanipulation demokratisiert sich weiter.

Für die professionelle Praxis bedeutet dies eine fundamentale Verschiebung der eigenen Rolle. Wo wir bisher Stunden in die Perfektionierung von Ebenenmasken, Frequenztrennung und Luminanzkanälen investierten, könnte künftig ein präzise formulierter Satz genügen. Der Kreative wandelt sich vom Handwerker, der sein Werkzeug virtuos beherrscht, zum Regisseur oder Kurator, der eine KI anleitet, Visionen umzusetzen. Die entscheidende Fähigkeit liegt dann nicht mehr allein in der technischen Ausführung, sondern in der Präzision der Anweisung und der kritischen Bewertung des maschinell generierten Ergebnisses.

Diese Entwicklung ist unumkehrbar. Die Bananen-Offensive von Apple und Google ist mehr als ein Angriff auf Adobes Marktanteil; sie ist ein Angriff auf die traditionelle Vorstellung von Bildbearbeitung als rein manuellem Prozess. Sie zwingt uns, unsere Definition von Kreativität, Originalität und Autorschaft zu hinterfragen. Die Werkzeuge werden mächtiger, aber ihre Funktionsweise zunehmend zu einer Blackbox. Statt über Pixel und Kurven zu diskutieren, werden wir über Ethik, Bias in Datensätzen und die Grenzen der maschinellen Interpretation debattieren müssen. Die Banane ist geschält – und ihr Inneres ist komplexer und folgenreicher, als es die simple Frucht vermuten lässt. Es ist an uns, zu entscheiden, ob wir sie als schnellen Snack oder als Zutat für ein völlig neues Rezept betrachten.