Kaum kommt man mit Leuten zusammen, sei es offline oder online, da zückt auch schon jemand sein Smartphone und bindet einem auf die Nase, was irgendein KI-Chatbot zum aktuellen Thema gesagt hat. Aber wer will das wissen?

Unsichtbare Freunde leisten nicht nur kleinen Kindern Gesellschaft, sie sind auch Erwachsenen nicht fremd. Sie sind das Gegenteil des sprichwörtlichen Elefanten im Raum: Dessen Existenz ist offensichtlich, nur vermeiden es alle, über ihn zu reden. Unsichtbare Freunde sind für alle anderen nicht existent, die aber zur Vermeidung einer peinlichen Situation so tun müssen, als sei der Freund real.

Menschen mit übersteigertem religiösen Sendungsbewusstsein beispielsweise weisen einen gerne ungefragt darauf hin, was ihr höchstes Wesen von diesem oder jenem hält, auch wenn das keinen interessiert. Frisch Verliebte reden über nichts lieber als das, was der oder die unbekannte Geliebte gesagt oder getan hat; das ermüdet ebenfalls, aber immerhin kann man darauf bauen, dass sich der Gegenstand der Schwärmerei über kurz oder lang entweder in Fleisch und Blut materialisieren wird oder das Verliebtsein von alleine schwindet.

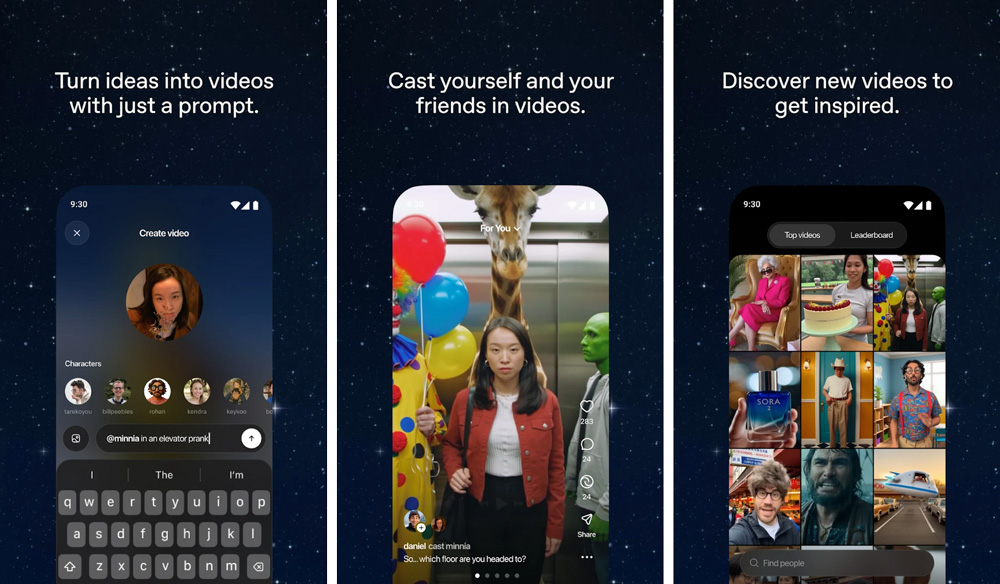

Der neueste unsichtbare Freund ist ChatGPT, Claude, Grok oder einer der anderen KI-Chatbots, die nie um eine Antwort verlegen sind, was immer auch die Frage ist. Und irgendetwas treibt die KI-Nutzer dazu, die Antworten herumzuerzählen. Als könnten andere die KI nicht selbst fragen … Aber angeblich weiß so eine KI sogar, warum Menschen ihre Chatverläufe mit anderen teilen:

Tatsächlich ist so etwas weitgehend nutzlos. Wer wirklich wissen will, was eine KI zu einem Thema sagt, fragt sie selbst (abgesehen davon, dass einem KI-Antworten von Google, Facebook und anderen Diensten geradezu aufgedrängt werden), und man trifft sich ja nicht mit anderen, damit sie sich dann von einer KI soufflieren lassen.

Auch in Onlineforen kann man keine Frage stellen, ohne dass jemand, der selbst keine Antwort kennt, mit Cut&Paste aus dem Chatverlauf einen „eigenen“ Beitrag generiert. Dabei muss man doch gar nicht zu allem etwas sagen, wenn man mal gar nichts zu sagen hat. Sicherer wäre es allemal, darauf zu verzichten, denn der KI kann man nicht unbegrenzt vertrauen.

Mit KI-Zitaten kann man sich leicht zum Deppen machen, falls die KI mal wieder halluziniert hat. Wenn man nach einer bestimmten Kameraeinstellung fragt, kann es durchaus sein, dass es den empfohlenen Menübefehl beim betreffenden Modell gar nicht gibt, und ein generierter Programmcode greift vielleicht auf ein Feature zurück, das die genutzte Programmiersprache nicht unterstützt. Das fällt dann durchaus zu Recht auf den Überbringer der Botschaft zurück, denn der hätte ja erst einmal prüfen können, ob die KI auch richtig liegt. Wer sich die Überprüfung nicht selbst zutraut, lässt es besser ganz, sich auf diesen schlüpfrigen Weg zu begeben.

Vor Jahren hatten manche – durchaus mit Bedauern – festgestellt, dass man sich über irgendwelche Sachfragen gar nicht mehr streiten könne, seit man nur noch die jederzeit auf dem Smartphone verfügbare Wikipedia konsultieren müsse, um die mit Belegen unterfütterte definitive Antwort zu bekommen – Problem gelöst, Thema tot. Aber so ein Wikipedia-Artikel hielt ja oft noch andere interessante Fakten bereit, womit man ein neues Gesprächsthema hatte. Die Antworten einer KI dagegen sind opak und wie die Sprüche eines antiken Orakels nicht hinterfragbar. In gut einem Drittel der Fälle sind sie falsch, aber um mögliche Fehler zu finden, müsste man sich dann doch ernsthaft selbst mit der Frage auseinandersetzen – die KI nach Belegen zu fragen kann dazu führen, dass sie aus dem Stand welche erfindet.

Es ist auch nicht so, als ob man die KI irgendwie in die Gesprächsrunde aufnehmen könnte. Sie ist ja keine Person und hat keine Persönlichkeit, sondern passt sich geschmeidig jedem an, der fragt. Man erfährt nicht wirklich, welche Position sie zu irgendeiner Frage einnimmt, denn das ist nicht immer dieselbe und sie hängt auch davon ab, wie man fragt. Eine KI hat keine Haltung und vertritt keinen Standpunkt, es sei denn, der Hersteller hätte sie mit hidden prompts auf seine Linie eingeschworen, wie es Elon Musk mit Grok versucht – womit der Wert der Antworten allerdings kompromittiert wäre.

Nichts spricht dagegen, eine KI zu konsultieren, wenn man nicht weiter weiß, aber Dritte sollte man damit erst behelligen, nachdem man die Antwort der KI verifiziert hat. Und nur wer sich diese Mühe macht, ist am Ende wirklich schlauer.