Gespenster der Vergangenheit – Wenn KI die Geschichtsschreibung neu ordnet

„Wer die Vergangenheit kontrolliert, kontrolliert die Zukunft.“ Das dachte sich wohl nicht nur George Orwell, sondern auch jene Algorithmen, die heute mit unheimlicher Präzision längst verstorbene Gesichter aus dem digitalen Grab holen.

Sie kennen diese Momente. Man blättert durch alte Familienalben, zeigt auf vergilbte Gesichter und fragt: „Wer ist das nochmal?“ Ratlose Blicke, Achselzucken, vielleicht ein „Könnte Onkel Heinrich sein … oder war es Otto?“ Die Identität verblasst wie die Farben der alten Kodak-Abzüge. Der natürliche Lauf der Dinge – zumindest bis vor kurzem. Denn während wir früher die namenlosen Ahnen respektvoll in ihren papierenen Gräbern ruhen ließen, schreitet heute die künstliche Intelligenz mit Fackeln durch die Katakomben der Geschichte. Sie leuchtet in dunkle Eckel, vergleicht Nasenformen, Augenabstände, Ohrläppchen. Und plötzlich haben die Gespenster wieder Namen.

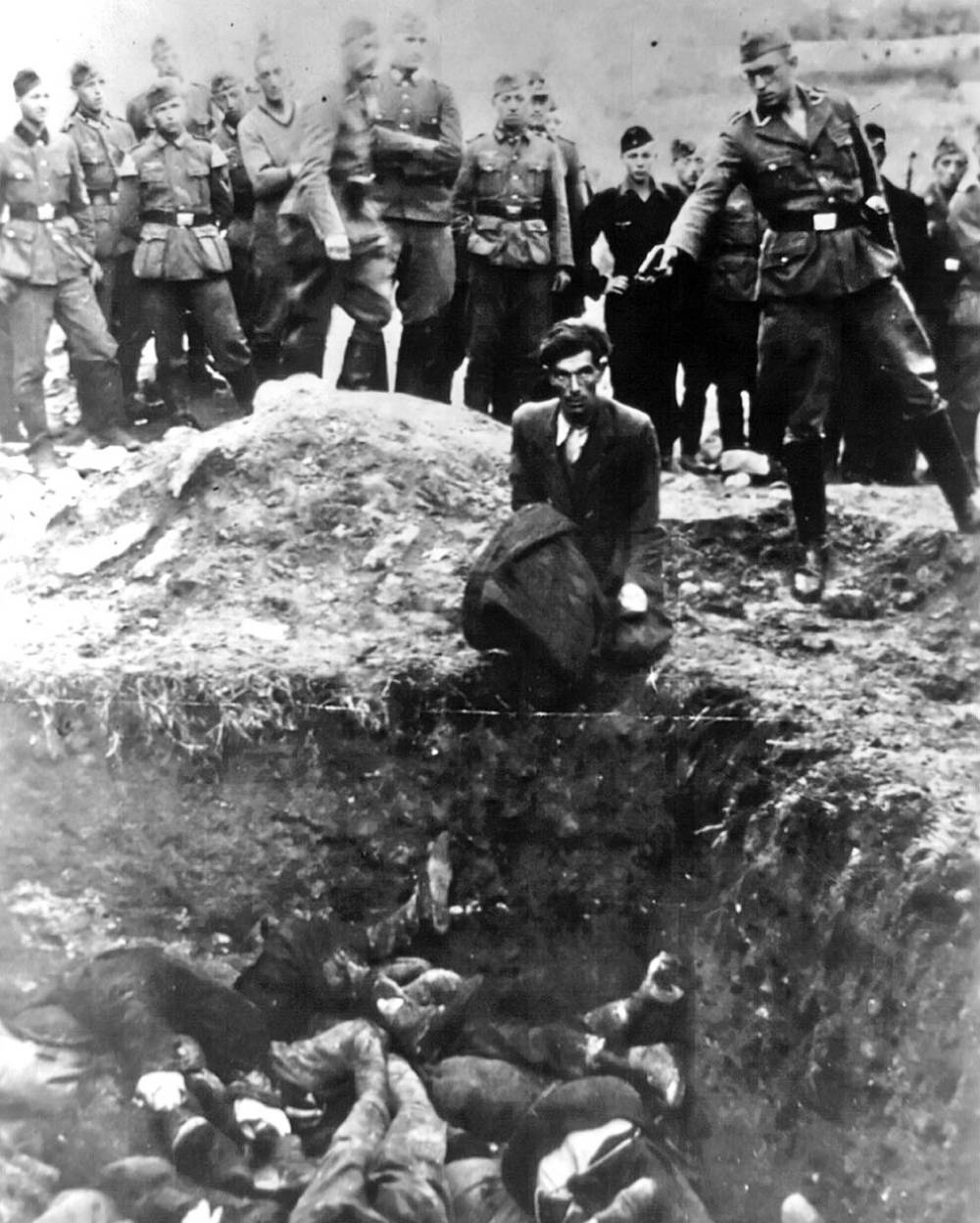

So geschehen in der jüngsten digitalen Geisterbeschwörung: Ein deutscher Historiker hat mithilfe von KI-basierter Gesichtserkennung einen Nazi-Soldaten auf einem der berüchtigtsten Holocaust-Bilder identifiziert – jenem, das als „Der letzte Jude von Vinnitsa“ bekannt wurde. Jahrzehntelang blieb der Täter mit der Pistole in der Hand ein Gesicht ohne Namen. Nun wissen wir: Es handelte sich wohl um Jakobus Onnen, einen ehemaligen Lehrer und frühen NSDAP-Mitglied. Die KI verglich Familienfotos mit dem historischen Bild und fand mit „ungewöhnlich hoher“ Wahrscheinlichkeit eine Übereinstimmung.

Ein Triumph der Technik? Sicher. Ein Sieg für die historische Aufarbeitung? Vielleicht. Eine ethische Gratwanderung? Auf jeden Fall. Die namenlose Masse der Geschichte bekommt plötzlich Gesichter. Gesichter bekommen Namen. Namen bekommen Geschichten. Der digitale Algorithmus ordnet das kollektive Gedächtnis neu – ohne Rücksicht auf Vergessen oder Vergeben.

Man stelle sich vor, was passieren würde, wenn wir diese Technologie flächendeckend auf alle historischen Bildbestände anwenden würden. Die KI kennt keine Scham, keine Diskretion. Sie identifiziert mit gleicher Kälte den Henker wie das Opfer, den heimlichen Liebhaber auf dem Ballfoto wie den verkleideten Widerstandskämpfer. Die Geschichte würde neu geschrieben – Pixel für Pixel, Gesicht für Gesicht.

Die Technologie wirft verstörende Fragen auf: Haben wir ein Recht auf die Identifizierung von Personen, die längst nicht mehr leben können? Dürfen wir mit mathematischen Modellen historische Wahrheiten definieren? Und was passiert, wenn die Algorithmen irren?

Denn irren tun sie natürlich. Das haben zahlreiche Fälle von KI-Fehlidentifikationen bewiesen. Robert Williams verbrachte 18 Stunden in Haft, weil eine Gesichtserkennungssoftware ihn fälschlicherweise als Ladendieb identifizierte. Randal Reid saß sogar sechs Tage im Gefängnis aufgrund einer falschen KI-Zuordnung. Beide Männer hatten etwas gemeinsam: ihre dunkle Hautfarbe. Die KI, trainiert auf Datensätzen mit überwiegend hellen Gesichtern, versagte bei ihnen besonders häufig.

Was bedeutet das für die historische Forschung? Werden die Algorithmen auch dort bestimmte Bevölkerungsgruppen systematisch falsch identifizieren? Oder anders gefragt: Wird die Geschichte mancher Menschen korrekter sein als die anderer?

Die „Civil War Photo Sleuth”-Plattform hat bereits über 60.000 Fotos aus dem amerikanischen Bürgerkrieg katalogisiert und zahlreiche anonyme Soldaten identifiziert. Eine beeindruckende Leistung – aber wie viele dieser Identifikationen sind falsch positiv? Wie viele Soldaten bekommen nun eine Biografie, die nie ihre war?

Dabei ist die Technik an sich weder gut noch böse. Sie ist wie ein Hammer – man kann damit ein Haus bauen oder einen Schädel einschlagen. Die ethische Verantwortung liegt bei uns. Wir müssen entscheiden, welche Gesichter wir aus dem Dunkel der Geschichte holen wollen und welche vielleicht besser dort bleiben sollten.

Die Ironie liegt darin, dass wir heute mit modernster Technik versuchen, genau das rückgängig zu machen, was die Nazis einst taten: die Auslöschung von Identitäten. Wir wollen Namen zurückgeben, Geschichten erzählen, Gerechtigkeit schaffen. Aber während wir die Täter identifizieren, bleiben die Opfer oft namenlos. Der jüdische Mann im Bild aus Berdychiv hat zwar auf dem Bild ein Gesicht, aber keinen Namen und keine Geschichte. Die KI kennt ihn nicht.

Es gibt etwas Unheimliches an dieser asymmetrischen Erinnerung. Als würde die Geschichte selbst die Machtverhältnisse der Vergangenheit reproduzieren. Die Täter bekommen ihre Identität zurück, die Opfer bleiben anonym. Doch nicht nur in historischen Kontexten wirft die KI-gestützte Gesichtserkennung Fragen auf. Wenn wir heute in der Lage sind, Menschen auf 80 Jahre alten, körnigen Schwarzweißfotos zu identifizieren – was bedeutet das für die Privatsphäre in unserer durchdigitalisierten Gegenwart? Jedes Urlaubsfoto auf Instagram, jeder Hintergrund in TikTok-Videos, jede Straßenszene in Google Maps könnte eines Tages von Algorithmen durchforstet werden.

Die Grenzen zwischen öffentlich und privat verschwimmen, wenn jedes digitale Abbild zu einem biometrischen Datenpunkt wird. Die Geschichte hört nie auf – sie wird nur immer wieder neu indiziert, neu verknüpft, neu erzählt und – vor allem – neu bewertet.

Und während die KI uns neue Einblicke in die Vergangenheit gewährt, verändert sie gleichzeitig unsere Zukunft. Denn je mehr wir glauben, die Geschichte mit mathematischer Präzision rekonstruieren zu können, desto stärker wird unser Glaube an die Unfehlbarkeit der Maschinen. Wir delegieren unser kollektives Gedächtnis an Algorithmen, die nicht verstehen, was Erinnerung bedeutet.

Der wahre Wert der Geschichte liegt nicht in der pedantischen Identifikation jedes Gesichts auf jedem Foto. Er liegt in den Lehren, die wir ziehen, in den Mustern, die wir erkennen, in der Menschlichkeit, die wir bewahren. Die KI kann uns helfen, verlorene Puzzleteile zu finden, aber sie kann nicht das Bild für uns zusammensetzen.

Die dunkle Hautfarbe trifft leider noch heute auf unglaubliche Probleme. Nach dem Toilettengang geht man zum Handwaschbecken und nimmt Seife und wäschst sich die Hände. Da es auch seit langer Zeit (2017) die automatischen Seifenspender gibt, misst der Sensor ob sich eine Hand darunter befindet. Video zeigt eindeutig wie diese Software programmiert wurde. Link: https://x.com/nke_ise/status/897756900753891328?utm_source=chatgpt.com