Wo bleibt die Superintelligenz?

Manche erhoffen sich von der künstlichen Intelligenz die Lösung aller unserer Probleme, während andere fürchten, eine künstliche Superintelligenz würde sich der Menschheit entledigen – oder uns zumindest auf den Gnadenhof schicken. Aber geniale Entdeckungen oder Erfindungen der KI lassen schon seit Jahren auf sich warten – Ansätze zum Aufstand der Maschinen ebenfalls.

Heutige KI-Systeme auf der Basis künstlicher neuronaler Netze sind so leistungsfähig, weil sie mit Myriaden von Fallbeispielen trainiert worden sind. Bevor das maschinelle Lernen überhaupt beginnen konnte, mussten die Entwickler möglichst viele Aufgaben und Lösungen aus dem Bereich zusammenstellen, in dem die KI am Ende glänzen soll.

Es liegt auf der Hand, dass solche KI-Systeme zwar die Leistungen vieler und oft sogar der meisten Menschen übertreffen werden, aber nicht das Leistungsniveau aller Menschen, einschließlich der Besten in ihrer jeweiligen Disziplin. Dabei können wir schon lange Maschinen bauen, die um Größenordnungen schneller und stärker als der Mensch sind, die extrem hohen wie auch extrem niedrigen Temperaturen standhalten und im Vakuum des Weltraums ebenso wie in der Tiefsee arbeiten können – es ist für uns keineswegs ungewöhnlich, von Maschinen weit in den Schatten gestellt zu werden. Aber das scheint bislang nicht für unsere Problemlösungskompetenz zu gelten. Beispielsweise kann ein KI-System für die medizinische Diagnostik die Leistung der besten Diagnostiker erreichen und sie an deren schlechteren Tagen auch mal übertreffen, aber es bleibt auf das beschränkt, was schon einmal von irgendjemandem diagnostiziert worden ist.

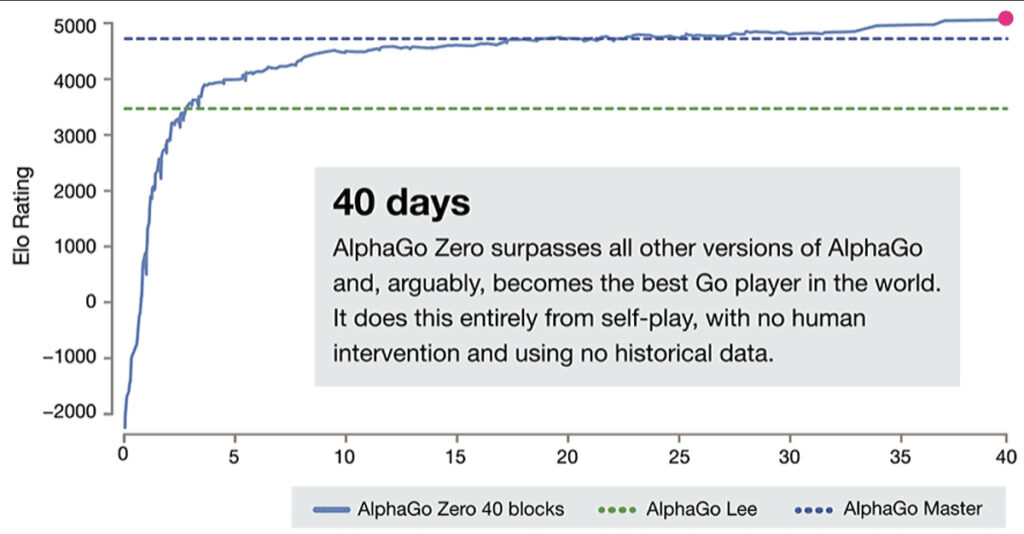

2017 schien es manchen so, als sei diese Beschränkung aufgehoben worden. DeepMind, ein von Google/Alphabet aufgekauftes Start-up, hatte AlphaGo Zero vorgestellt, ein KI-System, das das Brettspiel Go besser als jeder Go-Meister spielte. Dabei hatte die KI keine Go-Partien analysiert, und sie wusste auch nichts von dem, was die besten Go-Spieler über Strategie und Taktik geschrieben hatten. AlphaGo Zero verfügte zu Beginn seiner Trainingsphase über nichts als die bloßen Spielregeln, wusste also nur, welche Züge jeweils zulässig waren und wann eine Partie entschieden war (und für wen). Sein Spiel war daher zunächst dilettantisch und seine Züge wirkten willkürlich. Daraufhin ließ DeepMind die KI immer wieder gegen sich selbst spielen und aus den Ergebnissen lernen. Nur drei Tage später triumphierte AlphaGo Zero über seinen Vorgänger AlphaGo Lee, der seinerseits schon einen der weltbesten Go-Spieler (Lee Sedol) gedemütigt hatte. Nach 40 Tagen war AlphaGo Zero besser als jeder menschliche Spieler und schien dann ein Plateau zu erreichen – viel besser ging’s offenbar nicht.

Hatte DeepMind also einen Weg gefunden, KI-Systeme unabhängig vom menschlichen Vorbild lernen und auf diese Weise weit über menschliche Fähigkeiten hinauswachsen zu lassen? Beim Entwickler schien man davon überzeugt zu sein:

“The most striking thing is we don’t need any human data anymore,” says Demis Hassabis, CEO and cofounder of DeepMind. Hassabis says the techniques used to build AlphaGo Zero are powerful enough to be applied in real-world situations where it’s necessary to explore a vast landscape of possibilities, including drug discovery and materials science.

https://www.technologyreview.com/2017/10/18/148511/alphago-zero-shows-machines-can-become-superhuman-without-any-help/

Doch ganz so war es nicht. Spiele wie Go oder auch das weniger komplexe Schach haben die Besonderheit, dass es ein klares Erfolgskriterium gibt: Ein Spieler ist um so erfolgreicher, je mehr Spiele er gewinnt, und wann ein Spiel gewonnen oder verloren ist (oder mit einem Patt oder Remis endet, was beim Schach möglich ist, bei Go jedoch nicht), ist eindeutig definiert und schnell feststellbar. Nur deshalb war es möglich, AlphaGo Zero allein aus Spielen gegen sich selbst lernen zu lassen.

Für die medizinische Diagnostik gilt das nicht. Ob eine Diagnose auf Basis von Untersuchungsergebnissen korrekt ist, zeigt sich erst, wenn sich die Erkrankung des Patienten so entwickelt, wie es die Diagnose vorausgesagt hat, wenn eine daraufhin gewählte spezifische Therapie anschlägt oder ein späterer Test sie bestätigt. Doch darauf zu warten würde das Lernverfahren so weit verlangsamen, dass die KI erst nach vielen Jahren ausgelernt hätte. Die Entwickler bleiben daher vorerst auf den Fundus bestätigter Diagnosen angewiesen, die von menschlichen Ärzten gefunden worden sind. Ähnliches gilt für die anderen denkbaren Anwendungen, in denen ein KI-System Probleme in der realen Welt lösen soll, etwa in den von Demis Hassabis genannten Bereichen der Wirkstoffentwicklung und der Materialwissenschaft. Chancen für ein hinreichend schnelles Lernverfahren gibt es nur, wenn man nicht auf Ergebnisse in der Realität warten muss, sondern auf eine Computersimulation zurückgreifen kann. Damit bleibt man aber auf die Aspekte der Wirklichkeit beschränkt, die man bereits gut versteht und daher simulieren kann.

Dabei ist die Aufgabe, beispielsweise anhand eines Röntgenbildes eine Diagnose zu treffen, bereits stark vereinfacht. Den größten Teil der Arbeit haben schon andere erledigt, und man muss nur noch aus einer Liste möglicher Diagnosen die jeweils richtige finden. Aber was für Diagnosen kommen hier überhaupt in Betracht? Bevor man wusste, dass es Bakterien gibt und dass bestimmte Bakterien bestimmte Krankheiten verursachen, konnte man keine bakteriellen Infektionen diagnostizieren und keine gezielten Antibiotika-Therapien vorschlagen. Entsprechendes gilt für Viren als Krankheitserreger. Eine wahrhaft geniale Superintelligenz müsste in der Lage sein, nicht nur in einem Multiple-Choice-Test das Kreuz an der richtigen Stelle zu machen, sondern uns noch völlig unbekannte Alternativen aufzuzeigen. Mit einer von einer KI entwickelten, grundlegend neuen Krebstherapie ist daher nicht so bald zu rechnen (mit einer Unterstützung der Forschung durch die KI hingegen schon).

Das heißt nun nicht, dass KI-Systeme keine Umwälzung innerhalb ihres Aufgabenbereichs bringen könnten. Eine Diagnostik-KI mag nicht fundamental besser als die besten menschlichen Diagnostiker arbeiten, aber sie ist nie unpässlich, abgelenkt, schlecht gelaunt oder aus anderen Gründen unkonzentriert. Vor allem mag man vom weltbesten Diagnostiker zwar mindestens so gut behandelt werden wie von einer KI, die aus seinen Diagnosen gelernt hat – aber die allermeisten Menschen begegnen nie dem weltbesten Diagnostiker für ihr besonderes Leiden, sondern müssen sich zwangsläufig an den nächstbesten Arzt halten, bei dem sie zeitnah einen Termin bekommen. Ein KI-System dagegen lässt sich nach seinem Training beliebig vervielfältigen und überall auf recht erschwinglichen Computern installieren. So könnte prinzipiell jeder Patient die aktuell bestmögliche Diagnose bekommen.

In der Praxis ist es natürlich nicht so einfach. Die Kosten der KI-Entwicklung sollen schließlich wieder eingespielt werden, und nicht überall auf der Welt werden sich die Menschen eine Diagnostik-KI leisten können. Und selbst wenn sie ihre Diagnose bekommen, wird die nötige Behandlung vielfach nicht verfügbar oder zu kostspielig sein – so wie wirksame AIDS-Medikamente für HIV-Infizierte in vielen Staaten Afrikas. Aber zumindest das Potential für eine Demokratisierung der Spitzenmedizin besteht – dank der KI. Dieses Potential zu realisieren wäre ein aussichtsreicherer Ansatz als der Versuch, eine Superintelligenz zu entwickeln.