Was wird aus „out of camera“?

Die einen Fotografen bevorzugen einen Raw-Workflow, die anderen schwören weiter auf die JPEGs, wie sie die Kamera speichert. Diese OOC-Bilder (kurz für „out of camera“) sehen im Wettbewerb mit Smartphones einerseits und KI-gestützten Raw-Konvertern andererseits jedoch zunehmend alt aus.

Am Anfang, also unmittelbar nach der Aufnahme, stehen immer die Rohdaten des Sensors. Aus diesen Daten muss ein anschaubares RGB-Bild „entwickelt“ werden, wie man es in Anlehnung an die analoge Fotografie nennt, entweder in der Kamera, die das entwickelte Bild Sekundenbruchteile später als JPEG speichert, oder in einem Raw-Konverter auf dem Computer. In einem Raw-Workflow, womit eine Raw-Konvertierung mit dem Computer gemeint ist, passiert nichts grundlegend anderes als in der Kamera; der Unterschied besteht vor allem darin, dass ein Raw-Konverter umfangreiche Möglichkeiten bietet, diesen Prozess zu steuern und für jedes Bild die jeweils optimalen Parameter zu wählen, und das höhere Maß an Kontrolle ermöglicht bessere Resultate.

Trotzdem ist ein Raw-Workflow nicht jedermanns Sache. Manchen Fotografen erscheint die Raw-Konvertierung unter manueller Kontrolle als zu kompliziert, obwohl das für moderne Software kaum noch gilt – wenn man ein Bild nach der Aufnahme ohnehin noch optimiert, geht das mit einem Raw-Konverter ebenso einfach und intuitiv wie mit einem Bildbearbeitungsprogramm für JPEG-Dateien.

Es gibt auch die Einstellung, eine Beschränkung auf OOC-Bilder führe zu einer irgendwie reineren, ehrlicheren Fotografie, weil man schon bei der Belichtung alles richtig machen müsse und nicht noch im Nachhinein „mogeln“ könne. Das Äquivalent in der analogen Fotografie war allerdings, seine belichteten Filme auf Gedeih und Verderb einem Großlabor anzuvertrauen, was damals eher so verstanden wurde, dass es einem nicht so sehr auf die Ergebnisse ankam.

Wieder andere Fotografen entscheiden sich ganz bewusst für OOC-JPEGs, weil sie ihnen einfach am besten gefallen. Jeder Kamerahersteller hat ja seine eigenen Vorstellungen, welche Farb- und Tonwertwiedergabe optimal wäre, und wer auf die Bilder seiner Canon-, Nikon- oder Fuji-Kamera schwört, wird mit den Bildern aus anderen Kameramodellen fremdeln. Das gilt, obwohl aktuelle Kameras durchweg die Wahl zwischen verschiedenen Bildstilen lassen, denn es gibt beispielsweise keinen Canon-Modus für Fuji-Kameras – oder umgekehrt.

Obwohl die Bildverarbeitung in der Kamera also ihre Fans hat, ist ihre Zukunft ungewiss – aus zwei Gründen. Zum einen ist da die Konkurrenz der Smartphones, deren Kameramodule heutzutage zwar auch oft eine Raw-Option bieten, ihre besten Ergebnisse aber OOC liefern – mit Methoden, wie man sie in klassischen Kameras noch nicht findet. Dazu gehört die Kombination von Bilddaten mehrerer Kameramodule – auch mit unterschiedlichen Brennweiten – und Depth-Maps, die mit einem Time-of-Flight-Sensoren erzeugt werden, dazu die Verrechnung mehrerer Belichtungen in schneller Folge. Auf diesem Wege lassen sich mit Handy-Kameras Ergebnisse erzielen, wie man sie von den Kompaktkameras früherer Jahre (deren Sensoren ähnlich klein waren) nicht kannte. Aber auch Systemkameras sehen im Vergleich alt aus – dank ihrer größeren Sensoren sind sie zwar noch im Vorteil, wie sich bei einem näherem Blick auf die Bilder zeigt, aber ihre im Vergleich zu „richtigen“ Kameras überlegene Bildverarbeitung macht vieles wett.

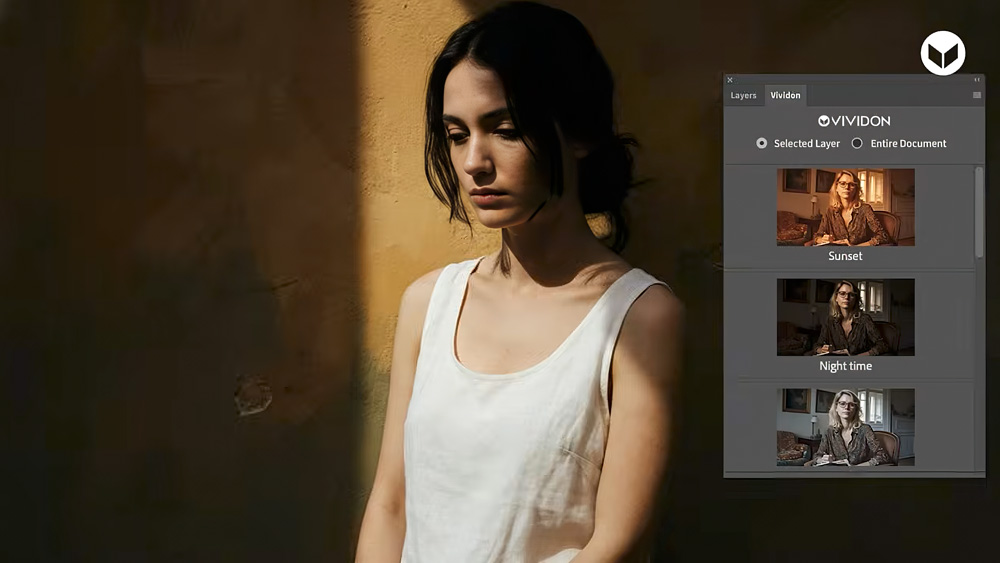

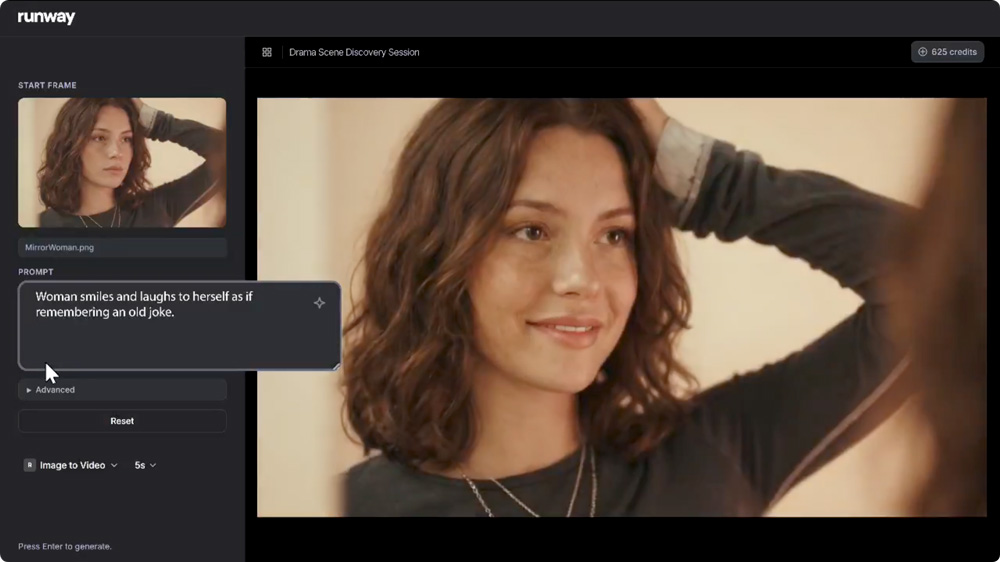

Die andere Herausforderung stellen KI-Methoden in der Raw-Konvertierung dar. Adobe hat mit seiner »Verbessern«-Funktion gezeigt, wie sich die Qualität des Demosaicing und damit die Rekonstruktion feinster Details optimieren lässt, und DxO hat mit der DeepPRIME-Technologie noch einmal einen draufgesetzt: Der Raw-Konverter von DxO verbindet das Demosaicing und die Rauschunterdrückung zu einem einzigen Schritt, womit nicht nur das Rauschen verringert, sondern auch die Detailauflösung verbessert wird. Herkömmliche Verfahren zur Rauschreduzierung arbeiten mit RGB-Daten, weshalb sie zwar störende Rauschmuster beseitigen; die vom Rauschen provozierten Fehler beim Demosaicing können sie jedoch nicht mehr beheben. Ein KI-Demosaicing ohne Rauschunterdrückung versagt wiederum bei Aufnahmen mit hohen ISO-Werten.

Solche KI-Verfahren setzen bislang einen Raw-Workflow voraus, denn sie können ihre Fähigkeiten nur dann voll ausspielen, wenn sie in der Bildverarbeitungspipeline möglichst früh eingreifen. Die Rechenleistung künftiger Generationen von Systemkameras muss vielfach gesteigert werden, wenn ihre interne Bildverarbeitung einen ähnlich hohen Stand wie Smartphones einerseits und Computer andererseits erreichen soll. Dazu wären Koprozessoren nötig, die für die Ausführung neuronaler Netze optimiert sind. Im Computer erfüllt meist der Grafikprozessor diese Aufgabe – er enthält Tausende relativ einfach aufgebauter Recheneinheiten, die sich nicht nur für grafische Operationen eignen, sondern ebenso zur Simulation von Neuronen. Im Pflichtenheft eines Kameraprozessors steht allerdings auch, dass er die geforderte Rechenleistung bei einem geringen Stromverbrauch und einer niedrigen Wärmeentwicklung erbringen soll. Hier bleibt für die Kamerahersteller – und ihre Zulieferer, denn die Prozessoren werden durchweg nicht im eigenen Haus entwickelt – noch viel zu tun.

Ich habe schon immer in ausschließlich in RAW fotografiert…… warum sollte ich die Kontrolle über meine Fotos an die Kamera abgeben, gerade, wenn man oft im Manuellen Modus arbeitet?

Klar kann ich auch JPGs bearbeiten, aber eben nur mit Verlusten. Und vor allem muss ich Dinge wie den Weißabgleich schon vor der Aufnahme festlegen.

KI gestützte Bildersuche möchte ich nicht mehr missen, Himmel austauschen mit KI ist auch nicht zu verachten. Die Bearbeitung überlasse ich aber nur mir selbst, denn nur ich weiß, wie das Ergebnis aussehen soll.

Aber wie immer ist das natürlich Ansichtssache.

Tja, alles gut und schön,

aber was macht man, wenn einem als Jugendlichem schon das Folgende passiert ist?

– Meine Eltern hatten den ersten Farbfernseher gekauft.

Diese Röhrengeräte haben die Möglichkeit geboten, die Farbbalance mittels Regler zu beeinflussen. So machten mein Vater, mein Bruder und ich selber uns daran, das Bild perfekt einzustellen. Als wir zufrieden waren, betrat Mutter die gute Stube und meinte nur „grauenhaft“.

Ja, alle meine männlichen Familienmitglieder hatten/haben denselben Defekt: Rot-Grün-Schwäche.

Da diese unheilbar und auch nicht korrigierbar ist, waren meine späteren Versuche, von meinem guten Schwarz-Weiß-Heimlabor auf Farbe umzusteigen (Cibachrome) zum Scheitern verurteilt…

Was tue ich also, wenn der RAW-Converter nach Farbe fragt?

Wie stelle ich die Regler ein?

Bisher habe ich mich auf die Nachbearbeitung der OOC-JPGS beschränkt und hüte mich davor, die Farbe zu beeinflussen.

Auch im Raw-Konverter kann man ja beim Weißabgleich der Kamera bleiben, oder einen automatischen Weißabgleich wählen. Das ergibt dann vielleicht nicht das theoretisch mögliche Optimum, aber es wird auf jeden Fall nicht völlig falsch sein – und was hier wirklich optimal wäre, ist sowieso Geschmackssache. Mein persönliches Empfinden ändert sich manchmal schon von der Raw-Entwicklungs-Orgie am späten Abend bis zum nächsten Morgen, wenn die Änderung des Umgebungslichts eine andere Referenz schafft.

Stimmt. Besser den Spatz in der Hand…

Ich probiere das mal aus,

Vielen Dank Herr Hußmann!