Machen wir’s doch mal ganz anders: Alternative Sensortechnologie

Alternative Sensortechnologie? Man sollte keineswegs denken, dass Laien keine guten Ideen hätten, wie ich letzten Samstag wieder einmal erfuhr. Bei meinem Nachbarn war Party, und da es später lauter werden sollte, hatte er vorsichtshalber die ganze Nachbarschaft gleich mit eingeladen. Man unterhielt sich über dies und das, und nachdem ich erzählt hatte, was ich so mache, kam das Gespräch bald auf die Digitalfotografie – und warum Sensoren nicht ganz anders funktionieren, als wir es kennen.

Ein Nachbar, Lehrer von Beruf, wunderte sich, dass man für einen Bildstabilisator noch bewegliche Linsen oder Sensoren braucht – ginge das nicht bequemer im Nachhinein per Software? Ich erklärte, dass man das bei Videoaufnahmen oft tatsächlich so macht: Die Kamera speichert Ausschnitte aus den vom Sensor gelieferten Bildern und verschiebt den Rahmen des Ausschnitts, um für einen ruhigen Bildstand zu sorgen. Der Betrachter wird dann auch von freihändig aufgenommenen Videos nicht seekrank, aber wenn ein Einzelbild aufgrund der Verwacklung unscharf ist, lässt sich das nicht mehr korrigieren. Für unverwackelte Filmbilder braucht die Kamera einen echten, optischen Bildstabilisator. Während der Belichtungszeit zittert das vom Objekt erzeugte Bild sonst über den Sensor, und jedes Detail hinterlässt eine Wischspur.

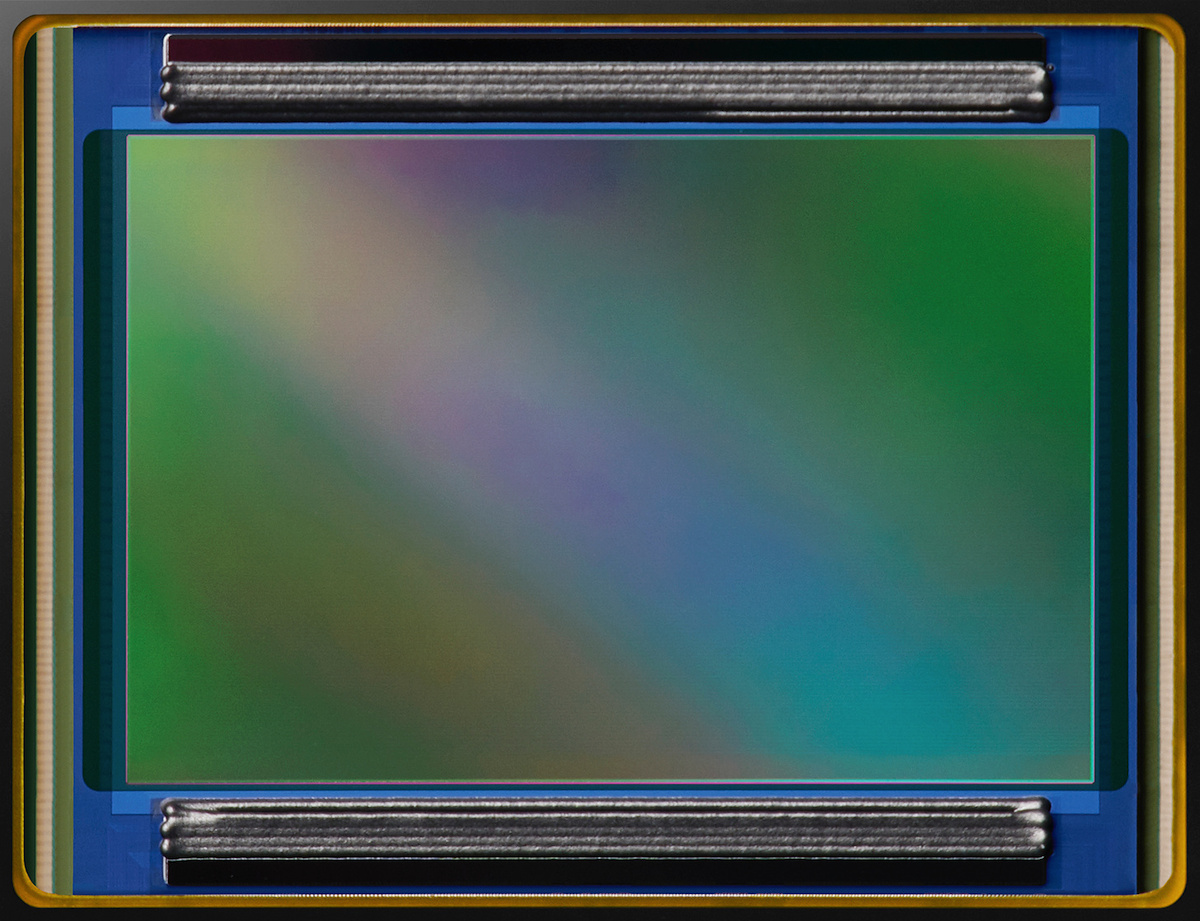

Dass mein Nachbar trotzdem an eine Bildstabilisierung per Software glaubte, lag an einem Missverständnis über die Arbeitsweise eines Bildsensors. Er stellte sich vor, dass die Sensorpixel wie Belichtungsmesser arbeiten und der Kamera ständig melden, wie hell es an dieser Stelle des Bildes gerade ist. Tatsächlich arbeiten Sensoren nicht so; vielmehr sammeln sie zunächst von auftreffenden Photonen freigesetzte Elektronen, die erst nach Ende der Belichtungszeit ausgelesen werden. Wir erfahren damit nur etwas über die durchschnittliche Helligkeit während der Belichtung, allerdings nicht, wie sich diese währenddessen verändert hat.

Aber die Idee meines Nachbarn hat etwas für sich, weshalb er allerdings auch nicht der Erste ist, der sie hatte. Es wäre eine tolle Sache, wenn ein Sensor jedes Auftreffen eines Photons melden könnte, also für jedes Photon die Zeile und Spalte des Pixels, in dem es aufschlug. Ein Bildstabilisator könnte dann die Koordinaten jedes Einschlags entsprechend der gemessenen Kamerabewegungen korrigieren, und das Ergebnis wäre ein Bildstabilisator ohne bewegliche Linsengruppe oder Sensor.

Ein solcher Sensor hätte noch weitere Vorteile. Da ein auftreffendes Photon sofort gemeldet würde, müssten keine elektrischen Ladungen mehr gespeichert werden, und damit könnten keine Ladungsspeicher mehr überlaufen – es wären gar keine Ladungsspeicher mehr nötig. Damit gäbe es keine Überbelichtung und folglich auch keine Begrenzung des Dynamikumfangs mehr. Man könnte zudem beliebig kleine ISO-Werte wählen, um das Rauschen zu minimieren.

Warum also baut man Sensoren nicht so? Warum gibt es noch keine alternative Sensortechnologie? Nehmen wir an, wir fotografieren ein Motiv im hellen Tageslicht, so dass während einer 1/100 Sekunde vielleicht rund 50.000 Photonen ein Sensorpixel erreichen. Nehmen wir weiter an, der Sensor hätte 36 Megapixel. Dann müssten pro Sekunde 50.000 * 36.000.000 Photonentreffer mit deren Koordinaten gemeldet werden, und für die Koordinaten benötigen wir etwa 4 Byte. Das wären 7,2 Terabyte pro Sekunde, die zwischen Sensor und Kameraelektronik ausgetauscht werden müssten. Zudem fielen dann 72 Gigabyte Rohdaten pro Bild an. Da das Bild nicht überall gleich hell sein dürfte, wären die tatsächlichen Zahlen zwar etwas geringer, und wenn bei schlechten Lichtverhältnissen weniger Photonen auftreffen, wären sie noch einmal niedriger, aber das nützte nicht viel: Um den Vorteil eines unbegrenzten Dynamikumfangs und eines bei niedrigen ISO-Werten geringen Rauschens zu genießen, müssen wir ja viele Photonen sammeln, und die Bildgröße wächst entsprechend an. Ganz ohne Beschränkungen ließe es sich auch mit einem solchen Sensor nicht fotografieren, denn die Grenzen setzen der erreichbare Durchsatz und die verfügbare Speicherkapazität. Nicht zu vergessen: Auch die Verarbeitung der Rohdaten würde vielfach höhere Anforderungen stellen, als wir es gewohnt sind.

Bis ein Photonentreffer meldender Sensor in der Fotografie eingesetzt werden kann, wird daher noch einige Zeit vergehen. Aber es gibt noch andere Ideen für alternative Sensoren, die nicht ganz so radikal sind, dafür aber größere Aussichten erkennen lassen, um tatsächlich realisiert zu werden. Erst jüngst präsentierte eine Gruppe von Informatikern (Montek Singh, Pintian Zhang, Andrew Vitkus, Ketan Mayer-Patel und Leandra Vicci) der University of North Carolina at Chapel Hill ein Paper über „A Frameless Imaging Sensor with Asynchronous Pixels: An Architectural Evaluation“.

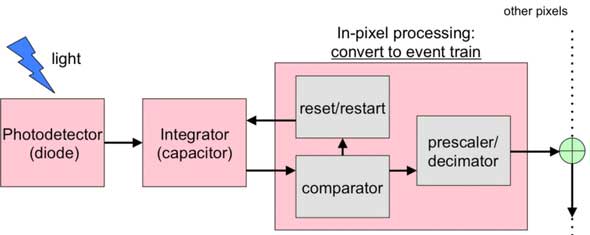

Der darin vorgeschlagene, asynchrone Sensor enthält im Gegensatz zu den heute üblichen Sensoren keine A/D-Wandler, die die aus jedem Pixel ausgelesenen Spannungen zu 12 oder 14 Bits digitalisieren, sondern lediglich einen Schaltkreis, der ein Signal erzeugt, sobald die in einem Pixel gesammelten Ladungen einen vorgegebenen Wert erreichen; gleichzeitig wird das Pixel zurückgesetzt, so dass es erneut anfangen kann, Ladungen zu sammeln.

Das Signal enthält die Pixelkoordinaten und einen Faktor – ein sogenannter „Dezimator“ sorgt dafür, dass gegebenenfalls nur jedes zweite, vierte oder achte etc. Signal weitergegeben wird. Die Auswerteelektronik misst nun die Zeit, die zwischen zwei Signalen desselben Pixels vergeht – je größer diese Zeit, desto weniger Licht fällt auf das Pixel. Da lange Zeiten präziser gemessen werden können als kurze, ist die Tonwertauflösung in den Schatten höher als in den Lichtern, was dem menschlichen Sehvermögen gut entspricht – bei herkömmlichen Sensoren ist es gerade umgekehrt. Wenn eine Szene sehr hell ist, kann der Dezimator die zu messenden Zeiten verlängern und so die Messgenauigkeit vergrößern; auf diese Weise ließe sich der Dynamikumfang vergrößern.

Ein solcher asynchron arbeitender Sensor hätte einige positive Eigenschaften, wie man sie auch mit einem auf einzelne Photonentreffer reagierenden Sensor bekäme, wäre aber mit sehr viel geringerem Aufwand zu realisieren. Für eine Bildstabilisierung per Software wäre er allerdings kaum geeignet. Ob der asynchrone Sensor jemals gebaut werden wird, lässt sich noch nicht abschätzen; seine Erfinder verfügen bislang nur über ein Simulationsmodell und hoffen auf Geldgeber zur Finanzierung der weiteren Entwicklung. Man sieht aber bereits, dass es nützlich sein kann, eine vertraute Aufgabe wie die digitale Bildwandlung auch einmal ganz anders anzugehen – und manchmal wundert sich der Laie, warum man es nicht immer schon so gemacht hat.

„Tatsächlich arbeiten Sensoren nicht so; vielmehr sammeln sie zunächst von auftreffenden Photonen freigesetzte Elektronen, die erst nach Ende der Belichtungszeit ausgelesen werden. Wir erfahren damit nur etwas über die durchschnittliche Helligkeit während der Belichtung, allerdings nicht, wie sich diese währenddessen verändert hat.“ Das mit der „durchchnittlichen Helligkeit irritiert mich etwas – bisher bin ich davon ausgegangen, dass am Ende die kumulierte Helligkeit, also die Höhe der Ladung ausgelesen wird.