Künstliche Intelligenz: Bilder aus Texten auf eigenem Rechner generieren

Dall-E2, ein KI-System, das Bilder aus Texten generiert, hat die Betaphase verlassen und sorgt nun für fotorealistische Ergebnisse. Die KI Midjourney erschafft ebenfalls beeindruckende Kunstwerke. Alle Motive entstehen nur per Texteingabe. Aber auch für gar nicht so wenig Geld. Die Opensource-KI Stable Diffusion kann dagegen kostenlos auf dem heimischen Rechner ausgeführt werden. Wie das geht und wie meine ersten eigenen Experimente ausfallen, lesen Sie hier.

Künstliche Intelligenz: Text-zu-Bild-Generatoren

Wozu KI in der Lage ist, hatte ich Ihnen in meinem Blogbeitrag über die Zukunft der Bildbearbeitung bereits zusammengestellt. Das meiste davon ist bereits Realität. Und manches lässt sich sogar ohne Cloudservices auf dem eigenen Rechner ausführen.

Proprietäre Systeme

Die proprietären Text-zu-Bild-KI-Systeme Dall-E2 und Midjourney lassen sich nur serverbasiert ausführen. Sie müssen also Text in eine Webseite oder einen Discord-Chatbot eingeben und das Bildergebnis in der Cloud berechnen lassen. Der Vorteil: Man erhält aufgrund der hohen Rechenleistung der Renderfarmen voller Grafikkarten schnell Ergebnisse. Der Nachteil: Sie müssen für diese Dienstleistung zahlen. In Anbetracht der Hardware-, Unterhalts- und Stromkosten von Renderfarmen ist das auch verständlich. So zahlen Sie bei Midjourney nach Verbrauch der Testcredits mindestens 10 Euro pro Monat – wobei Sie jedoch bei ausgiebigem Experimentieren schnell an Grenzen stoßen. Also sollte es schon das größere Paket für 30 Euro sein, bei dem man mit sogenannter „Relax-Time“ (also etwas Wartezeit nach Verbrauch des schnellen Kontingents) quasi unbegrenzt Bilder erzeugen lassen kann. Bei dem Token-basierten Bezahlsystem von Dall-E zahlt man nicht monatlich, sondern per Generierung – das kann aber schnell teuerer als Midjourney werden, wenn man spielt und experimentiert.

Opensource

Zum Glück gibt es auch eine Opensource-KI namens Stable Diffusion. Den notwendigen Code kann man sich hier herunterladen. Die Installation und Nutzung ist jedoch eher etwas für KI-, Script- und Computerexperten. Als Künstler hat man darauf eigentlich wenig Lust. Zum Glück gibt es schon die ersten Systeme, die sich relativ einfach installieren lassen und damit Stable Diffusion nutzbar machen. Das Tolle: Alles wird auf dem eigenen Rechner gerendert. Sie müssen für die Verwendung nach der Installation keine Internetverbindung haben und kein Geld ausgeben.

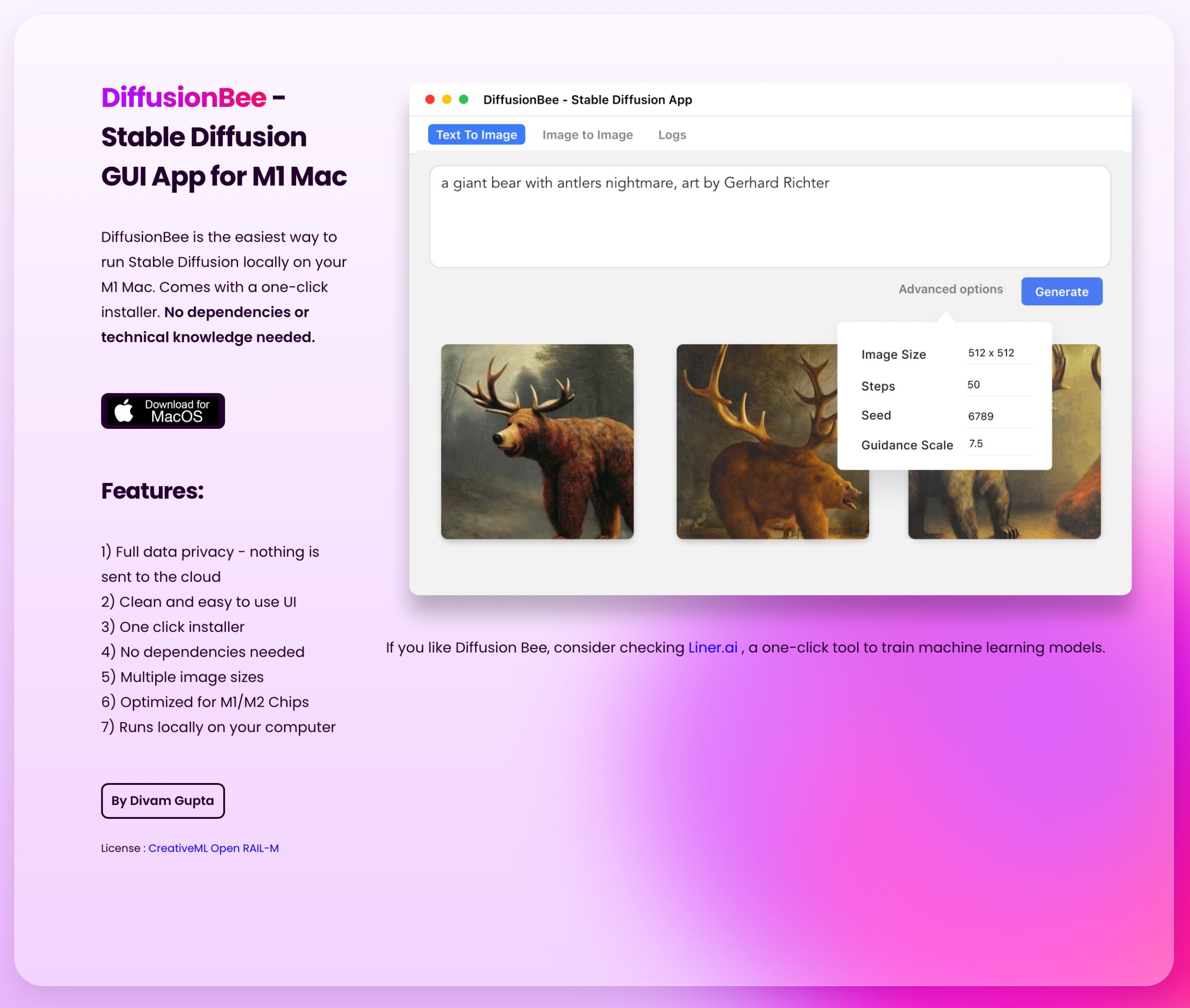

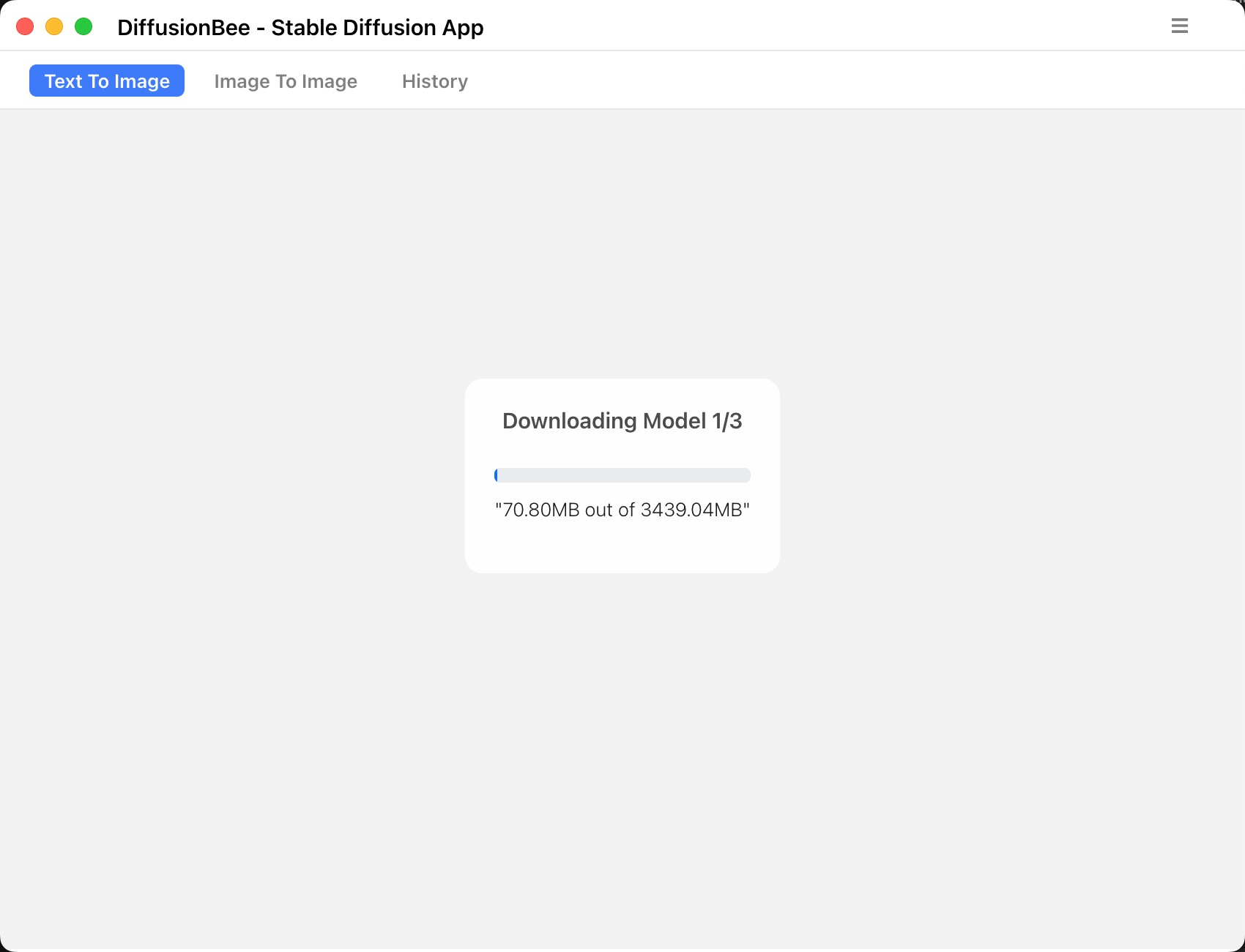

KI-Generator für Apple Silicon-Macs

Wenn Sie einen Mac mit M1- oder M2-Chip nutzen, gibt es einen Ein-Klick-Installer. DiffusionBee laden Sie herunter, öffnen es, warten ab, bis die (mehrere Gigabyte großen) KI-Modelle heruntergeladen sind, und können dann direkt loslegen.

Auf meinem Mac Studio dauert die Generierung eines Bildes nach der Texteingabe je nach Größe (512 px × 512 px ist ein guter Kompromiss) 10 Sekunden und länger. Hervorzuheben ist, dass DiffusionBee Eingabe (Prompt)-Vorschläge anbietet, mit denen Sie sich das Gewünschte zusammenklicken können. Englisch-Kenntnisse sind hier Voraussetzung. Toll ist auch, dass Sie einfach mehrere Bilder auf einmal generieren lassen können. Nach ein, zwei Kaffee sind die dann auch fertig gerendert.

Windows und Nvidia: Dream Textures for Blender

Schneller als mit jedem aktuellen Mac geht der Spaß, wenn Sie eine Nvidia-Grafikkarte mit mindestens 6 GB Video-RAM besitzen. Sie benötigen also einen PC, da sich Apple und Nvidia einmal auseinandergelebt haben. Wie Sie von der Geschwindigkeit der Nvidia-GPUs – auch in Laptops – profitieren können, habe ich Ihnen hier bereits einmal umfassend geschildert: Der Kreativbooster: NVIDIA Studio (das gezeigte Notebook ist inzwischen ausverkauft; Sie müssen nur darauf achten, dass Sie möglichst viel mehr als 6 GB Video-RAM und eine Nvidia-RTX-Grafikkarte verbaut haben, wenn Sie ein ähnliches Gerät für Stable Diffusion oder auch Blender suchen).

Das Problem – zumindest für mich – war nun, dass ich keine App für Stable Diffusion gefunden habe, die ähnlich einfach wie DiffusionBee für den Mac funktionieren würde und mir den Installationsvorgang abnimmt oder mich zumindest dabei unterstützt. Auch das normale Eingabe-System basiert auf dem Terminal und man muss viele Parameter zur Bildgenerierung immer wieder eingeben.

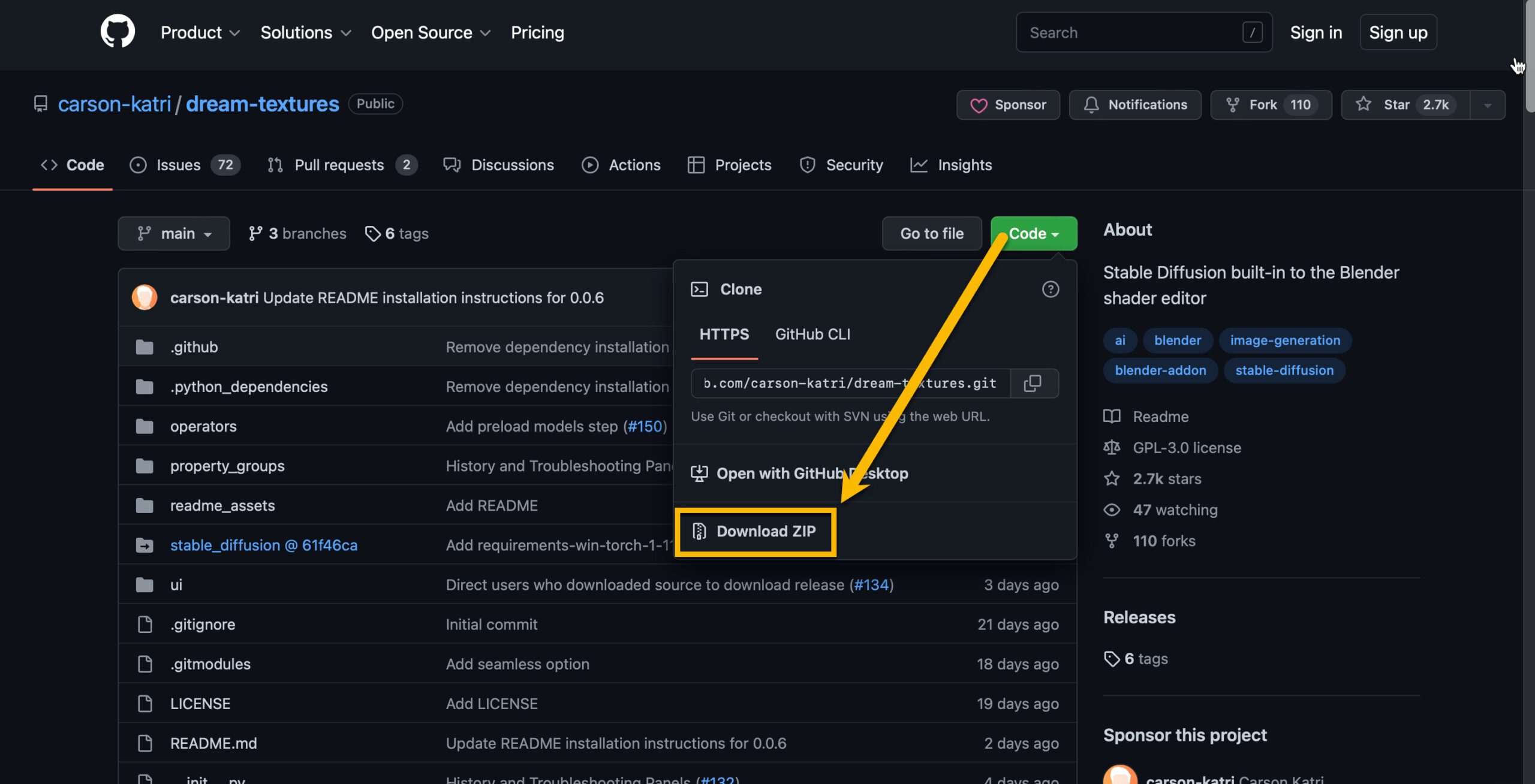

Installation: Stable Diffusion per Blender-Plug-in

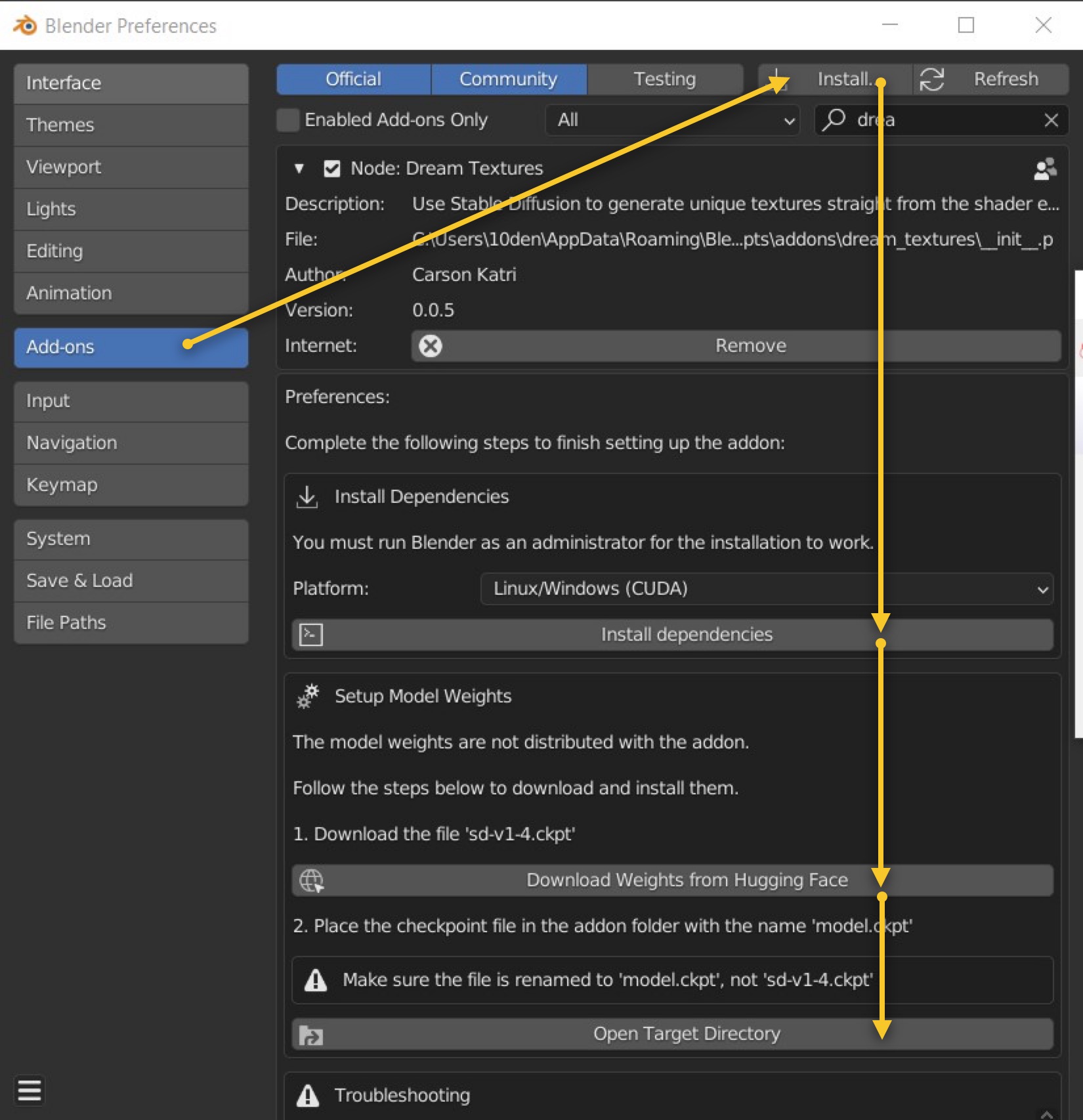

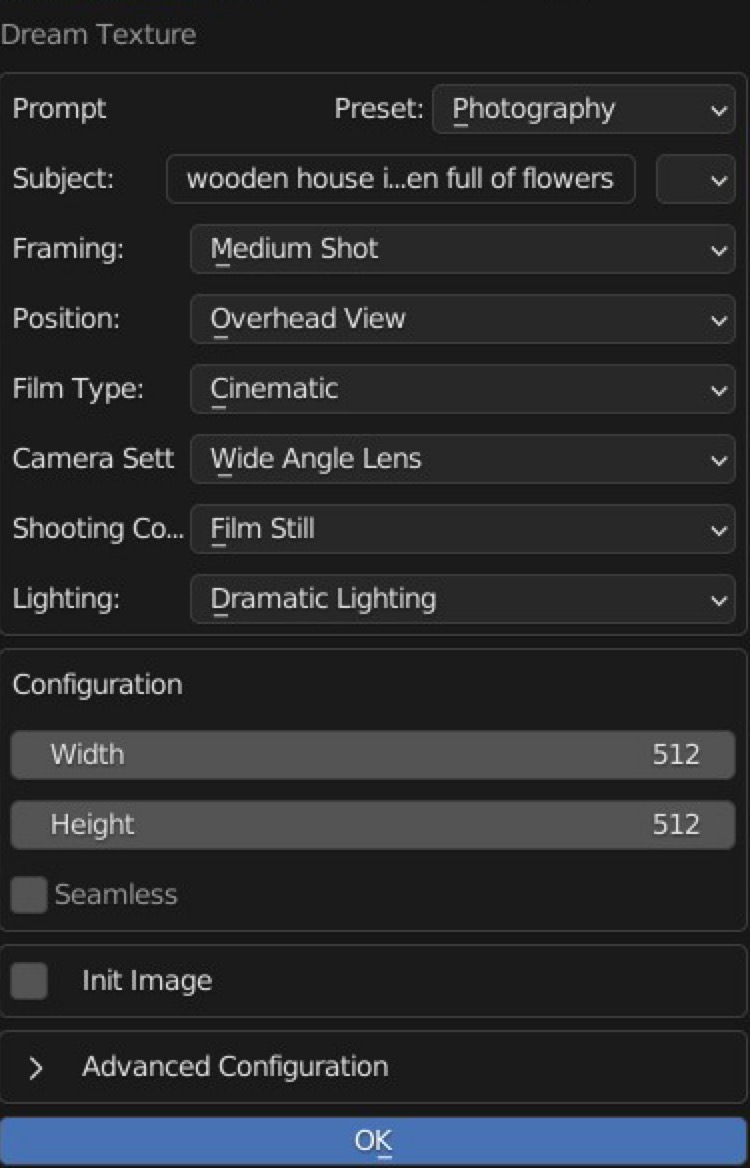

Glücklicherweise bin ich über das Blender-Plug-in Dream-Textures gestolpert. Dieses erlaubt das Erzeugen von nahtlosen Texturen, aber auch von an Fotografie und Concept-Art erinnernden Bildern in Blender. Vor allem aber führt es durch den Installationsvorgang, wenn man einige kleine Hürden kennt. Hier ein Überblick:

- Laden Sie zunächst das Plug-in auf Github herunter:

- Öffnen Sie Blender. Wichtig: Starten Sie Blender als Admin! Das war der Hauptgrund, warum meine ersten Installationsversuche der KI-Modelle immer wieder abbrachen.

- In den Blender-Voreinstellungen klicken Sie auf »Add-ons > Install« und wählen dort die heruntergeladene ZIP-Datei aus. Aktivieren Sie das Plug-in, indem Sie die Checkbox anklicken. Das Plug-in führt nun durch die Installation:

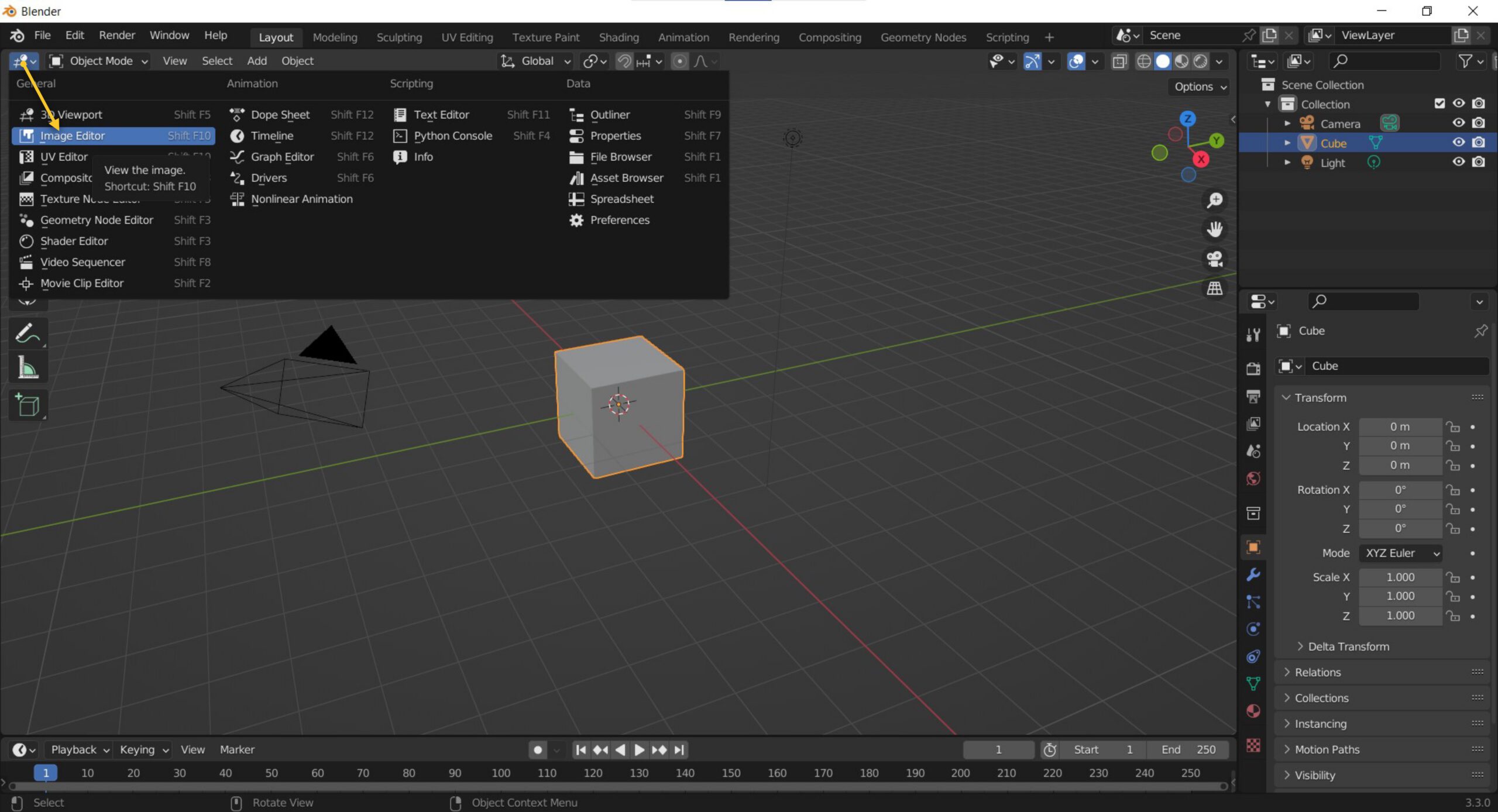

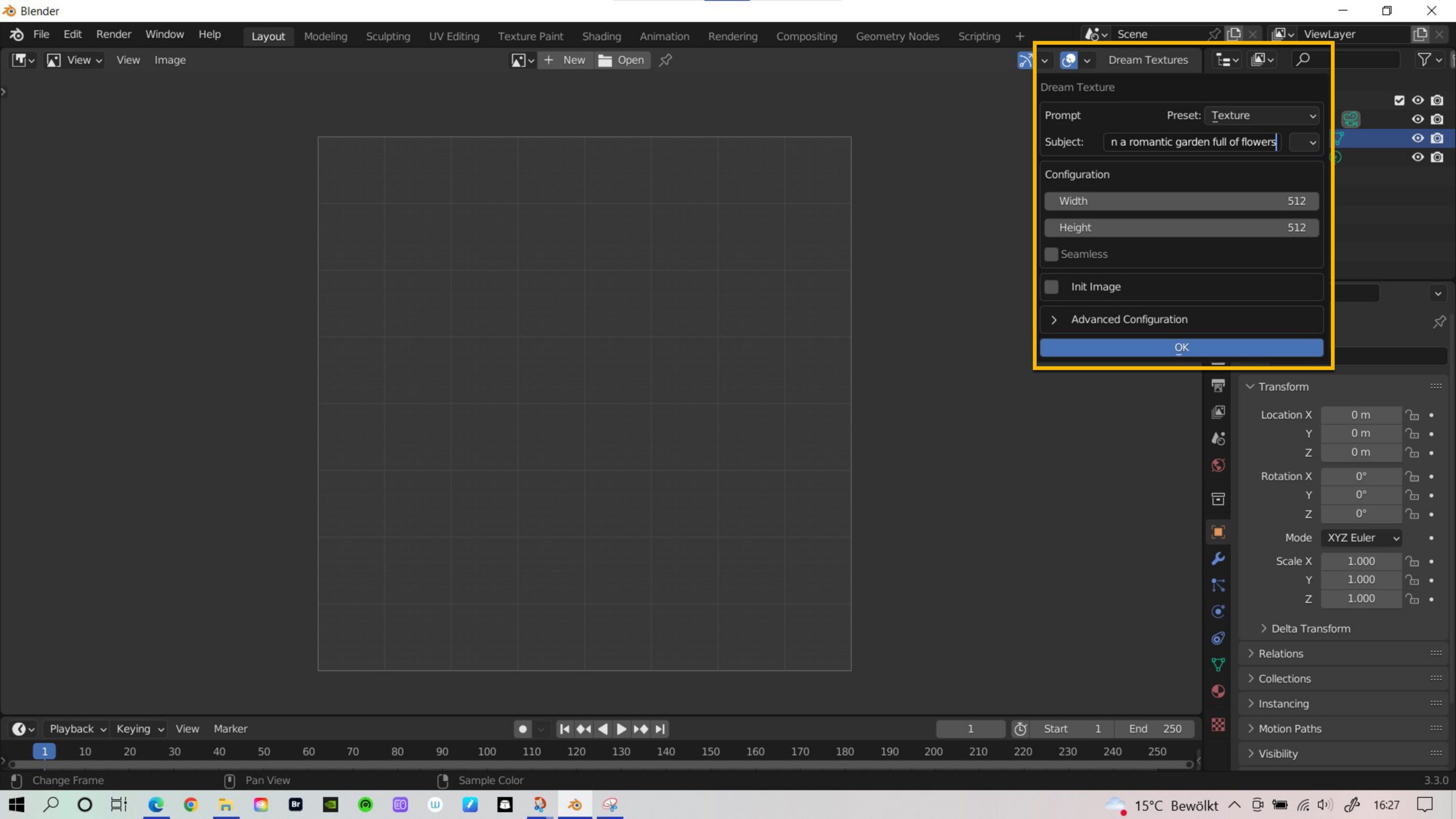

Nutzung: Stable Diffusion per Blender-Plug-in

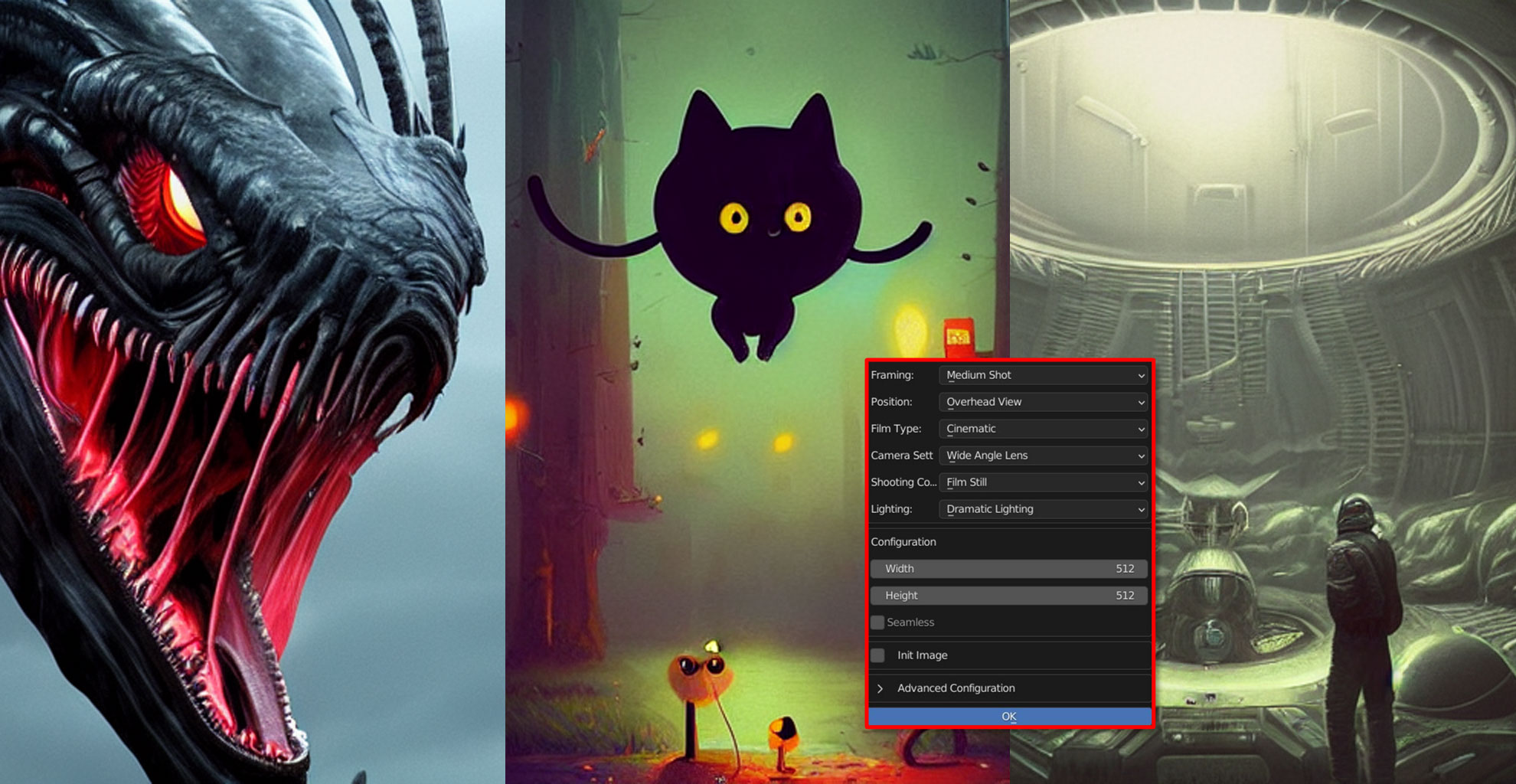

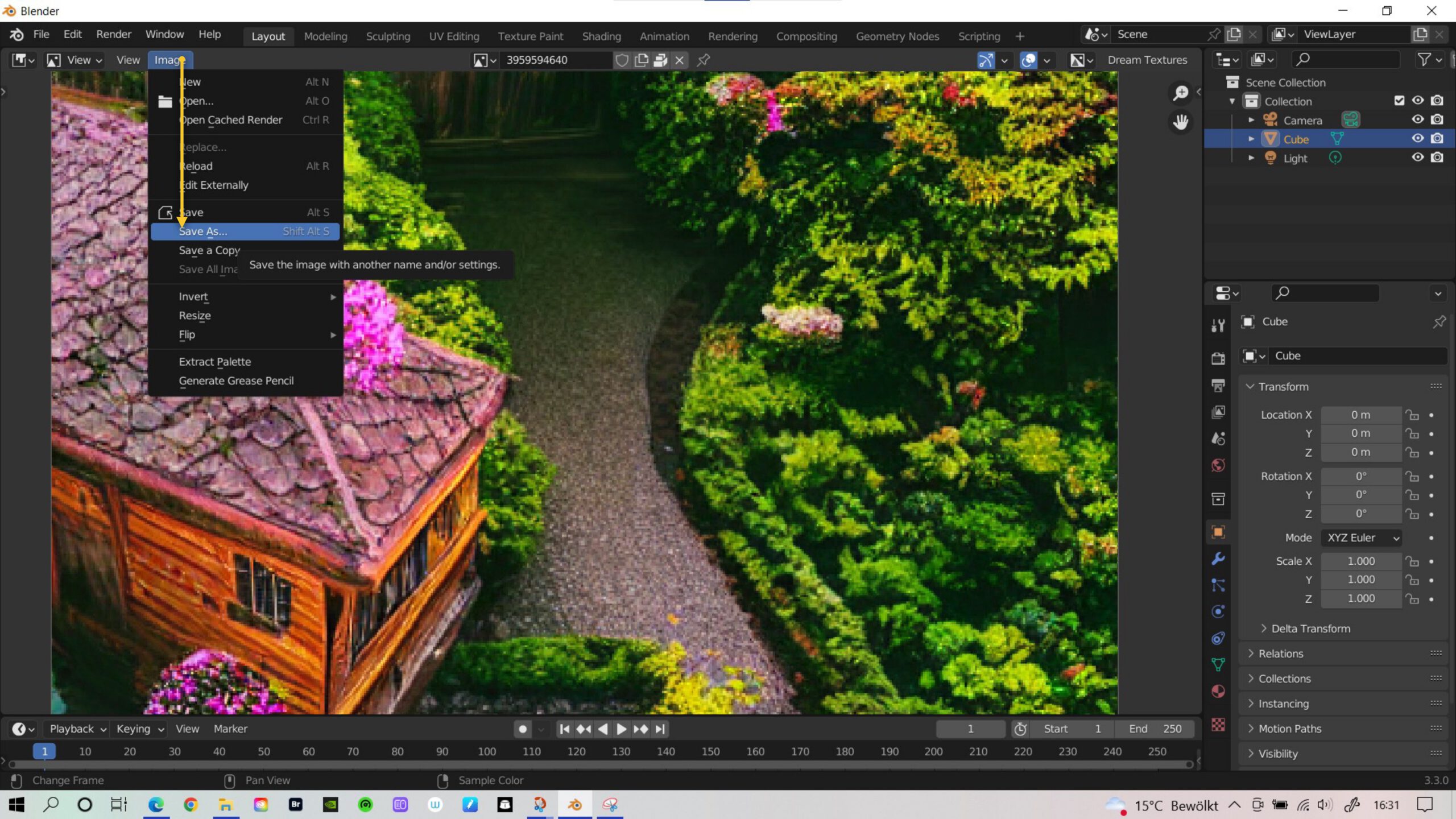

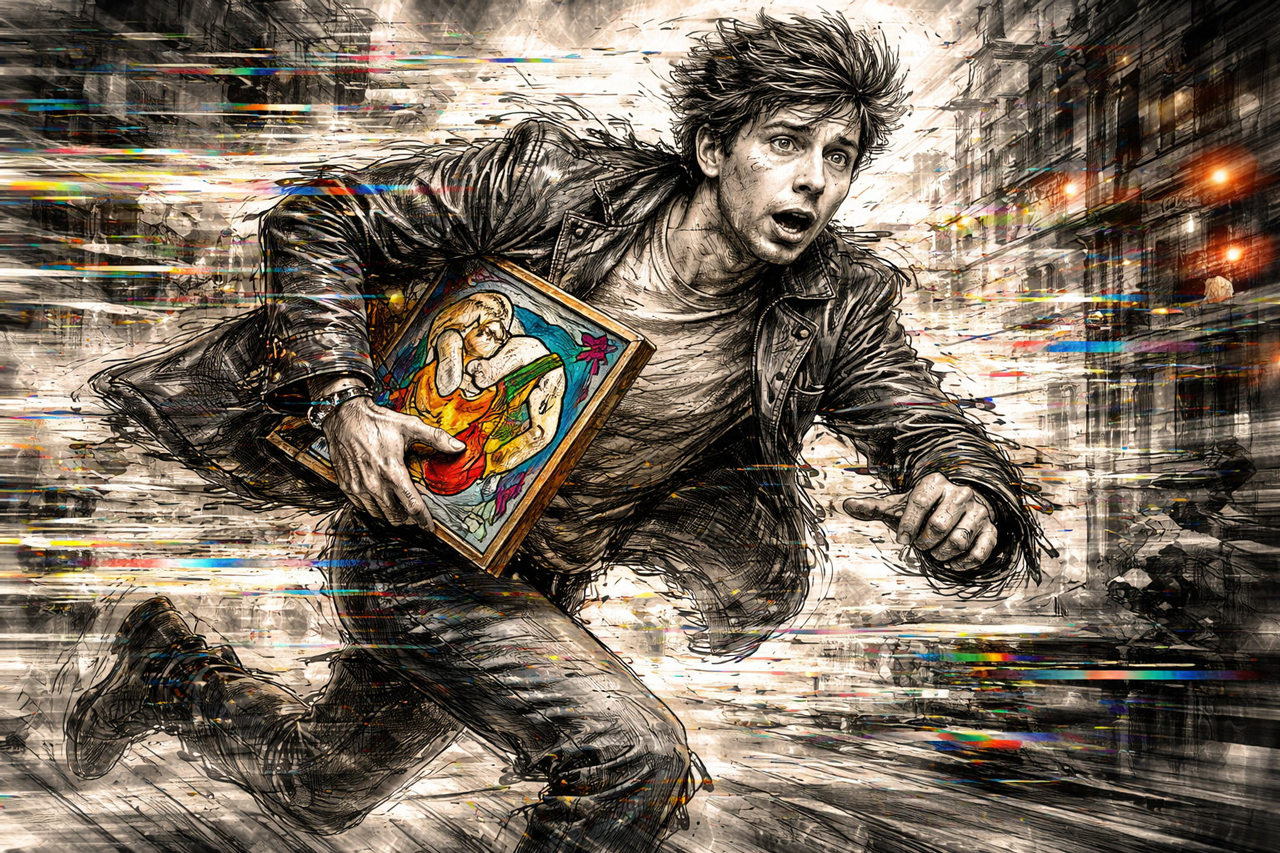

Meine Experimente

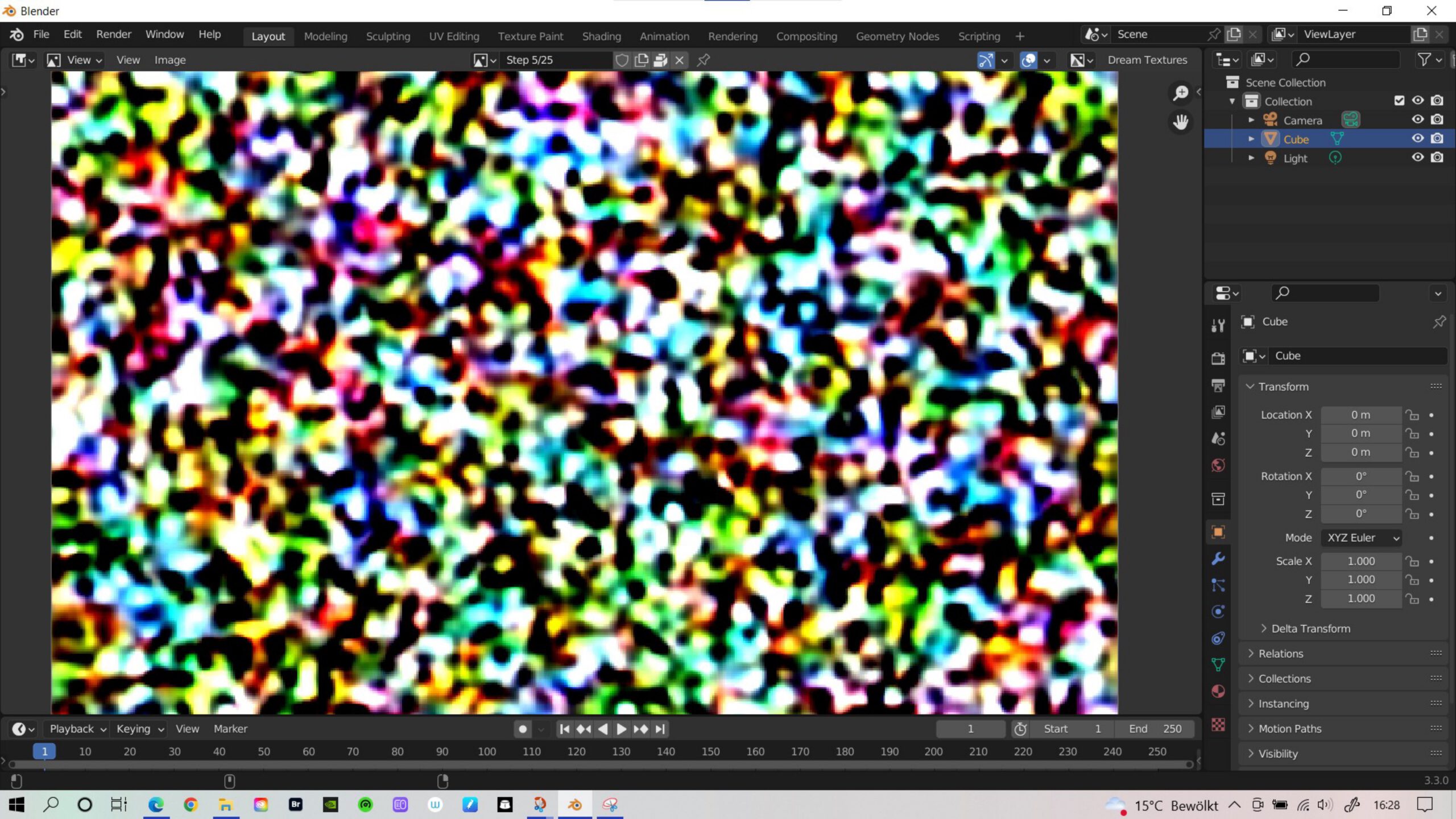

Natürlich habe ich gleich mal die verschiedensten Ideen ausprobiert. Hier eine kleine Auswahl, was Stable Diffusion für mich produziert hat. Die Bilder sind alle 512 × 512 px groß. Für eine weitere Verwendung würde ich diese mit Topaz Gigapixel AI hochskalieren.

Viel Spaß beim Anschauen der Bilder, und vielleicht probieren Sie es gleich selbst einmal aus!

Für Photoshop unter Windows gibt es Stable Diffusion als Plug-In; man kann es über Creative Cloud Desktop>Applikationen>Stock und Marktplatz>Stable Diffusion herunterladen, muß sich allerdings wegen der API gesondert registrieren.

Das Stable Diffusion Plug-in von Christian Cantrell nutzt den Cloud-Dienst von Dream Studio. Man hat zwei Dollar zum Ausprobieren frei, dann muss man Credits hinzukaufen.

Das Plug-in von Flying Dog kostet 89 $ und muss für die lokale Anwendung vergleichsweise aufwendig eingerichtet werden.

Hier in meinem Blogbeitrag geht es nur um die einfach und lokal ausführbaren Möglichkeiten, die nichts weiter kosten. JFYI

Na holla, die KI macht den Herrn Giermann ja zum regelrechten Gigermann. Interessante Sache!