Focus & Recompose revisited

Vor fünf Jahren schrieb ich in der DOCMA 51 über den Focus&Recompose-Fehler, der oft zu leicht unscharfen Fotos führt. Leider gibt es nach wie vor nur wenig Möglichkeiten, den Fehler zu vermeiden, aber wenigstens können Sie sich jetzt bequem ausrechnen lassen, ob dieser Fokussierfehler in einem konkreten Fall Probleme machen kann.

In meinem Artikel „Das Phantom der Entfernung“ (DOCMA 51, Seite 80 ff.) hatte ich eine ganze Reihe von Situationen in der Fotografie beschrieben, in denen uns die Intuition in die Irre führt: Die Entfernung, auf die wir scharfstellen müssen und die den Abbildungsmaßstab bestimmt, ist oft eine andere als die, die wir naiverweise dafür halten.

Das Problem

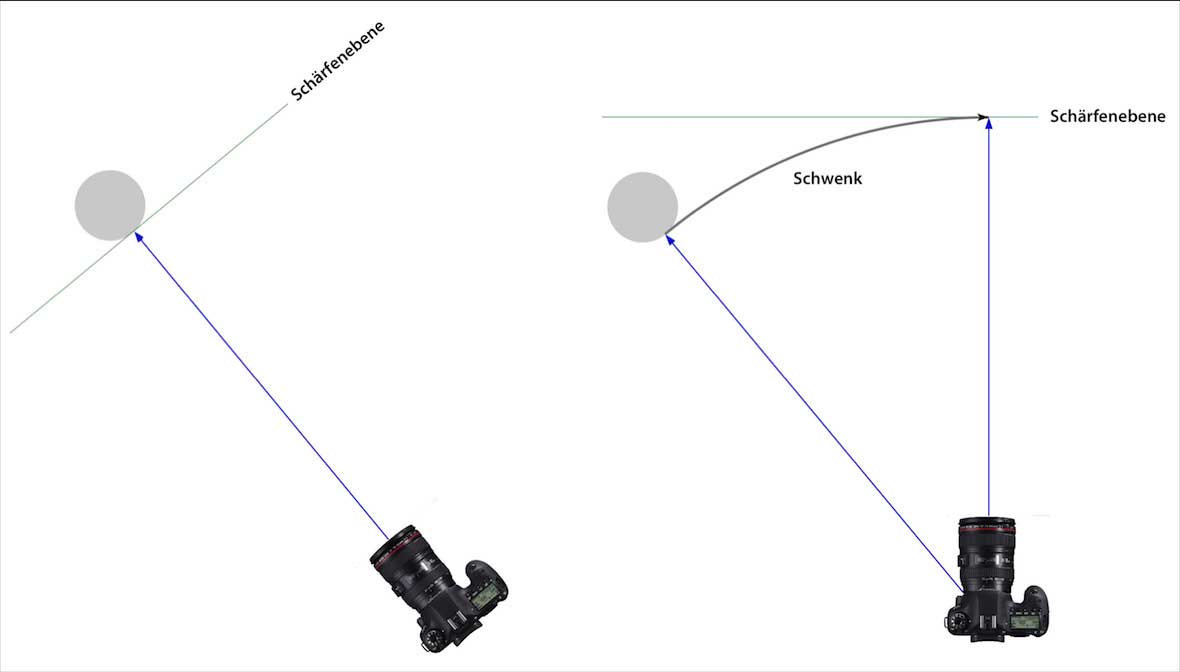

Der Focus&Recompose-Fehler ist nur ein Beispiel dafür: Wenn wir auf ein Motiv nahe dem Bildrand scharfstellen wollen, aber nur ein zentrales AF-Feld haben (oder die auswählbaren Messfelder alle nahe der Bildmitte liegen), dann ist es verführerisch, die Kamera zu schwenken und mit dem mittleren Messfeld zu fokussieren, um dann zurück zu schwenken und mit der gespeicherten Fokussierung auszulösen. Tatsächlich haben wir damit aber auf einen Punkt hinter dem Motiv scharfgestellt, und das Motiv selbst wird mehr oder weniger unscharf abgebildet. Warum das so ist, zeigt diese Illustration aus „Das Phantom der Entfernung“: Nach der Neuausrichtung der Kamera liegt die Schärfenebene hinter dem Motiv.

Die Schärfentiefe kann diesen sogenannten Focus&Recompose-Fehler zwar oft kaschieren, aber durchaus nicht immer; zudem wollen wir im Interesse eines schönen Bokehs oft nicht so weit abblenden, wie es dazu nötig wäre.

Mögliche Lösungen

Ideal wäre es, wenn wir gar nicht zu schwenken bräuchten, weil wir auch am Bildrand noch scharfstellen könnten, aber dem stehen meist technische Gründe entgegen. Messsucherkameras wie die Leica M blenden nur in der Mitte des Suchers ein Mischbild ein, das als Schärfeindikator dient. Die dedizierten AF-Sensoren von DSLRs haben ein eingeschränktes Sichtfeld und können die Ränder daher nicht abdecken. Spiegellose Systemkameras, die per Kontrastvergleich scharfstellen, können die gesamte Fläche des Bildsensors nutzen, aber bei dem – wegen seiner Geschwindigkeit oft bevorzugten – Phasendetektionsverfahren gibt es wiederum Beschränkungen. Man kann den Bildsensor zwar vollflächig mit Phasendetektionspixeln ausrüsten, aber ob die Fokussierung am Rand noch funktioniert, hängt vom Objektiv ab. Die Phasendetektion beruht ja darauf, die Bilder zu vergleichen, die man durch die eine und die andere Hälfte des Objektivs sieht, und am Rand kann die Vignettierung so stark sein, dass eine Hälfte bereits vollständig verdeckt wird.

Hasselblad hatte schon vor Jahren eine recht pfiffige Lösung entwickelt, die aus der Not, dass die AF-Felder der H-System-Kameras alle in der Bildmitte liegen, eine Tugend macht: Der Fotograf kann problemlos mit der Focus&Recompose-Methode arbeiten, also erst fokussieren und dann den Bildausschnitt wählen, denn Gyrosensoren in der Kamera registrieren den Schwenk, und der AF-Algorithmus gleicht den sich daraus ergebenden Fehler selbsttätig aus. Insbesondere Kameras mit integriertem Bildstabilisator könnten auf diese Lösung zurückgreifen, da die nötigen Gyrosensoren ohnehin vorhanden sind, aber dem stehen wohl Lizenzierungsprobleme entgegen – bislang hat kein anderer Hersteller Hasselblads Verfahren übernommen.

Kenne Deinen Gegner

Wenn man das Problem schon nicht mit irgendeiner technischen Lösung beseitigen kann, sollte man es sich wenigstens bewusst machen. In manchen Fällen ist ein Schwenk nach der Fokussierung ja auch ganz harmlos, aber wie soll man die Situationen erkennen, in denen man den Fokussierfehler ausgleichen muss? Im Internet findet man verschiedene Formeln, mit denen man die Fokusverschiebung ausrechnen kann; mit Hilfe eines Taschenrechners mit cos-Taste für die Kosinus-Funktion ist das auch nicht schwierig, aber doch umständlich. Außerdem sagt einem das Ausmaß des Fehlers noch nicht viel; um herauszubekommen, ob es problematisch ist, muss man zusätzlich die Schärfentiefe kennen.

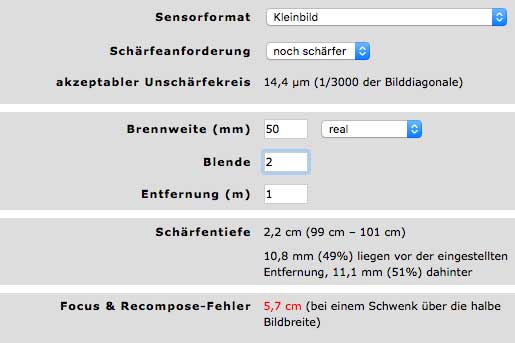

Da ein Schärfentiefenrechner ohnehin über alle Informationen verfügen muss, die zur Berechnung des Focus&Recompose-Fehlers nötig sind, liegt es nahe, beide Berechnungen zu integrieren. Genau das habe ich nun getan und die Fehlerberechnung in meinen Schärfentiefenrechner eingebaut:

Wenn der Fehler, der bei einem Schwenk um die halbe Bildbreite entsteht, nicht mehr durch die Schärfentiefe kaschiert wird, wird die Verschiebung – wie in diesem Beispiel – rot hervorgehoben, andernfalls wird sie schwarz angezeigt.

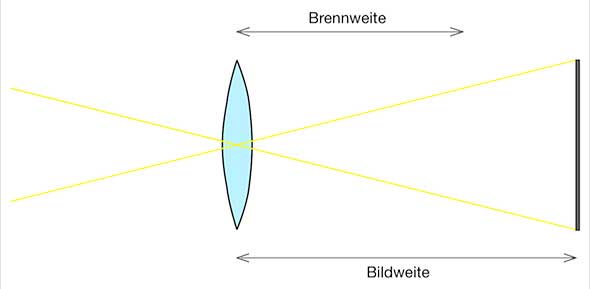

Für ein möglichst präzises Ergebnis bin ich etwas anders vorgegangen als es auf vielen Seiten im Internet beschrieben wird: Dort wird der Bildwinkel auf Basis der Brennweite berechnet, was aber eine nicht immer zulässige Vereinfachung ist. Der Bildwinkel hängt nicht von der Brennweite ab, sondern von der Bildweite, also der Entfernung zwischen Objektiv und Sensor. Nur wenn man auf Unendlich fokussiert, entspricht diese der Brennweite; bei kürzeren Entfernungen ist sie länger, so dass der Bildwinkel schrumpft. Da der Focus&Recompose-Fehler vor allem im Nahbereich problematisch ist, empfiehlt es sich, mit der Bildweite zu rechnen, die sich nach der Linsengleichung aus der Brennweite und der Entfernung ergibt. Falls sich die Brennweite des Objektivs mit der Entfernungseinstellung ändert, versagt zwar auch dieses Verfahren, aber genauer geht es nicht, wenn man nicht Profile für alle unterstützten Objektive anlegen will.