Sensorgeflüster: Von Zeit und Raum – Live-ND

Wenn man die von Olympus entwickelten Belichtungsmodi Live-Bulb, Live-Composite und Live-ND konsequent weiterdenkt, kommt man auf eine Methode, wie man auch mit sehr kleinen Sensorpixeln Bilder mit hoher Qualität erzeugen kann: Da der Raum begrenzt ist, muss man in die vierte Dimension ausweichen – die der Zeit.

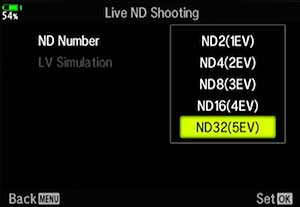

Für diejenigen, die noch nie eine halbwegs aktuelle Olympus-Kamera in der Hand hatten: „Live-Bulb“ ist ein 2012 eingeführter Modus für Langzeitbelichtungen, in dem sich das Bild schon während der Belichtung sukzessive auf dem Display aufbaut. Der Fotograf wartet, bis ihm das Ergebnis optimal erscheint, und schließt dann den Verschluss. Zwei Jahre später führte Olympus den „Live-Composite“-Modus ein, bei dem sich nach einer ersten Belichtung weitere Belichtungen anschließen, die das Bild weiter aufhellen – aber nur in den Bildbereichen, in denen sich die Helligkeit vergrößert hat. Man kann also beispielsweise eine nächtliche Landschaft und die Spur der Sterne am Himmel fotografieren, ohne wie sonst üblich zwei unterschiedlich lange Belichtungen in Photoshop kombinieren zu müssen. Mit der neuen OM-D E-M1X kommt ein „Live-ND“-Modus hinzu, der auch bei guten Lichtverhältnissen Langzeitbelichtungen erlaubt – so als würde man ein ND-Filter einsetzen, aber mit der Möglichkeit, das Ergebnis schon während der Belichtung auf dem Bildschirm zu kontrollieren.

Technisch gesehen sind alle diese Verfahren nicht besonders komplex. Es ist keine Raketenwissenschaft, aber natürlich muss man erst einmal darauf kommen. Tatsächlich ist die Grundidee aller drei Live-Modi dieselbe: Eine laufende Belichtung wird mit einem elektronischen Verschluss regelmäßig unterbrochen und der Sensor ausgelesen und zurückgesetzt; das letztendlich gespeicherte Bild entsteht aus einer Verrechnung aller ausgelesenen Daten. Der Unterschied zwischen Live-Bulb, Live-Composite und Live-ND liegt vor allem darin, wie die einzelnen Teilbelichtungen miteinander verrechnet werden. Im Live-ND-Modus kommt hinzu, dass die Belichtungszeit der Teilbelichtungen um so kürzer ist, je stärker der simulierte ND-Filter ist, während die Pausen zwischen den Teilbelichtungen entsprechend anwachsen.

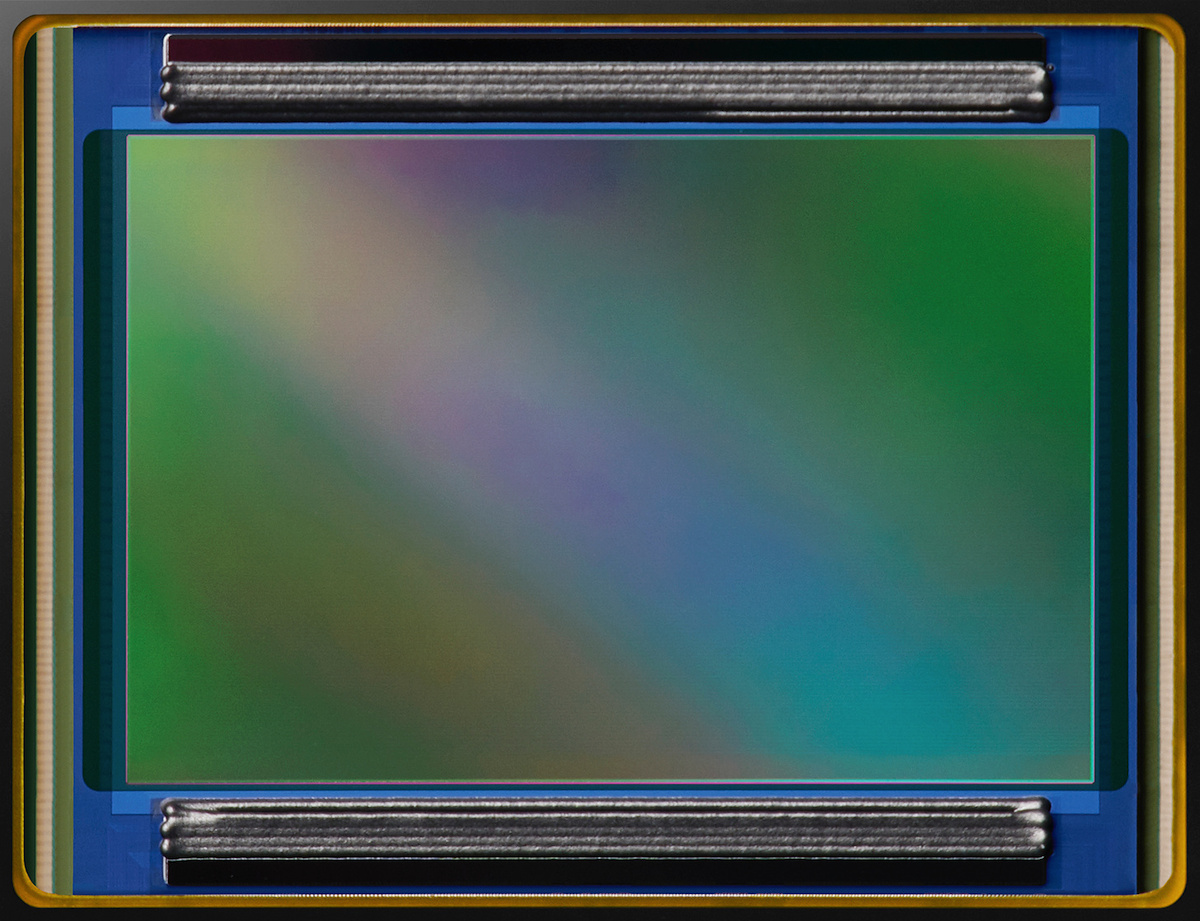

Die Zerlegung einer Belichtung in eine Vielzahl von Teilbelichtungen könnte auch das Problem lösen, dass Sensoren mit einer immer größeren Zahl immer kleinerer Pixel pro Sensorpixel eine immer geringere Bildqualität abliefern – jedenfalls auf die 100-Prozent-Darstellung bezogen, in der man jedes Pixel sieht. Kleinere Sensorpixel können während einer Belichtung weniger Elektronen sammeln, und mit einer Handvoll Elektronen kann man weniger Tonwerte differenzieren; auch der Dynamikumfang und der Rauschabstand leiden. Gegen das stärkere Rauschen helfen keine technischen Kniffe, denn dessen Ursache liegt mittlerweile vor allem im Rauschen des Lichtes selbst. Dieses Photonenrauschen hängt direkt von der Zahl absorbierter Photonen und damit von den gesammelten Elektronen ab.

Das spricht nun nicht zwingend gegen eine weitere Verkleinerung der Sensorpixel (und entsprechend mehr Megapixel), denn wenn man das so gewonnenen Bild auf eine geringere Auflösung herunterrechnet und dabei mehrere Pixel zusammenfasst, verbessern sich die Tonwertdifferenzierung, der Dynamikumfang und der Rauschabstand, während der Zugewinn an Detailauflösung aufgrund des Oversampling mit immer mehr Pixeln weitgehend erhalten bleibt. Mehr und kleinere Sensorpixel bieten aber das Potential, die Bildqualität nicht nur auf das gesamte Bild bezogen zu verbessern (wobei man davon absehen sollte, bis zu den einzelnen Pixel in das Bild hineinzuzoomen), sondern auch auf der Ebene der Pixel. Der Schlüssel dazu liegt darin, die geringe Größe eines Sensorpixels zu kompensieren, indem man in die vierte Dimension ausweicht, also die Belichtungszeit verlängert.

Eigentlich geht das ja gar nicht. Kleine Pixel können nur wenige Elektronen speichern; wenn weitere Photonen absorbiert werden und zusätzliche Elektronen freisetzen, finden diese keinen Platz mehr im Ladungsspeicher und müssen abgeleitet werden, um einen Überfluss der Ladungen zu Nachbarpixeln (das sogenannte „Blooming“) zu vermeiden. Anders sieht es aus, wenn man eine Belichtung in mehrere Teilbelichtungen unterteilt. Es ist ein bisschen so, als müsste man 10 Liter Wasser holen, hätte aber nur ein Gefäß, das einen Liter fasst – dann muss man eben zehn Mal gehen. Genauso kann man die Speicherkapazität eines Sensorpixels virtuell erweitern, indem man es mehrmals hintereinander ausliest und die Ergebnisse aufsummiert. So lange jede einzelne Belichtung kurz genug ist, dass die Pixel nicht überlaufen, erhält man am Ende ein Ergebnis, wie es vielfach größere Sensorpixel liefern würden.

Und warum arbeiten Kameras nicht schon längst so? Das größte Hindernis ist bislang, dass der für die Teilbelichtungen benötigte elektronische Verschluss noch viel zu langsam ist. Ein mechanischer Schlitzverschluss benötigt zwischen 1/200 und 1/500 s, um den ganzen Sensor zu belichten, selbst wenn jedes Pixel nur für 1/8000 s belichtet wird. Ein elektronischer Verschluss mit „rolling shutter“, wie er noch immer dem Stand der Technik entspricht, ist aber noch viel langsamer und braucht vielleicht 1/20 s für eine vollständige Belichtung, obwohl die Belichtungszeit bis zu 1/32000 s betragen kann. Ein globaler elektronischer Verschluss, an dessen Realisierung die Sensorhersteller seit Jahren arbeiten, könnte dagegen alle Sensorpixel gleichzeitig belichten und würde insgesamt nur so lange brauchen, wie die Belichtungszeit eben dauert. Wenn dann auch noch die Verarbeitung der Sensordaten Schritt hielte oder diese Daten wenigstens zwischengespeichert werden könnten, ließen sich damit auch kurze Belichtungen noch in viele Teilbelichtungen zerlegen, um vielfach größere Sensorpixel zu emulieren.

Die virtuelle Vergrößerung der Sensorpixel entspräche einer Verringerung des ISO-Werts. Wenn der Sensor eine Grundempfindlichkeit von ISO 200 hat, wären durch mehrfache Teilbelichtungen auch ISO 100, 50, 25 oder 12,5 erreichbar – mit allen Vorteilen bei Dynamikumfang und Rauschabstand, die damit einhergehen. Damit fiele auch ein Nachteil kleinerer Sensoren weg: Um mit einem kleinen Sensor die gleiche Bildqualität und Bildanmutung wie mit einem größeren Sensor zu erzielen, müsste man ein proportional lichtstärkeres Objektiv verwenden und einen niedrigeren ISO-Wert wählen, damit die erforderliche Belichtungszeit am Ende gleich bleibt. Das ist oft problemlos möglich, so lange man mit hohen ISO-Werten arbeitet, aber falls der große Sensor bei seiner Grundempfindlichkeit genutzt wird, müsste man bei der Kamera mit dem kleinen Sensor einen niedrigeren ISO-Wert einstellen, als dieser überhaupt unterstützt. Dann bietet der große Sensor Vorteile, denen der kleine Sensor nichts Gleichwertiges entgegenzusetzen hat. Mit mehrfachen Teilbelichtungen gäbe es aber keine ISO-Grenze nach unten mehr und so käme es zumindest in dieser Hinsicht nicht mehr auf die Sensorgröße an. (Ein Unterschied bliebe: Für den kleineren Sensor braucht man ein lichtstärkeres Objektiv, um die Äquivalenz herzustellen, und ein solches wird nicht immer verfügbar sein; außerdem stellt eine höhere Lichtstärke höhere Anforderungen an den Objektiventwickler.)

Die Quintessenz ist, dass die Megapixelzahl der Sensoren weiter steigen und folglich auch die Verkleinerung der Sensorpixel nicht so bald enden wird. Die Qualität der mit solchen Sensoren aufgenommenen Bilder wird darunter nicht nur nicht leiden, sondern aller Voraussicht nach auch noch zunehmen. Kleinere Sensoren werden künftig Ergebnisse liefern, die in mancher Hinsicht denen gleichen, für die aktuell noch größere Sensoren nötig sind.

Vielen Dank für die prof. Info. Machte mir auch schon länger Gedanken darüber warum neben den ganzen Schnickschnack-Voreinstellungen es noch keine Lösung bez. softwareseitigen ND-Einstellungen gab. lg