Lidar: Laser vs. Kamera

In den letzten Tagen machte eine Geschichte die Runde, die sich während der Messe CES in Las Vegas ereignet hat: Der Sensor einer Kamera wurde dauerhaft beschädigt, nachdem deren Besitzer ein sich selbst steuerndes Auto fotografiert hatte. Ist das Laser-basierte „Licht Radar“ (Lidar) solcher Fahrzeuge eine Gefahr für digitale Kameras?

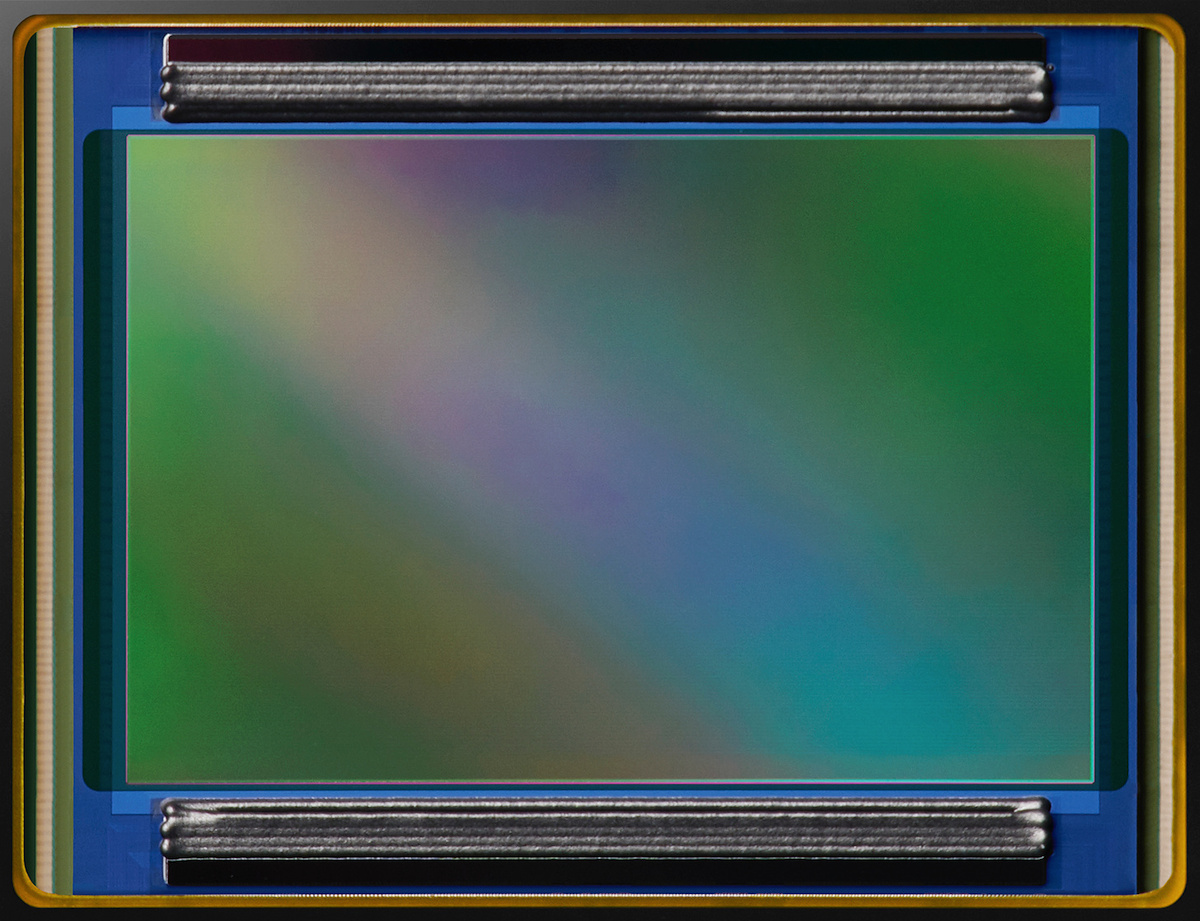

Jit Ray Chowdhury ahnte nichts Böses, als er mit seiner Sony Alpha 7R II auf der CES fotografierte, unter anderem autonom fahrende Autos, mit deren Entwicklung er auch beruflich zu tun hat. Alle Aufnahmen seit dem Foto eines Autos mit dem Lidar (Licht-Radar) der Firma AEye zierten dann allerdings horizontale und vertikale Linien, die auf eine irreparable Beschädigung des Sensors hindeuteten. Wie konnte so etwas passieren?

Die Lidar-Technologie ist rund 50 Jahre alt. Das Prinzip entspricht dem des Radar, nur dass man statt Radiowellen die kürzeren Wellenlängen des (infraroten) Lichts verwendet. Aus der Zeit, die das vom Ziel reflektierte Laserlicht braucht, bis es die Quelle wieder erreicht, lässt sich die Entfernung berechnen. Ursprünglich wurde Lidar für Vermessungsaufgaben genutzt, nicht nur von Geologen und Archäologen, die sich für die präzise Form der Erdoberfläche interessierten, sondern auch auf Raumfahrtmissionen, beispielsweise zum Mond. Laser-Entfernungsmesser sind schon länger erschwinglich geworden, aber mittlerweile werden auch Time-of-Flight-Sensoren, die mit jedem einzelnen Sensorpixel die Laufzeit des Lichts messen und damit eine Art Tiefen-Bild erzeugen können, immer preiswerter. Für die autonomen Fahrzeuge der Zukunft ist Lidar eine Schlüsseltechnologie, denn gewöhnliche Kameras liefern nicht genug Daten, damit sich eine künstliche Intelligenz auf deren Basis sicher durch den Straßenverkehr bewegen könnte.

Wenn ein autonomes Fahrzeug Laserstrahlen in alle Richtungen schießt, um seine Umwelt abzutasten, dürfen diese natürlich nicht die Gesundheit von Passanten gefährden. Lidar-Laser arbeiten im Bereich des nahen Infrarot, also nahe den Wellenlängen des sichtbaren Lichts. Teilweise werden Wellenlängen ab 850 nm genutzt, die der Netzhaut unserer Augen gefährlich werden können, zumal das für uns unsichtbare Infrarot keinen Lidschlussreflex auslöst. Solche Laser dürfen daher nur eine sehr geringe Leistung abgeben. Laser mit einer längeren Wellenlänge von 1550 nm sind teurer, aber auch sicherer, denn ihr Licht wird weitgehend von der Hornhaut und der Linse des Auges absorbiert und kann die Netzhaut nicht schädigen. Diese Wellenlänge lässt daher auch höhere Leistungen zu, aber sicher sind die Laser nur für unsere Augen – die Sensoren von Digitalkameras können durchaus Schaden nehmen. Das betrifft auch die autonomen Fahrzeuge selbst, die ja neben Lidar, Radar und Ultraschall vor allem auf Kameras setzen, die Bilder im sichtbaren Spektrum aufnehmen. Falls die Straßen der Zukunft voller sich selbst steuernder Autos sein sollten, könnten deren Lidar-Systeme die Kameras anderer Fahrzeuge erblinden lassen.

Ein weiterer wichtiger Unterschied zwischen verschiedenen Lidar-Konstruktionen besteht in der Lichtabgabe, die in sehr kurzen, energiereichen Pulsen oder kontinuierlich erfolgen kann. Für eine direkte Messung der Lichtlaufzeit nutzt man kurze Pulse; aus der Zeit, die zwischen dem Laserpuls und der Rückkehr des reflektierten Lichts vergeht, ergibt sich die Entfernung. Kontinuierlich abgegebenes Licht wird dagegen moduliert: Der Laser moduliert das Licht beispielsweise mit einer Schwingung mit sich stetig ändernder Frequenz, und aus der Frequenz des abgegebenen und des empfangenen Signals lässt sich indirekt die Zeitdifferenz und daraus wiederum die Entfernung berechnen. Solche kontinuierlich arbeitenden Laser können mit einer weit geringeren Leistung arbeiten und sind daher weniger gefährlich als die stärkeren und gepulsten Laser.

Das System von AEye zeichnet sich dadurch aus, dass es die Umwelt mit einer hohen Bildrate (100 Hz, also 100 Tiefenbilder pro Sekunde) abtastet und noch Fahrzeuge bis zu einer Entfernung von 1000 Metern erkennen soll. Dafür werden besonders starke, gepulste 1550-nm-Laser eingesetzt, so dass die davon ausgehende Gefahr für Kamerasensoren besonders hoch ist. Kein Wunder also, wenn die Kamera eines Fotografen, der nur wenige Meter vom Lidar entfernt stand, dabei Schaden nahm. Bis autonome Fahrzeuge zum Alltag gehöre, werden sich die Entwickler wohl noch etwas einfallen lassen müssen.

Eine umfangreiche Analyse zu den Gefahren von Laserlicht für Kamerasensoren (in englischer Sprache) finden Sie unter www.mts-iss.com/affects-of-lasers.html – dort am Beispiel von Überwachungskameras beschrieben.

Ich halte das Ganze für ein Fake. Bildwandler in üblichen Kameras sind zwar für IR noch empfindlicher als für sichtbares Licht, haben deswegen jedoch gute Sperrfilter. Diese können für Spezialfälle wie Astro aus dem Strahlengang entfernt werden. Dann werden jedoch IR-Bilder und solche aus sichtbarem Licht überlagert, was in der Fotografie unerwünscht ist, denn der Fokus liegt bei Objektiven nicht an der selben Stelle. Somit würde ein scharfes Bild von einem unscharfen IR-Biold überlagert.

Der Hinweis, dass gepulstes IR in Autos mehr Energie hat, ist missverständlich. Die Amplitude liegt zwar höher, aber die Zeit ist kurz und die Pausen dazwischen lang, sodass die Leistung (Amplitude mal Zeit) meist geringer ist.

Weit kritischer für den Menschen sind die Laser-Systeme, wie man in der Vergangenheit an den geschädigten „Laser-Soldaten“ gesehen hat. Immerhin wird recht hohe Leistung benötigt, um einige Hundert Meter vorauszusehen. Diese Energie wird von dem vorausfahrenden Auto reflektiert und darf nicht zu gering sein, um noch ausgewertet zu werden. Schon ein einzelnes Fahrzeug belastet den Verkehr und Gegenverkehr heftig. Was bei einer Vielzahl dieser Systeme passiert, ist noch nicht erforscht.