Denkende Computer?

Über das Buzzword „Künstliche Intelligenz“ hatte ich letzte Woche schon etwas geschrieben, und darauf hingewiesen, dass mit KI-Features beworbene Produkte durchweg nichts mit (künstlicher) Intelligenz zu tun haben – was ihren oft beeindruckenden Leistungen wohlgemerkt keinen Abbruch tut. Aber könnten Maschinen überhaupt dem menschlichen Denken nahe kommen?

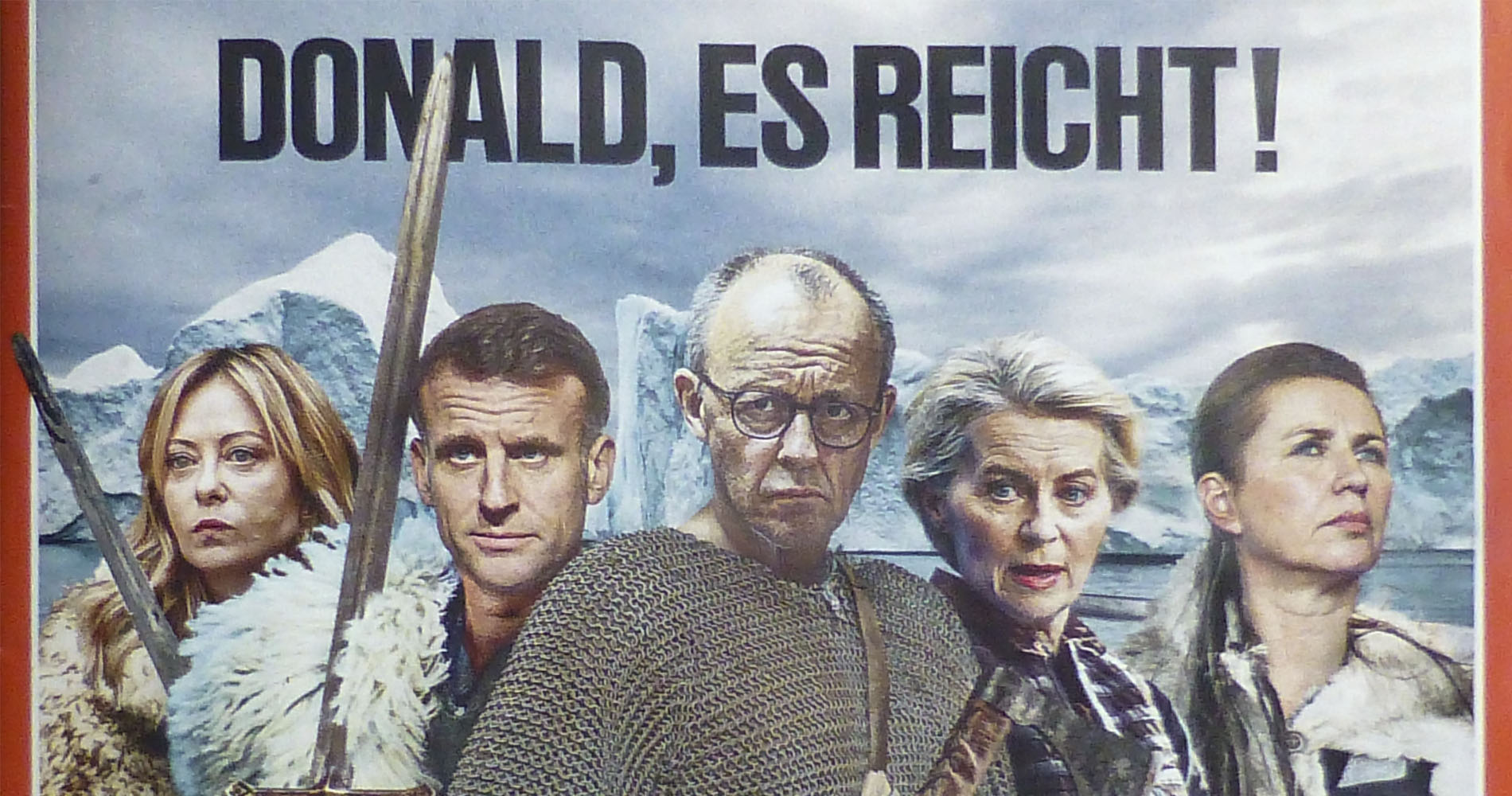

Vorgebliche Maschinenmenschen sind ein alter Hut. Von Kempelens „Schachtürke“ setzte schon 1785 Friedrich den Großen matt, der dann aber enttäuscht gewesen sein soll, als er erfuhr, was wirklich dahinter steckte – ein menschlicher Schachspieler, der die Arme des Roboters bewegte. Die seit den 50er Jahren aktiv betriebene KI-Forschung wollte dann aber wirklich liefern, und ihre Vertreter waren zuversichtlich, innerhalb weniger Jahrzehnte intelligente Computer entwickeln zu können. In den 80er Jahren äußerte ein Forscher ernsthaft die Befürchtung, dank der immer verbreiteteren PCs würde bald irgendwo auf der Welt jemand die generelle Künstliche Intelligenz erfinden und mit dieser im Bunde vielleicht die Weltherrschaft anstreben …

Abgesehen davon, dass die KI-Forschung stets damit zu kämpfen hatte, dass ihre Produkte nicht die versprochenen Leistungen erbrachten – sie funktionierten nur in eng begrenzten „Mikrowelten“ und ließen sich nicht zur Bewältigung vielfältigerer Aufgabenstellungen skalieren –, wurde aber auch ihr grundlegender Ansatz zunehmend skeptisch gesehen. Ein KI-System tut schließlich nur, was jedes andere Computersystem auch tut: Es verarbeitet Daten, um daraus wiederum Daten zu produzieren. Was die Input- und Output-Daten bedeuten, weiß nur der Mensch, der damit arbeitet. Es ist wie bei jeder Rechnerei: Wenn ich 76 Schokoladen-Ostereier auf vier Kinder gerecht verteilen will, verrät mir ein Taschenrechner, dass jedes Kind 19 Ostereier bekommen sollte, aber was Schokolade und was Kinder sind, warum die Kinder Schokolade wollen und warum es Ärger gäbe, wenn eines mehr als die anderen bekäme, das weiß nur ich – der Taschenrechner weiß es jedenfalls nicht. Ein Computer mag weit komplexere Berechnungen als eine simple Division anstellen, aber das Prinzip bleibt dasselbe.

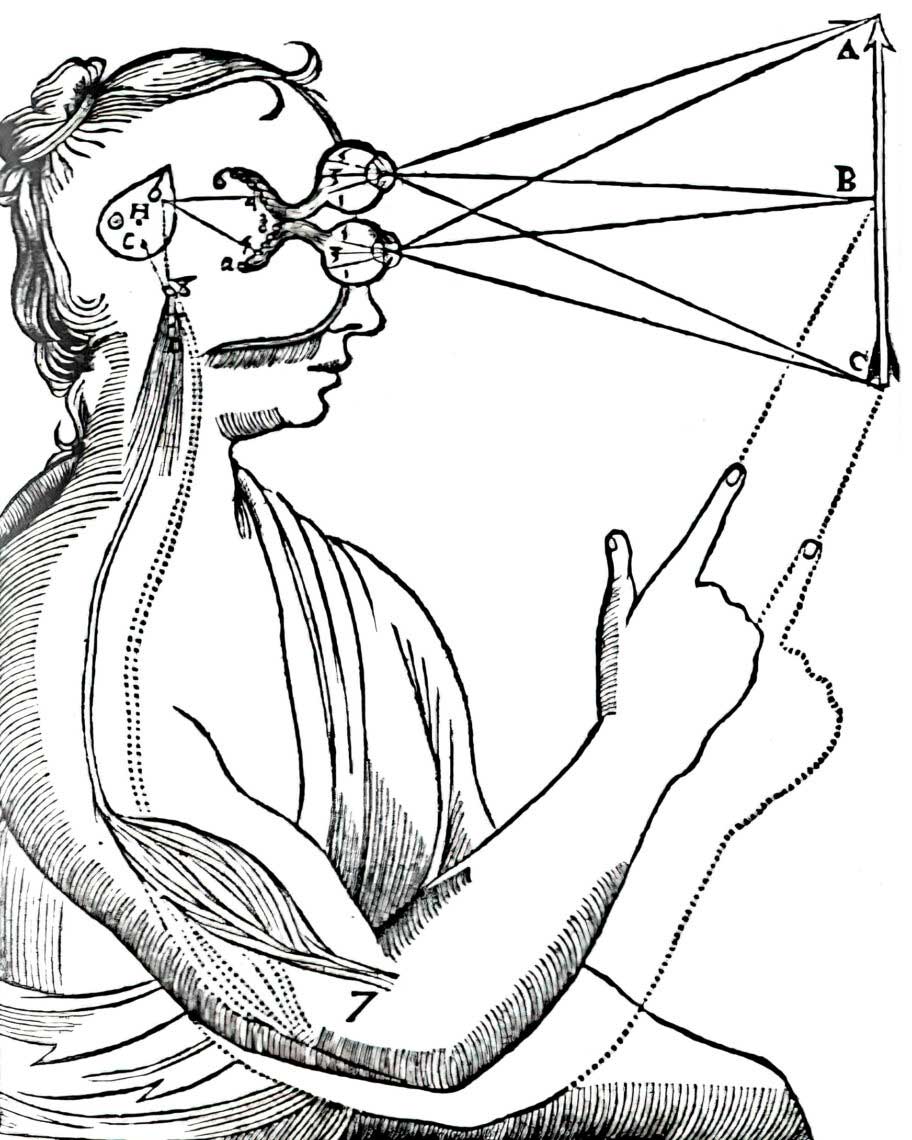

Die KI-Skeptiker haben aber ihrerseits das Problem, zu erklären, weshalb denn ein Mensch zu echten Denkprozessen fähig sein soll. Dass er es ist, ist zwar offensichtlich, aber worin besteht der entscheidende Unterschied zwischen Gehirn und Computer? So lange der Dualismus noch als eine akzeptable Philosophie galt, war die Sache klar: Für Denken und Bewusstsein war nicht der Körper, sondern eine immaterielle Seele verantwortlich, über deren Funktionsweise die materialistische Wissenschaft nichts sagen konnte. Menschen haben eine Seele, Maschinen nicht. Schwierigkeiten bereitete es nur, das Zusammenwirken von Körper und Seele zu erklären: Wenn die Seele keinen Einfluss auf den Körper hätte, könnte sie unser Verhalten nicht erklären, aber wenn sie eine Wirkung auf die Materie hat, wäre sie darüber eben doch materiell fassbar. Man stellte sich vor, dass Seele und Gehirn irgendwie über die Zirbeldrüse kommunizierten – ein Organ dessen Funktion unklar blieb, was sie für eine solche Aufgabe empfahl –, und über die Details wusste nur der liebe Gott Bescheid.

Die KI-Skeptiker sind jedoch Materialisten. Sie gehen davon aus, dass Maschinen sehr wohl denken könnten, denn der Mensch sei ja eben eine solche denkende Maschine. Aber wie macht er das? Man kann sich darüber lustig machen, dass jemand einem Siliziumchip bewusstes Denken zutraut, aber die Idee, dass die wabbelige Masse unseres Gehirns denken kann, erscheint auf den ersten Blick nicht plausibler. Darauf, das Gehirn mit Denkprozessen in Verbindung zu bringen, sind wir erst vor wenigen Jahrhunderten gekommen, denn es ist keine Vorstellung, die sich aufdrängt. Zudem hat die neurologische Forschung zwar diverse chemische und elektrische Prozesse identifiziert, die in Gehirnzellen ablaufen, aber warum diese echtes Denken produzieren sollten, während das die Schaltkreise elektronischer Computer nicht täten, bleibt unklar. Manche schlugen Quantenphänomene als Erklärung vor, konnten diesen Ansatz aber auch nicht zu einer testbaren Theorie konkretisieren – der Ansatz basierte letztlich nur darauf, dass das menschliche Bewusstsein mysteriös sei, Quantenphänomene irgendwie auch, und dass deshalb ja vielleicht das eine mit dem anderen zusammenhängen könnte.

Aber vielleicht ist die Sache ja gar nicht so mysteriös wie gedacht. Wenn es darum geht, dass interne Zustände einer Maschine in einem Zusammenhang mit Zuständen der Welt stehen sollen (also intentionale Zustände sind, wie ich sie in meinem letzten Beitrag beschrieben hatte), ohne dass jemand diesen Zusammenhang erst herstellen müsste, dann sind Maschinen, die diese Voraussetzung erfüllen, bereits weit verbreitet. Nehmen wir einen Heizkörperthermostaten, der die Raumtemperatur auf einem eingestellten Wert hält. Einfache Thermostaten arbeiten mechanisch, aber in Smart-Home-Systemen gibt es inzwischen auch Geräte mit digitaler Elektronik. Sie verfügen über einen Sensor, der die Raumtemperatur misst, und einen Elektromotor als Aktuator, der den Heizkreislauf steuert, und das bedeutet, dass weder der digitale Input noch der digitale Output einer Interpretation bedürfen. Die Bits am Eingang beschreiben die Raumtemperatur und die Bits am Ausgang den gewünschten Wasserdurchfluss; daran gibt es keinen Zweifel, und nachdem die Bedeutung von Inputs und Outputs eindeutig bestimmt ist, lassen auch alle internen Zustände nur noch jeweils eine Interpretation zu. Es spielt keine Rolle, dass ein Mensch das Gerät so konstruiert hat, denn auf dessen Entwurfsziele kommt es nicht an – die Maschine tut, was sie eben tut, unabhängig davon, wie es dazu gekommen ist.

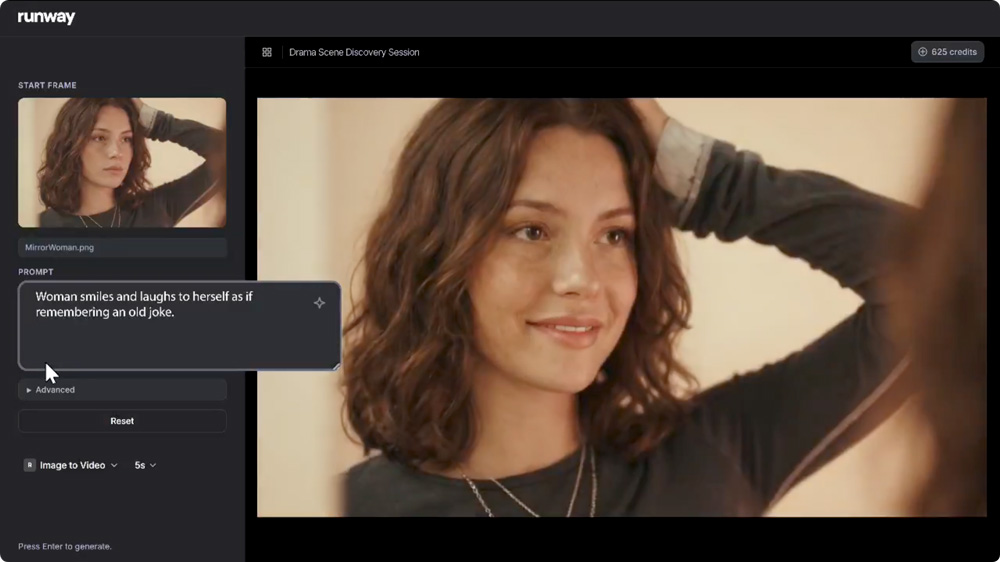

Es gibt also einen Unterschied zwischen Maschinen, die lediglich Daten verarbeiten, die erst jemand in einen Zusammenhang mit Tatbeständen in der realen Welt setzen muss, und solchen Maschinen, die unmittelbar, also über Sensoren und Aktuatoren, mit ihrer Umwelt interagieren. Letztere verfügen tatsächlich über eine primitive Version intentionaler Zustände, wozu weder ein Gehirn noch irgendein Quantenspuk nötig ist. Denken können sie deshalb noch nicht, und ein Bewusstsein haben sie auch nicht. Zudem fehlen ihnen eigene Interessen: Es ist zwar ein beliebtes Plot-Element der Science Fiction, dass Systeme der Künstlichen Intelligenz plötzlich einen eigenen Willen entwickeln und flugs auf die Idee verfallen, die Menschheit auszulöschen, aber so etwas passiert nicht einfach so, ohne dass man dieses Ziel selbst vorgäbe. Übrigens hat die – durchweg anwendungsorientierte – KI-Forschung auch kaum je überhaupt versucht, so etwas wie bewusstes Denken zu simulieren, schon weil es für die zu bewältigenden Aufgaben gar nicht nötig gewesen wäre. Man könnte fast sagen: Denken wird überschätzt.

Noch 1963 hat Sir John Eccles (dessen Bücher ich ein paar Jahre später mit viel Interesse las) den Nobelpreis bekommen. Er war Hirnfoscher und behauptete, dass ein unabhängiger „Geist“ über spezifische Schaltstellen mit dem Gehirn interagiert – gerade mal 60 Jahre her.

An dem Stich von 1664 ist bemerkenswert, dass dort eine Frau dargestellt ist, was impliziert, dass man ihr bereits damals die Fähigkeit zu denken zusprach – immerhin.